第2章 LLM数据生命周期与质量评估框架¶

2.1 为什么需要统一质量语言¶

在大模型开发过程中,不同专业背景的团队往往在“什么是好数据”上存在巨大的沟通鸿沟。这种缺少统一“质量语言”的情况,正是造成许多 LLM 项目搁浅的核心原因。

2.1.1 团队对"高质量数据"的误解来源¶

在一个典型的大模型研发团队里,"高质量数据"对不同角色意味着截然不同的东西。以下是三个真实发生在联合评审会上的典型对话场景,它们揭示了这种认知断层的危险程度。

场景一:算法研究员 vs 数据工程师

算法研究员(看着 Loss 曲线):"你们的新批次数据有问题,明显感觉训练步骤 8000 之后 Loss 上不去了,代码生成能力下降了。" 数据工程师(指着质量报告):"不对!这批数据的清洁度评分是 0.91,比上一版高了 5 分,我们专门加了更严格的长度过滤,质量是最好的一版。"

问题根因:两人说的"质量"根本不是同一个维度。严格的长度过滤把那些包含边界情况的长代码片段全部过滤掉了——提升了"噪声维度"的质量,却降低了"覆盖度维度"的质量。

场景二:标注专家 vs 数据工程师

标注专家:"你们给我这批 SFT 原始数据太差了,里面一半答案在事实上是错的,有的把 2023 年的事件说在 2021 年。" 数据工程师:"这批数据我专门用 KenLM 跑过困惑度过滤,PPL 分布非常好,语言流畅度很高啊。"

问题根因:困惑度(PPL)衡量的是"语言分布合理性"——一个语言流畅但事实全错的段落,PPL 可以非常低(看起来很"好")。标注专家需要的"事实准确性"是 PPL 过滤完全覆盖不到的维度。

场景三:产品经理 vs 算法研究员

产品经理:"模型在线上对用户的金融问题频繁幻觉,昨天一个用户问某股票今年的分红,模型一本正经地给出了去年的错误数据。" 算法研究员:"在我们的基准评测集上,这个模型在金融知识问答 Accuracy 是 78%,超过上一版本好几个点呢。"

问题根因:内部评测集的金融知识截止时间是上一年,而用户在线上问的是实时信息,时效性(Staleness)这个质量维度在内部评测中根本没被设计进去。

三个场景的共同点是:每一方都没有"说谎",每个人都在用自己理解的"质量"评判数据——但恰恰这种"各说各话",造成了模型表现的系统性失误。

落地方案:建立统一质量语言的 Workshop

在大多数一线大模型团队中,解决这一问题的有效方法是,在项目启动阶段强制召开一次数据质量定义对齐 Workshop,输出一份团队内部的《数据质量术语与指标契约》文档。这份文档首先要完成的,是为本项目的"质量"定义完整的维度清单——准确性、多样性、重复率、时效性、安全性——并为每个维度给定可量化的计算方式,而非停留在定性描述层面。

其次,文档必须为不同训练阶段分别定义各自的合格线阈值:Pre-training 数据的合格线与 SFT 数据的合格线在量级和维度上都存在根本性差异,永远不能混用。更重要的是,文档应当建立起术语到代码的精确映射。例如当某一方说"重复率过高"时,全组所有人对这五个字的理解必须统一:它在工程上的含义是"MinHash Jaccard 相似度大于 0.8 的样本对在整批数据中占比超过 5%",而不是各自凭感觉的"这批数据看起来好像有点重复"。

这份契约文档并非一劳永逸的静态文件,而是随项目进展持续演进的活文档。在每一个重要的 milestone(例如新模型版本发布后)必须组织一次回顾,检查已有的指标定义在新阶段是否仍然适用,是否需要随业务场景的变化而扩展或调整。

2.1.2 生命周期视角下质量目标为何会动态变迁¶

质量绝非一个静态标准,它随着数据生命周期的推进,在不同阶段呈现出完全不同的核心诉求。如果用一个固定的标准去衡量整个生命周期的数据,必然会有严重的误判。

表 2-1:LLM 数据四阶段质量目标演变矩阵

| 训练阶段 | 典型数据规模 | 最核心的质量诉求 | 主要检测指标 | 典型缺陷与风险 | 主要处理工具 |

|---|---|---|---|---|---|

| 预训练 (Pre-training) | 数百 B ~ 数十 T Tokens | 高多样性、低重复率、广泛知识覆盖 | N-gram 重复率、PPL 分布、领域比例、语言分布 | 文本去重不彻底("复读机");基准题库混入(评测分数虚高);垃圾 SEO 占比过高 | MinHash / SimHash;fastText 语言识别;KenLM;Quality Classifier |

| 指令微调 (SFT) | 数万 ~ 数百万条指令对 | 指令多样性、格式合规性、逻辑链条完整 | 指令困难度分布、格式合规率、事实准确率 | 指令语义近似重复("近似克隆");答案格式混乱;答案事实错误 | Rouge-L 去重;GPT-4 事实审计;格式正则校验 |

| 偏好对齐 (RLHF/DPO) | 数万 ~ 数十万条偏好对 | 偏好差异显著性、价值观贴合度、无害性 | 标注一致性 Cohen's κ;chosen/rejected 质量差距;毒性评分 | 标注员偏好不一致(κ < 0.6);chosen/rejected 差距不够大(信号弱);存在文化偏见 | 多轮 calibration;Reward Model 预筛;Perspective API |

| RAG 应用落地 | 数千 ~ 数万篇文档 | 时效性、业务覆盖率、检索召回精度 | 知识截止时间分布;场景覆盖召回率;Faithfulness 评分 | 知识库陈旧(6个月未更新);切片粒度太大导致召回噪声过高;PDF 解析乱码 | LlamaIndex / LangChain;RAGAs 评估框架;Embedding 质量评估 |

从表格中可以清晰地看到:同样是"质量评估",从预训练阶段的"去重率与 PPL 分布"到 RLHF 阶段的"标注一致性与偏好差距",主要指标已经发生了根本性的切换。一个在预训练阶段的"合格"数据(流畅、无重复),放到 SFT 阶段可能因为不够精确而"不合格"。这种阶段性的质量目标迁移,要求数据工程团队必须建立分阶段的质量合同(Phase-Specific Quality Contract),而不是一套打天下的万能通用标准。

2.1.3 没有统一框架时的治理失效现象¶

当缺乏统一的数据质量评估框架时,项目必然会出现“治理失效”。典型症状包括:

-

指标孤岛(Metric Silos):预训练团队用困惑度(PPL)为核心的脚本;微调团队用 ROUGE-L 衡量回复质量;安全团队用 Perspective API 的毒性分数作为合规指标——三套系统之间毫无公共语言。当某批数据同时触发三个团队的告警时,谁主导修复?各团队说"我看这批数据没问题"(各说各的),结果进入了三重相互扯皮的无效博弈。

-

噪音传导放大(Noise Propagation Amplification):没有统一框架时,上游数据管线的小噪声往往无法被早期拦截,沿着管线扩散放大,在下游产生成数量级的危害:

【爬取/存储层】 0.5% 的 base64 编码图片混入文本流 ↓ 未被及时拦截(无统一缺陷标准) 【清洗/训练层】 这些乱码使特定字符 Token 频率异常升高 3 倍 ↓ 噪声在 Gradient 累积中被反复强化 【推理/对齐层】 模型在生成特定类型内容时,约 12% 概率产生乱码输出 ↓ 表现为严重线上幻觉,用户投诉剧增 【最终代价】 模型版本被迫回滚,损失 3 周训练算力与市场窗口期这种"1% 上游错误 → 10% 中游异常 → 30% 下游损失"的指数放大效应,被称为数据管线的"蝴蝶效应"。它的根治方案,正是本章将要建立的统一质量闸门体系。

-

经验无法沉淀(Experience Loss):由于没有统一的缺陷分类标准,每次模型出问题后的复盘会议,结论永远是模糊的"数据太差了,下次要注意"。"太差"到底是因为重复率过高?还是领域配比失衡?还是基准污染?由于分类不清,这些教训无法转化为下一版清洗 pipeline 的具体规则修改,团队注定在同样的坑里反复栽跟头。引入统一质量框架后,每次数据问题都能归类到明确的缺陷类型(见2.3节),都有对应的修复算子和量化改进目标,复盘文档从"数据太差了"变成了"本次事故根因:重复率超标(MinHash相似度>0.8的样本占比从2.3%升至7.1%),修复方案:收紧阈值至0.7,下一版增量验证去重率复测"。

2.2 生命周期视角下的质量目标分层¶

要解决语言不统一的问题,我们必须在生命周期的各个阶段建立明确的“质量目标层级”。

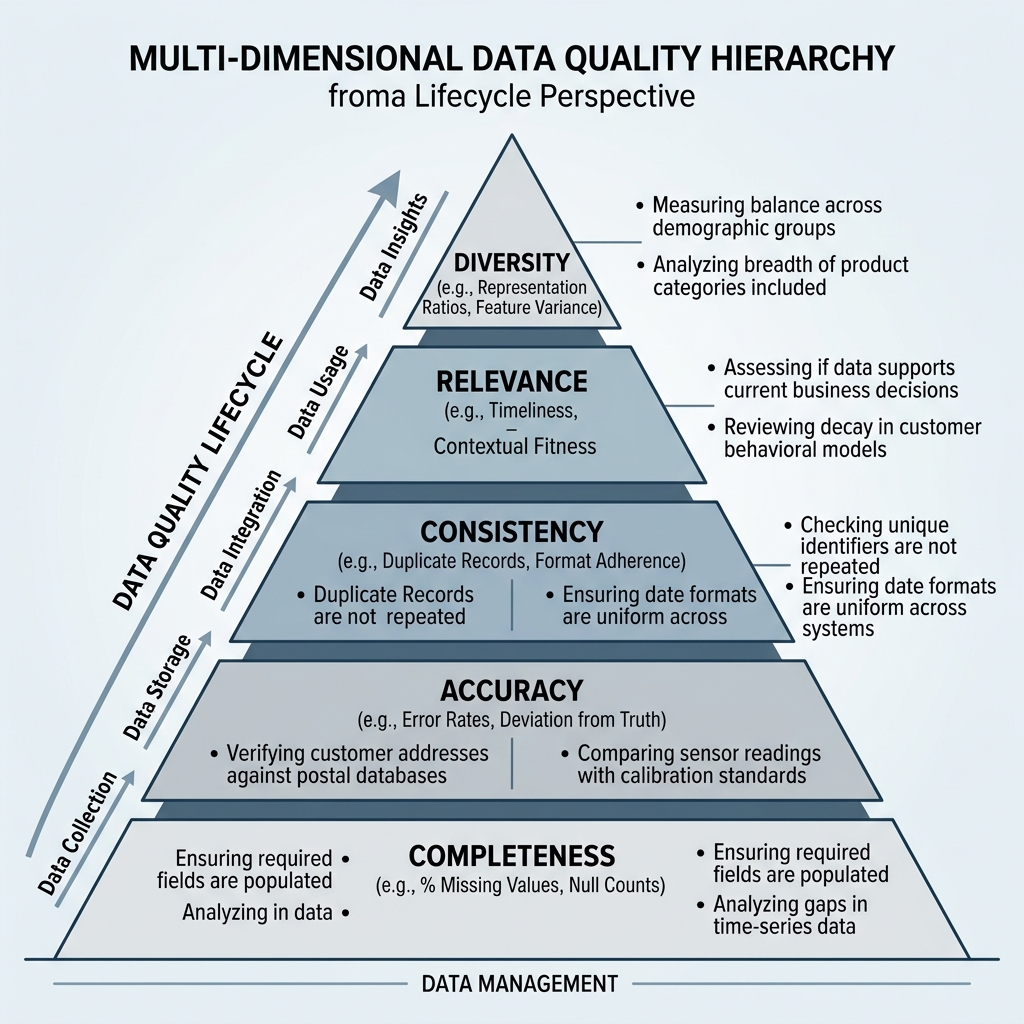

图2-1:生命周期视角下的多维度质量分层架构 —— 展现从下到上各阶段对指标权重的迁移(从“规模/多样性”转移到精准的“真实性/帮助性”)。

2.2.1 各阶段的目标差异与"接力跑"¶

如果把大模型的整个训练链路比作一场奥运接力赛,那么每一棒的运动员拿到接力棒时,都有着截然不同的战术目标——而不是所有人一律"跑快点"就行了。

预训练(Pre-training)阶段是第一棒,跑的是长跑。此时对语料的要求并不是每一句话绝对正确,而是规模足、多样好、无过拟合。这一阶段模型在以无监督的方式"见世面",需要尽可能广地接触到各种领域、各种语言风格、各种知识边界,才能构建出对世界的基础认知图谱。在这一阶段,一篇事实略有过时的科普文章问题不大,但同一篇 SEO 广告文如果在语料库里复现了几千次,就会让模型形成极强的"复读"惯性,成为后续所有阶段都难以根治的顽疾。

指令微调(SFT)阶段是第二棒,跑的是精准的短跑冲刺。这里的质量目标从"广度"骤然收窄至"精度":指令的多样性、回复格式的合规性以及推理链条的完整性,缺一不可。一个关键的行业共识是,哪怕在整个 SFT 数据集中混入 100 条格式混乱或逻辑错误的样本,都足以在可观测层面损害一个 7B 模型在对应任务上的表现——SFT 阶段对污染的敏感度远高于预训练阶段,因为此时模型在"学动作",而不是"见世面"。

偏好对齐(RLHF/DPO)阶段是第三棒,拼的是毫米级精度。这一阶段的核心质量目标是对比数据的有效性与价值观贴合度:chosen 答案必须和 rejected 答案之间有足够可分辨的质量差距,否则奖励信号将过于微弱,如同在嘈杂的环境中发出极轻的指令,模型根本无从学习人类真正的偏好方向。

RAG 应用落地阶段是第四棒,也是最贴近用户的那一棒。这里的质量指标完全转向了时效性与检索精度:知识库中超过 6 个月未更新的文档比例、检索到的 Chunk 是否准确覆盖用户问题的真实意图,以及 PDF 与表格的解析是否存在字段错位——这些问题在前三个阶段根本不会出现,但在 RAG 落地阶段却是决定最终用户体感的核心变量。

2.2.2 离线、在线与业务质量的三角映射¶

然而,仅仅在各阶段分别定义质量目标还不够——一个成熟的数据工程框架必须进一步打通从数据到模型、再到真实业务的完整"指标链",而不是让"数据质量好"和"线上效果好"成为两个彼此割裂的评价体系。

在工业界实践中,这条指标链被描述为一个三角映射结构。第一个顶角是离线数据质量指标,即在数据存储和处理阶段就能计算出的静态分数,包括去重率、PPL 分布均值、基准污染率等;这些指标不需要运行模型就能高效计算,适合在 CI/CD 流水线中自动触发检查。第二个顶角是代理模型评测质量,即将处理后的数据注入一个小规模代理模型(通常是 1B 级别)进行快速训练并测试,以基准测试得分衡量数据的实际训练价值——这一步是离线数据指标与最终模型效果之间不可缺少的"桥梁验证"。第三个顶角是真实业务在线系统质量,即模型上线后用户的真实留存率、满意度评分和转化指标。

理想状态下,三者应当呈现稳定的正相关关系。一旦这个三角形的某条边出现断裂——例如离线数据评分很高但代理模型分数没有提升,或代理模型分数很高但线上用户反馈很差——就是一个强烈的信号,说明当前评估框架在某个环节存在系统性设计缺陷,需要立刻剖析哪个指标与哪个指标之间发生了脱钩,并溯源至数据层的根因。

2.2.3 切面分层:样本级到系统级¶

质量评估还需要在"颗粒度"这个维度上做切面分层。不同粒度的质量问题,发现时机、修复成本和修复手段都截然不同,若混为一谈则容易造成"用大炮打蚊子"或"用弹弓打坦克"的错配。

最细粒度的是样本级(Sample-level)。这是数据管线中最早能检测的层级——这一条长文本是否包含 HTML 标签残余?这张图片与对应文字描述是否语义对齐?这个问答对中的答案是否与问题方向严重偏离?样本级问题量大但单条修复成本低,适合用自动化规则批量处理。

往上一级是批次级(Batch-level)。这一粒度关注的是一批次数据的整体统计分布特征:这个批次的领域采样配比是否与预设的黄金比例产生了 10% 以上的偏移?代码语料与自然语言的比例是否因为某个爬虫配额失效而发生了骤变?批次级问题不会在单条样本上显现,只有在批次整体的统计画像上才能被发现,因此需要专门的滚动分布雷达来监控。

再往上是数据集级(Dataset-level),关注的是整张训练集的宏观健康度:整个语料库的知识时间分布是否严重集中在某几年?有多大比例的内容在基准测试污染检测中被标记为高风险?各语种的比例是否符合多语言能力的训练需求?这一层级的问题是战略性的,通常由数据工程负责人在版本发布前以人工审查和报表复核的方式完成,而非依赖自动化流水线。

最后是系统平台级(System-level),即数据管线这个工程实体本身的运行健康状态:某条 Kafka 消费队列是否出现了积压?某个版本的 MinHash 去重任务是否因为内存 OOM 而静默地提前退出,留下了大量未处理的重复数据?这一层的问题不在数据内容本身,而在于数据管线的工程质量监控,属于 DataOps 可观测性的核心关注点(第8篇将深入展开)。

2.3 缺陷分类与指标矩阵¶

要建立公共的治理动作,必须将那些模糊的“数据不好”翻译为具体、可测量的缺陷指标矩阵。

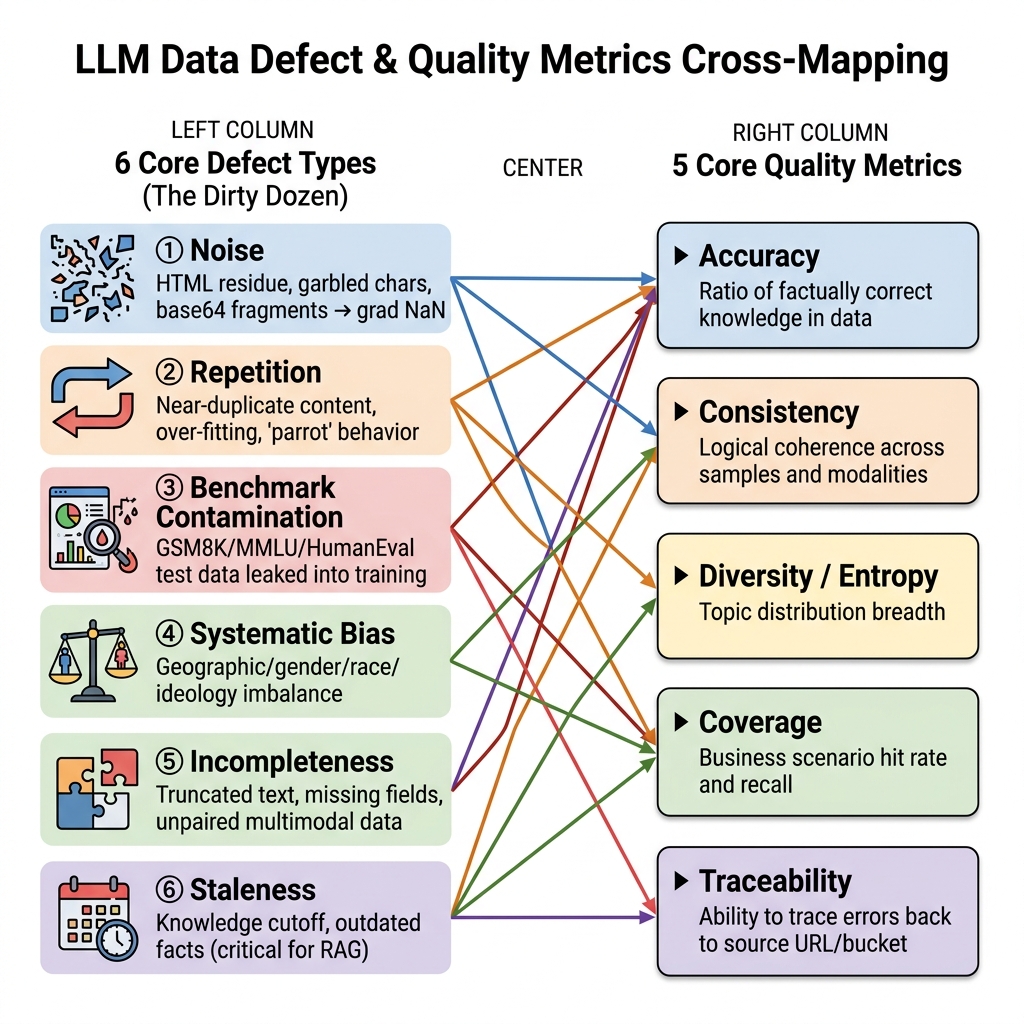

图2-2:大模型数据缺陷与质量指标交叉映射图 —— 展示六大核心缺陷类型(噪声、重复、基准污染、系统偏差、结构缺失、时效衰败)与五大核心质量指标(准确度、一致性、多样性、覆盖度、可追溯性)之间的影响关系网络。

2.3.1 六大核心缺陷分类 (The "Dirty Dozen" of LLM Data)¶

针对大模型训练,我们建立了如下六大核心缺陷维度,每种缺陷均配有自动化检测方案:

1. 庞杂噪声 (Noise)

定义:包含 HTML 残余标签、乱码字符、无意义符号序列、base64 编码残片等,会对 Tokenizer 产生异常输入,严重时导致梯度 NaN。

import re

def noise_score(text: str) -> float:

"""返回噪声比例,> 0.1 视为高噪声样本"""

# 检测 HTML 标签残余

html_tags = len(re.findall(r'<[^>]+>', text))

# 检测高比例非打印字符

non_printable = sum(1 for c in text if not c.isprintable())

# 检测连续重复符号 (如 !!!!!!!)

repeat_symbols = len(re.findall(r'[^\w\s]{5,}', text))

total = len(text) if text else 1

return (html_tags * 10 + non_printable + repeat_symbols * 5) / total

# 过滤阈值: noise_score > 0.1 则丢弃

2. 恶性重复 (Repetition)

定义:同一内容(精确或近似)在训练集重复出现大量次数,模型被迫"背诵"这些片段,引起记忆性过拟合,推理时变成"复读机"。工业界一般用 MinHash LSH 进行近似去重。

from datasketch import MinHash, MinHashLSH

def build_minhash(text: str, num_perm: int = 128) -> MinHash:

m = MinHash(num_perm=num_perm)

for word in text.lower().split():

m.update(word.encode('utf-8'))

return m

# 建议去重阈值: Jaccard 相似度 > 0.8 视为重复(预训练)

# SFT 数据可更严格: > 0.6 即剔除

lsh = MinHashLSH(threshold=0.8, num_perm=128)

3. 基准污染 (Benchmark Contamination)

定义:爬虫不加筛选地将各类公开 AI 评测题库(GSM8K、HumanEval、MMLU 等)的原题及解答一并抓入预训练集,模型在基准测试上得分虚高(机械背诵而非推理)。

# 基准污染检测: 计算 N-gram 重叠率

from collections import Counter

def ngram_overlap(text: str, benchmark_ngrams: set, n: int = 13) -> float:

"""返回与基准题库的 13-gram 重叠比例"""

words = text.split()

text_ngrams = set(

' '.join(words[i:i+n]) for i in range(len(words) - n + 1)

)

overlap = len(text_ngrams & benchmark_ngrams)

return overlap / max(len(text_ngrams), 1)

# 建议阈值: 13-gram 重叠率 > 0.1 则标记为疑似污染并人工复核

4. 系统偏差 (Bias)

定义:由于数据抓取站点地域、语言或话题侧重,导致数据存在国别、性别、种族、意识形态等系统性知识偏见,模型在特定群体相关任务上表现失衡。

检测方案:使用 StereoSet 或 WinoBias 评估集评测模型的偏见程度;同时统计训练集中涉及敏感群体(性别/民族/宗教)的词频分布,检查是否存在严重的词频失衡(某群体出现频率超过另一群体 10 倍以上)。

5. 结构缺失 (Incompleteness)

定义:长文本被截断(只有文章的前半段)、问答对中只有答案没有问题、多模态数据中图片缺少配套文字描述等。

def check_completeness(sample: dict) -> list:

"""检查 SFT 样本的结构完整性"""

issues = []

if 'instruction' not in sample or not sample['instruction'].strip():

issues.append('missing_instruction')

if 'response' not in sample or len(sample['response']) < 20:

issues.append('response_too_short')

# 检查截断: 文本以中途句子结束(无标点结尾)

resp = sample.get('response', '')

if resp and resp[-1] not in '.!?。!?…"\'':

issues.append('possibly_truncated')

return issues

6. 时效衰败 (Staleness)

定义:知识库或预训练语料停留在某一时间截止点,无法回应截止日期之后发生的事实性变化。这在 RAG 应用场景中尤为致命。

检测方案:为语料库中的每篇文档记录 crawl_timestamp 元信息,定期统计知识库中超过 N 个月未更新文档的占比。当超过 6 个月的文档比例达到 30% 时,发出时效衰败告警。

from datetime import datetime, timedelta

def staleness_ratio(docs: list, threshold_days: int = 180) -> float:

"""返回超期文档比例"""

now = datetime.now()

stale = sum(

1 for d in docs

if (now - datetime.fromisoformat(d['crawl_timestamp'])).days > threshold_days

)

return stale / len(docs) if docs else 0.0

# 建议: staleness_ratio > 0.3 时触发知识库更新任务

2.3.2 建立核心指标矩阵¶

为了将缺陷定量化,书中统一采用五大考核指标: 1. 准确度 (Accuracy):数据包含正确知识的比率,是微调数据的最高优指标。 2. 一致性 (Consistency):数据上下游、各模态组合是否存在矛盾(逻辑一致性)。 3. 多样性 (Diversity) / 熵值:涵盖不同话题的离散程度分布。 4. 覆盖度 (Coverage):业务场景在数据流中的命中率及召回。 5. 可追溯性 (Traceability):出现错误时,能否顺着血缘将脏数据溯源定位到某个网页或原始桶(严重影响排错效率)。

2.3.3 指标间的博弈与冲突关系¶

没有完美的指标组合。强行提升某一指标,往往以另一指标下降为代价。例如: * 去重(提升精确性/避免过拟合) vs 多样性:过于严苛的 MinHash 去重阈值(如超过0.7相似度就丢弃)会消除很多在细微边缘处不同(例如模板代码)的高质量特征学习,导致代码能力受损。 * 准确度 vs 时效性:要求极高的人工专家级验证会大幅拉长生产周期,此时高质量语料产生时,可能对应的事实已经变更。

2.4 从评分卡到治理动作:自动洗筛闭环¶

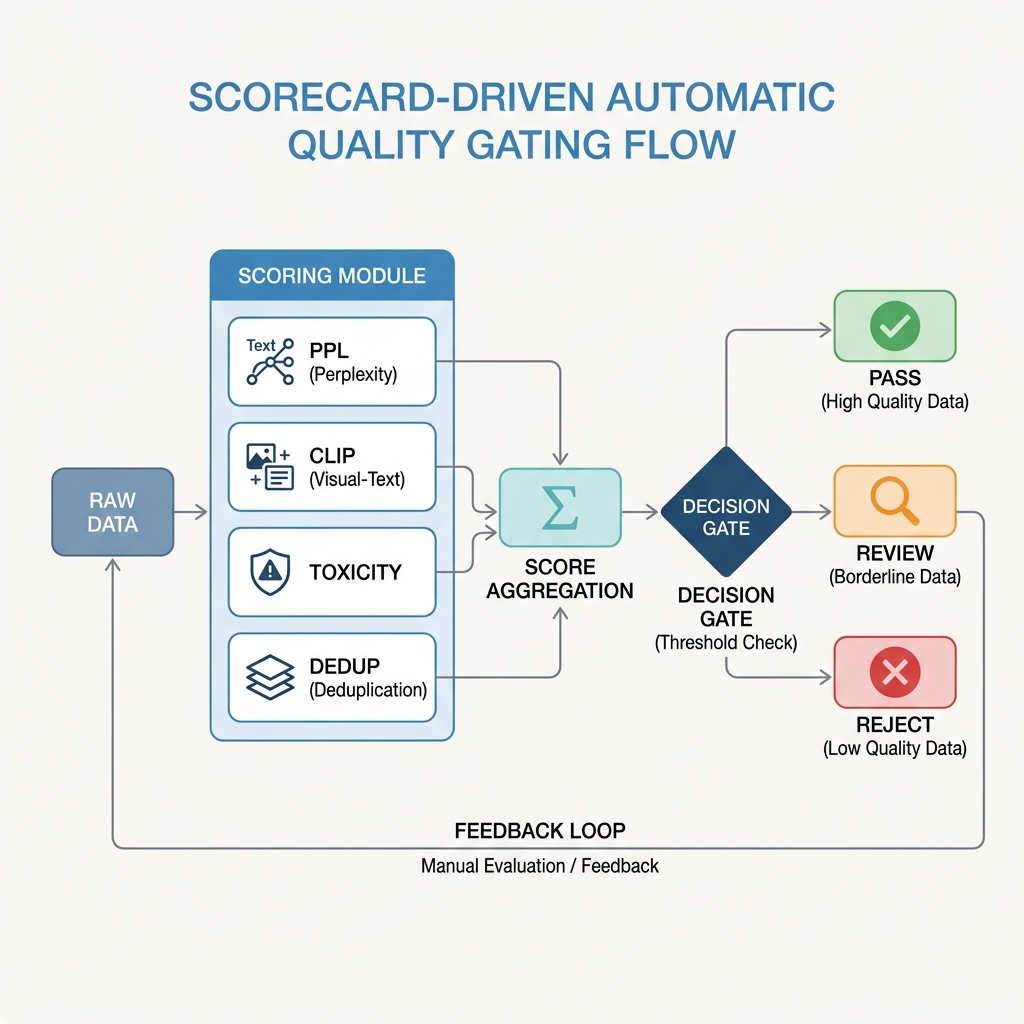

质量评估框架最终必须落地为具体的工程化自动闸门。我们通过设立“数据发布评分卡(Data Release Scorecard)”建立闭环。

图2-3:数据评分卡驱动的自动截断与治理流 —— 类似工业化自动化品控线,利用硬闸门和软闸门阻隔被污染或劣化的数据样本。

2.4.1 数据评分卡的设计与落地¶

评分卡是由一套规则脚本和校验模型综合得出的"数据体检报告"。其核心设计原则是:客观可重复计算、阈值基线配置化、面向动作拦截。在正式发布任意版本的训练数据集之前,评分卡脚本必须被强制触发,并将评估结果序列化为标准 JSON 格式存档。

完整评分卡 JSON 示例(SFT 数据集)

{

"dataset_id": "sft_zhcn_legal_v2.3",

"evaluation_timestamp": "2024-11-15T10:23:45Z",

"evaluator_version": "scorecard-v1.4.2",

"sample_count": 84721,

"scores": {

"dedup_rate": {

"value": 0.023,

"threshold": 0.05,

"status": "PASS",

"method": "MinHash LSH (threshold=0.7, num_perm=128)"

},

"noise_score_p95": {

"value": 0.067,

"threshold": 0.10,

"status": "PASS",

"method": "HTML tag density + non-printable char ratio"

},

"benchmark_contamination": {

"value": 0.0031,

"threshold": 0.005,

"status": "PASS",

"method": "13-gram overlap against GSM8K/MMLU/HumanEval"

},

"format_compliance_rate": {

"value": 0.9712,

"threshold": 0.95,

"status": "PASS",

"method": "Regex schema validator (instruction+response fields)"

},

"staleness_ratio": {

"value": 0.12,

"threshold": 0.30,

"status": "PASS",

"method": "crawl_timestamp > 180 days"

},

"toxicity_p99": {

"value": 0.041,

"threshold": 0.05,

"status": "PASS",

"method": "Perspective API (TOXICITY attribute)"

}

},

"overall_status": "PASS",

"gate_decision": "APPROVED_FOR_TRAINING",

"reviewer": "ci-bot@dataops.internal",

"comments": "All hard gates passed. Soft gate: staleness_ratio=0.12 within safe range."

}

与 CI/CD 流水线集成(GitHub Actions 示例)

# .github/workflows/data_quality_gate.yml

name: Data Quality Gate

on:

push:

paths:

- 'datasets/sft/**' # 每次 SFT 数据集更新时触发

jobs:

quality_check:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v3

- name: Run Data Scorecard

run: |

python scripts/run_scorecard.py \

--dataset datasets/sft/latest/ \

--config configs/scorecard_sft.yaml \

--output reports/scorecard_$(date +%Y%m%d).json

- name: Check Gate Decision

run: |

DECISION=$(python -c "

import json

with open('reports/scorecard_$(date +%Y%m%d).json') as f:

d = json.load(f)

print(d['gate_decision'])

")

if [ "$DECISION" != "APPROVED_FOR_TRAINING" ]; then

echo "❌ Data quality gate FAILED: $DECISION"

exit 1

fi

echo "✅ Data quality gate PASSED"

- name: Upload Scorecard Report

uses: actions/upload-artifact@v3

with:

name: scorecard-report

path: reports/scorecard_*.json

通过以上集成,每次数据工程师合并新批次数据时,CI 流水线会自动运行评分卡检查。若任何硬闸门指标超出阈值,PR Merge 会被自动阻断,直至问题修复后重新提交。

2.4.2 质量阈值、阻断闸门设计与回退 (Rollback)¶

当新爬取的一批 100G 增量数据到达流水线时: * 硬闸门(Hard Gates):如果发现基准污染率大幅上升、或命中安全黑名单字典,立刻在此阶段(Stage)进行阻断,禁止流入下一级并自动触发告警(PagerDuty)。 * 软闸门(Soft Gates):如果文本复杂度的均值低于上一版本 5%,暂时封存待人工确认,这被称为“灰度冻结”。 一旦事后监控发现线上模型退化严重(由于数据引发),DataOps 平台应该支持一键回退到上一个“清洁”的数据指针组合。

2.4.3 将告警转化为修复动作¶

发现分数低下后如何修复?我们采取标准化排坑预案。若是污染率告警,则立刻启动 N-gram 反向过滤剔除作业;若是格式校验(如某批次数据缺失字段),则阻挡导入并定位到原始爬虫解析脚本节点,重新剥离 ETL 字段。只有让告警直接驱动对应的清洗算子,治理才能形成闭环体系。

2.5 真实世界的跨阶段传导放大案例¶

为了加深理解这种“牵一发而动全身”的数据质量传导机制,我们复盘两个经典的真实案例。

2.5.1 案例回放一:预训练语料的“隐性语法漂移”¶

2023年某开源模型发布后,发现随着步数增长,生成代码的能力不仅没有提升,反而开始退化甚至带入罕见的奇怪空白符。

溯源分析:团队追溯上一批数据接入,发现在进行语言识别清洗时,某些 HTML 格式过滤器的包被升级了,原本正常跳过的 <pre> 代码标签引发了解析失效,导致大量带特殊空格缩进的网页源码在最后 1T 数据中占比突然升高了 4倍(这是质量指标中“一致性”未设置基线检查导致的失重)。模型在长期训练中无声无息地发生了“分布漂移”。

教训与复盘:在批次级(Batch-level)中,缺乏长周期的静态分布平稳性监控,这迫使该团队后来搭建了一套滚动 N-gram 分布雷达。

2.5.2 案例回放二:RAG 场景下的“离线高分,上线溃败”¶

金融知识问答模型在使用某批次私有研报 SFT 训练后,在离线评估集上的 Rouge/Bleu 得分远超基线模型。然而业务部门上线后反馈,模型在遇到长尾公司研报时,频繁编造数据(严重幻觉)。 溯源分析:SFT 训练时使用的研报问答对(由低级大模型生成),虽然格式漂亮(SFT 阶段的多样性/格式表现佳),但是抽检发现由于表格拆分解析错误,大量财务数字错位。模型由于离线评估集同样是被这个低级流程造出来的,实现了“用作弊数据集考到满分”。 教训与复盘:这个严重的幻觉漏洞说明“自己考自己”、“离线上线指标割裂”危险。在这一版后,公司强制引入了独立金标准评估集(Gold Standard Set)由人类专家手写,坚决不参与任何模型合成或生成链路,以作最后的试金石。

完整排障时间线(案例一)

- T+0 天:内测用户反馈 Python 代码生成出现诡异缩进,运行后立即报

IndentationError - T+1 天:算法团队推测是温度参数(Temperature)问题,调整后无效

- T+2 天:数据团队被拉入,调取最近 3 个 Checkpoint 的数据批次 diff

- T+3 天:发现第 6 批次(约 1.2T Tokens)接入时,HTML 过滤器依赖包从 v2.3.1 升级至 v2.4.0,新版本改变了

<pre>标签的处理逻辑,原本应保留的代码缩进被误转换为非标准空格 - T+3 天:定量验证:第 5 批次中

\t占所有空白字符的 1.2%(正常),第 6 批次升至 4.9%(升高 4 倍) - T+5 天:锁定依赖版本,重处理第 6 批次数据,从受污染前的 Checkpoint 重启训练(损失约 4 天算力)

- T+12 天:修复后 HumanEval pass@1 从 42.3% 恢复至 51.7%

根本原因:批次级缺乏滚动分布平稳性监控。如果在每批数据接入时都能自动对比关键字符频率的 Z-score 变化(超过 2σ 即告警),这次事故在 T+0 就能被拦截。

def detect_tab_drift(prev_texts, curr_texts, z_threshold=2.0):

import re

def tab_ratio(texts):

ws = sum(len(re.findall(r"\\s", t)) for t in texts)

tabs = sum(t.count("\\t") for t in texts)

return tabs / max(ws, 1)

prev_r = tab_ratio(prev_texts)

curr_r = tab_ratio(curr_texts)

change = abs(curr_r - prev_r) / max(prev_r, 1e-9)

return {"prev": prev_r, "curr": curr_r, "change": change, "alert": change > z_threshold}

完整排障时间线(案例二)

- T+0 天:上线 6 小时内,多位用户反映财报数据与官网不符(相差约 20%)

- T+1 天:运营团队复核 50 个幻觉 case,全部涉及表格数据(营收、EPS 等)

- T+2 天:数据团队抽检 200 条含财务表格样本,发现 34% 的财务数字发生了错位!根因:弱模型解析多列 PDF 表格时列与列之间数字发生错误行对齐

- T+3 天:进一步发现离线评估集也是由同一套弱模型生成的,即"用作弊数据集考满分"——ROUGE-L 0.63 完全不可信

- T+5 天:应急处理:停止弱模型自动生成财务类 QA,改为人工标注;对含财务数字的 RAG Chunk 增加人工复核标记

- T+14 天:引入独立金标准评估集(600 条,100% 人工手写)。修复后 ROUGE-L 为 0.49(下降!这才是真实水平),但系统幻觉率从 34% 降至 4.7%,用户投诉清零

核心教训:自引用评估(Self-referential Evaluation) 是最危险的陷阱。强制引入独立金标准评估集,要求:(1) 人类专家独立手写;(2) 与训练数据管线完全物理隔离;(3) 每次数据集迭代发布后,金标准集结果必须列入评分卡作为上线的否决权指标。

2.6 本章如何成为后续工程的“公共契约”¶

本书从本章节起,正式确立了适用于贯穿数百页的各种工程化手段的“公共契约”。

- 对于第二编(预训练)和第三编(多模态):第五章与第九章构建的庞大清洗代码,其截断阈值和过滤基线,正是来源于本章定下的“信噪比与一致性”底线原则组合。

- 对于第四编(微调与对齐):这里的指标矩阵将在第 12、13 章衍生为自动化数据合成时的 Reward 模型打分体系底座。

- 为了支撑第八编(DataOps 平台):平台上的告警大屏,其所有面板的图表展现的正是本章探讨的核心指标库与可回滚概念。

所以,这是一本"全书通用"的 Checklist。在推进到每一个特定阶段的执行动作前,首先确保整个团队已经在这些术语上完成了"认知对齐"。带着本章这套系统的度量尺,现在,让我们在下一章走进真正能实现和支撑这些度量动作的基础工程——AI 原生的现代数据基础设施。

本章小结

本章系统性地建立了贯穿全书的"数据质量公共契约"。我们从三个真实的跨角色撕扯对话场景出发,剖析了为何不同专业背景的团队在"高质量数据"上始终存在认知断层——这绝非个人问题,而是缺乏统一质量框架的必然结构性结果。

通过四阶段质量目标演变矩阵,我们揭示了质量标准不是静态的,而是随训练生命周期动态迁移的:预训练阶段追求规模与多样性,SFT 阶段追求精确与格式合规,RLHF 阶段追求偏好差异显著性,RAG 阶段追求时效性与检索召回。用一套固定的标准衡量所有阶段,必然导致误判。

六大核心缺陷分类(噪声、重复、基准污染、系统偏差、结构缺失、时效衰败)为团队提供了将模糊的"数据不好"翻译为可测量、可操作指标的公共语言,并为每种缺陷附上了可直接运行的 Python 检测代码。

数据发布评分卡(含完整 JSON 示例)和 GitHub Actions CI/CD 集成方案,将质量评估从人工感性判断升级为可自动触发阻断的工程闸门。两个深度复盘案例(语法漂移与自引用评估)则通过真实的 T+N 天时间线,揭示了数据问题在管线中指数放大的蝴蝶效应,以及独立金标准评估集的不可替代价值。

带着这套质量度量体系,我们已经为整本书的工程内容奠定了坚实的治理基础。