第10章 视频与音频数据工程¶

在经历了从自然语言文本(第一、二篇)到静态图文解析(第八、九篇)的漫长征途后,我们终于来到了构筑新一代全能大模型能力底座的最前沿深水区——长序列时序数据工程(Temporal Video & Audio Data Engineering)。

在过往基于图文对或截帧的训练中,模型就像个盲人摸象的鉴赏家:它能认识世界上的每一种苹果,但它永远无法理解一颗苹果“从桌子上掉落下来、骨碌碌滚进床底并发出清脆撞击声”所蕴含的引力常数、视听觉同步反馈与时间因果律。只有彻底吞噬时间流,模型才能进化为 Sora、Gemini 1.5 Pro 这样能够理解整个世界运行物理法则和声学常识的“世界模拟器(World Simulators)”。

但这也意味着,数据工程的灾难,终于从二维平面彻底爆发向了四维超空间。

10.1 音视频数据为什么最容易“看起来多、可用样本少”¶

许多刚接手多模态项目的架构师很容易陷入一种“富有”的错觉:互联网上每天新增成百上千万小时的 YouTube 和 TikTok 视频,这不就是取之不尽、用之不竭的数据金矿吗?然而当真正启动预训练预处理管线时,他们往往会发现,在硬盘里塞满的 1000 TB 原始视频中,真正能拿去喂给训练框架的可用样本,甚至压不榨出 10 TB。

这种“抱着金饭碗要饭”的巨大反差,究其根源有以下三个致命陷阱:

10.1.1 维度灾难:从二维空间到四维时空序列¶

当我们处理纯图片(Image)时,即便分辨率再高(如 4K AnyRes),它的表达也仅限于 \((W \times H \times C)\) 的二维张量。而对于视频,张量瞬间暴涨了一个决定生死的维度:\((T \times W \times H \times C)\)。

这里的 \(T\) 代表着时间帧数(Timesteps)。哪怕只有短短 1 分钟、帧率为 30 FPS 的短视频,瞬间就会产生 1,800 张连续的超清图像。从前我们引以为傲的 Clip Score 计算、视觉 Token 压缩算子,在这个指数级爆炸的时序张量面前,根本撑不过毫秒级别的 GPU Out-of-Memory(OOM)报错。这使得我们不得不设计严格并且几乎会丢掉 90% 以上信息的视频抽帧(Key-frame Sampling)体系。

10.1.2 虚假的丰富:无用过采样与高模态噪声¶

硬盘里确实有 1000 TB,但这里面 80% 可能是: 1. 完全无信息量的静止冗余:一个长达两小时的在线网课视频,画面可能有一整个小时仅仅是静态不变的 PPT 背景与右下角一张毫无动作起伏的人脸。如果你放任框架将这几千张高度同质化的画面编码进去,大模型的梯度将会被严重带偏。这种数据对模型认知的提升不仅是零,更是负资产。 2. 底噪轰炸与音画分离:大量的生活 VLOG 里混杂着刺耳的狂风噪声音轨、背景轰鸣声,甚至经常出现画面里的人在打高尔夫、背景音乐却在播放欢快流行歌的“音画毫不相干(Audio-Visual Misalignment)”情况。对于需要学习绝对物理因果律(例如看到玻璃碎裂的画面,立刻就要听到玻璃碎裂的声音)的大模型来说,绝大多数野生音视频带来的全都是认知毒药。

10.1.3 被极度低估的解码算力与存储陷阱(IO瓶颈诊断回顾)¶

正如我们在 Ch06(高效加载篇 §6.4)中所复盘过的那样,存储文本只需要读取纯文本 Byte;而存储并在训练期间动态加载长视频,是对底层文件系统的极大压力。 视频数据天生是在压缩域内(如 H.264/H.265/VP9 编码格式)打包存储的。要想提取出模型真正能消化的连续原始像素帧序列以及音频采样率,就必须在加载的第一步将其硬解码(Decoding)。如果 100 张 H100 显卡正饿着肚子等待送入批次数据,此时在前端的 CPU Data Loader 和集群 I/O 带宽早就因为同时解压几百兆的 MP4 流而全线崩溃死锁了。

10.2 切片、转写与时序对齐的“三轨并行流水线”¶

为了驯服这头四维的巨兽,数据清洗工厂绝不能再使用早期图文对时代的“一图配一句(Image-Text Pair)”古典作坊模式。我们需要搭建一套能精确地剥离并处理视觉、声学和文本等多条独立轨道的“音视频样本构建全流程自动化平台”。

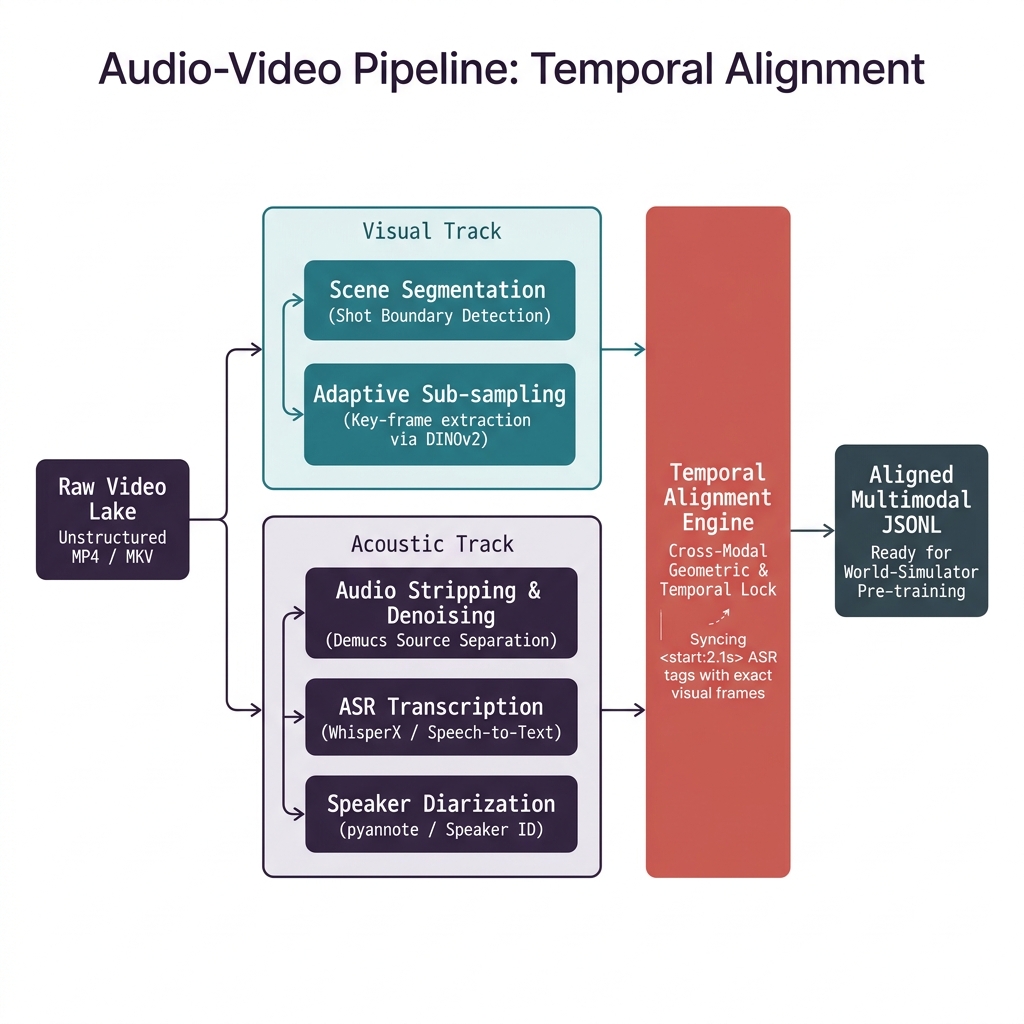

图 10-1:音视频对齐分布式管线图(Audio-Video Pipeline: Temporal Alignment) —— 左侧原始 Video Lake 中的混合视频被彻底剥离拆分为视觉(Visual Track)、声学(Acoustic Track)双轨并行管线,视觉帧提取器与声学分离器各自独立抢救特征后,最终汇集入关键的“跨模态时间对齐引擎(Temporal Alignment Engine)”,强制生成为时间戳严丝合缝闭合的巨幅大模型多模态输入样本(Aligned Multimodal JSONL)。

10.2.1 视觉提取:智能镜头解剖与场景动态切片(Scene Segmentation)¶

在进入训练之前,超长视频(例如 2 小时的电影)必须被斩断成 10 秒到 30 秒不等、在逻辑与镜头上完全连贯的小切块(Clips)。绝对不能使用简单粗暴的“固定时长一刀切(按每10秒切一刀)”,因为那必定会导致一个精彩动作或者一句话在中间被拦腰截断,造成高昂的语义残缺。

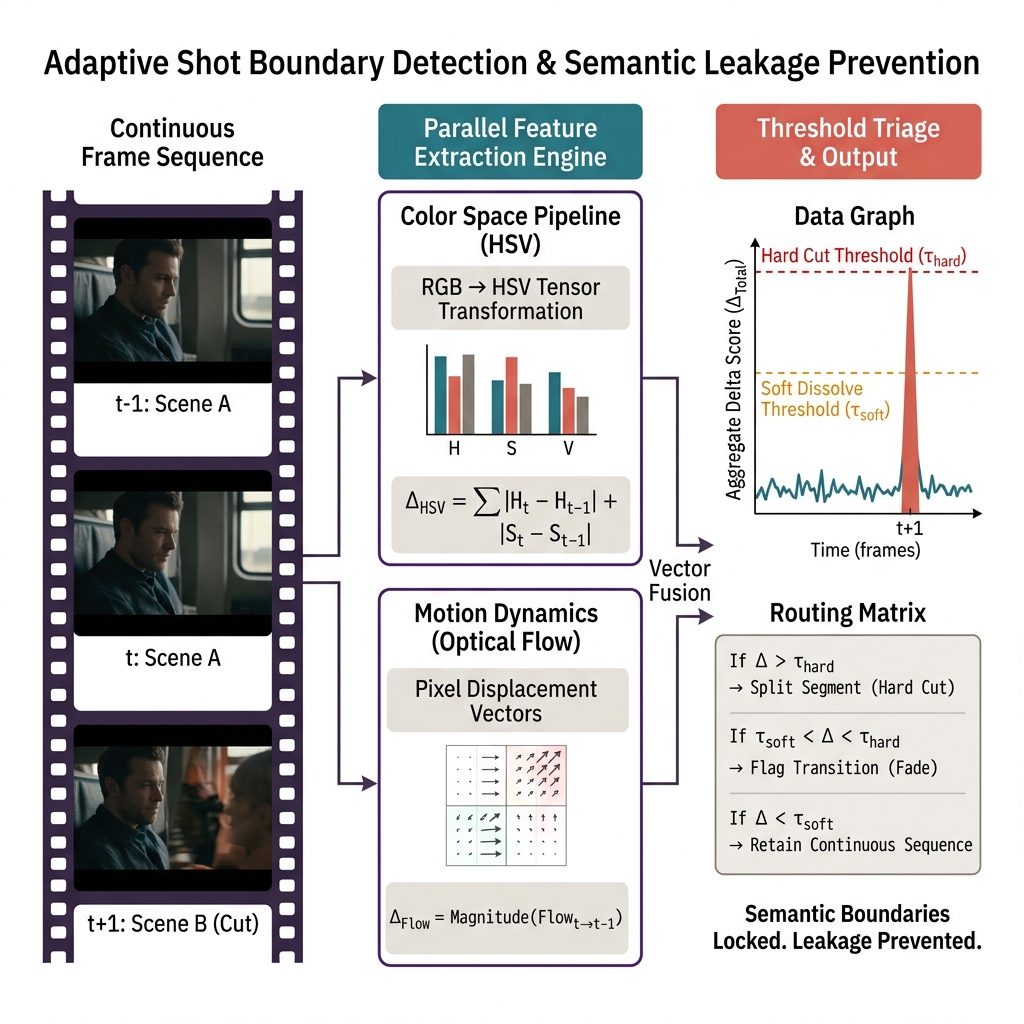

- 关键的镜头切换点侦测(Shot Boundary Detection) 我们需要在视觉流水线(Top Path)中加入一道快速的侦测关卡卡点,如采用双阈值颜色直方图比对(硬切变 Hard Cut 采用高阈值、软渐变 Fade/Dissolve 采用低阈值)或轻量级的两帧之间光流差异(Optical Flow Difference)计算,以捕获视频中由于机位推拉、镜头剪辑引起的硬切变与软渐变。只有在同一镜头内保持的连续帧,才能作为一个完整的知识概念(Event Grounding)被喂给预训练视觉大模型。

图10-2:自适应镜头边界检测与语义防泄漏架构图(Adaptive Shot Boundary Detection & Semantic Leakage Prevention) —— 展现了严密的双轨特征侦测逻辑。左侧输入的连续密集帧列被送入中枢并行矩阵:上层提取廉价但高效的 HSV 多通道色彩空间聚合差分,下层则抓取光流像素位移(Optical Flow)以捕捉细微运动姿态。两种张量差分在最右侧汇入严苛的“双重阈值路由(Dual-Threshold Triage)”。一旦突变分值 \(\Delta\) 击穿红色高压警戒线(Hard Cut Threshold),引擎立即一刀切断分段,将不相关的过场动画与场景转换拒之门外,在源头以最低算力锁死了视觉切片的语义泄漏空间。

- 自适应的抽帧过滤法(Adaptive Sub-sampling) 切片完成后,长达 20 秒内的镜头虽然逻辑连贯,但在动作幅度上可能波澜不惊。工厂会部署小模型去持续验证当前帧与上一保留帧在稠密视觉特征(如 DINOv2 Embedding)上的位移距离。只要超过一个预设的欧氏距离阈值(即当前画面的信息量确实有了新展开),才予以打标保留。最终一段原本含 600 帧画面的 20 秒切片,可能会被精准浓缩成 10 张核心关键帧集合,使得大模型的视觉输入侧负载雪崩式下滑了整整 98%。

10.2.2 听觉剥离:多层转写、降噪与声纹剥离切割(ASR & Diarization)¶

与视觉抽帧双线并行的底层通道(Bottom Path)里,是负责充分利用声音语义的金矿冶炼器。 首先进行的是多路音轨抽离(Audio Stripping),然后进入如下的三层滤网:

A. 核心语义层提取:超大并发的 WhisperX 自动语音识别(ASR)¶

对于蕴含无穷人类思考逻辑的语音轨,我们必须高压调用诸如万卡部署开源 Whisper 或更激进的 WhisperX 框架网络。将其将音频中夹杂着各种口音的杂乱声音翻译成高度准确的结构化文字序列。

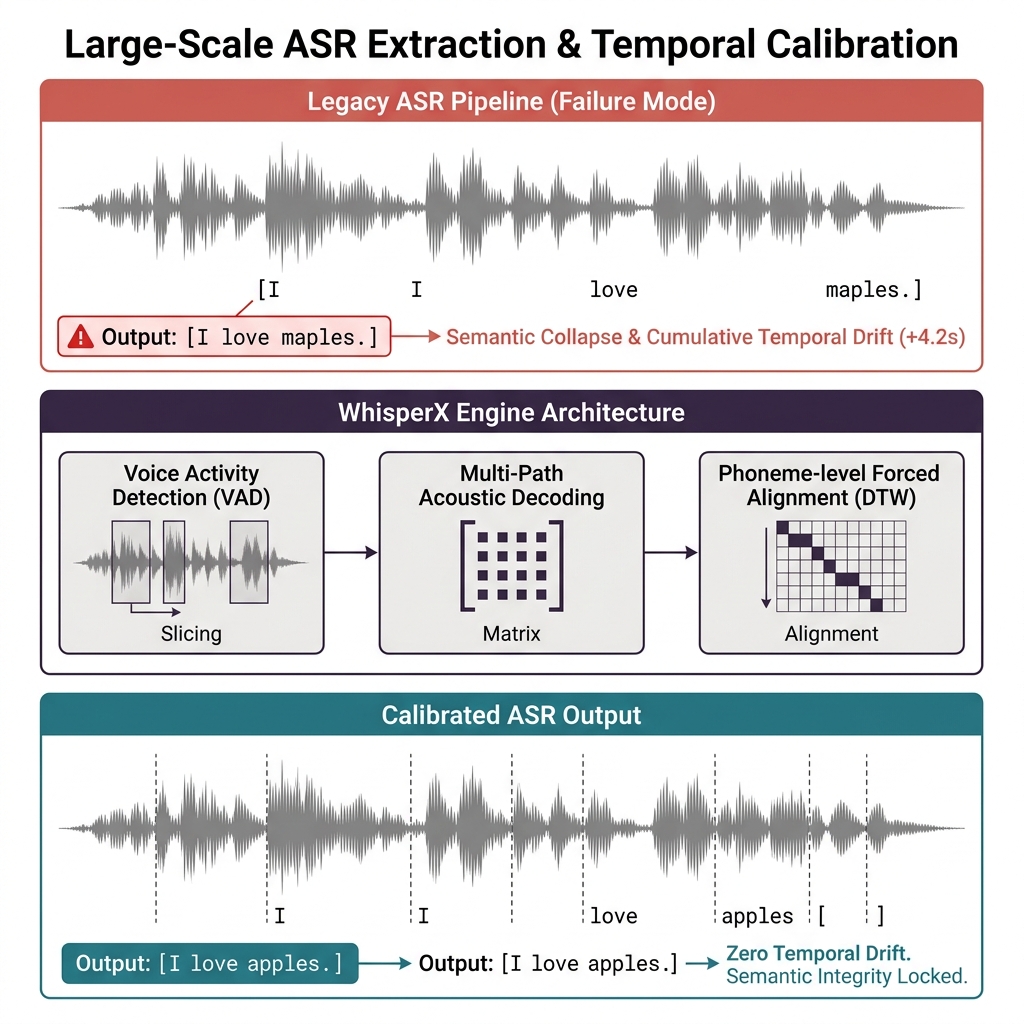

图 10-3:大规模 ASR 提取与时间轴动态校准对比图(Large-Scale ASR Extraction & Temporal Calibration) —— 直观地揭示了声学转写的误差累积与拯救机制。图中最上方为传统的古典 ASR 管道,随着长序列的推进产生了严重的累积性时间漂移(Cumulative Temporal Drift)与致命的语义坍缩(将 I love apples. 误听写为 maples.)。图中间展示了 WhisperX 架构的强势介入:通过 VAD 切分、多路声学解码与 DTW(音素级强制对齐)矩阵,彻底重构了底层特征提取逻辑。而最下方的输出结果中,最终词汇 Token 与音频波谷被垂直虚线(Vertical Dashed Lines)完美死锁对齐,实现了真正的“零时间漂移”,为多模态融合保住了珍贵的语义连续性。

B. 无尽底噪剥离与纯净化(Denoiser Layer)¶

并非所有的视频都拥有演播室级别的隔音。大量野外采集数据混杂极强的风噪或机械共鸣。这就必须动用重型的 Demucs 或基于深度学习的音频分离算法(Source Separation),如同手术刀一般从混响光谱中强制把底层音乐(BGM)、非人类环境声(Environment Noise)和纯净的人声(Vocal)切分开来。

C. “到底是谁在说话?”:说话人日志切分(Speaker Diarization)¶

针对高端对话型播客(Podcast)或者多人围坐的会议视频预训练语料如果一股脑全部压成单轨字符串,模型在训练时根本无法分辨谁在提问谁在解答,只能学到精神分裂的对话。Diarization 算法犹如给声波安上了人脸识别系统,能把一条长音频截断并标注为 [Speaker A]: 01:23-01:30 和 [Speaker B]: 01:31-01:40 这种完美区分了人类物理身份与阵营的回放序列。

10.2.3 多轨时序强对齐工程:字幕、语音、画面的时间维“极度硬对齐”机制¶

当把抽好的视觉关键帧阵列、写好的长串 ASR 字幕、和剥离完的纯净声音波形流收集完毕之后。最残酷的攻坚挑战,也就是真正决定这家 AI 大厂底层数据实力的最具挑战性的对齐工程来了——异构多模态的几何死锁(Cross-Modal Geometric & Temporal Lock)。

一条字幕在 ASR 里写着大大的 “Hello World!”,但在 10 秒钟时序的波段里,究竟是哪几毫秒、哪个帧的哪个嘴型匹配这句声音?如果不强制建立这种时间纽带羁绊(Temporal Anchors),大模型在吸收的时候不仅学不会声画同步,甚至连口型匹配预测都做不出来。

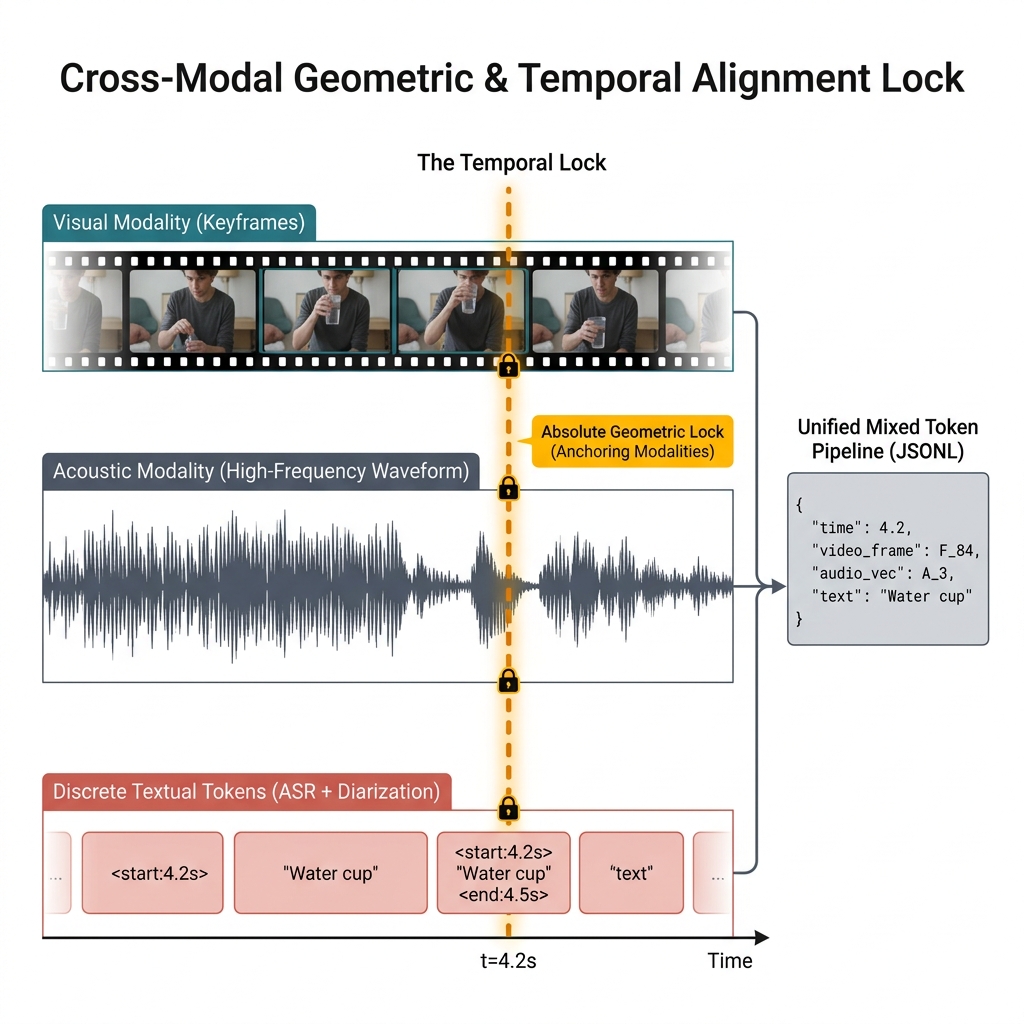

图 10-4:跨模态时序强校准与几何锁死对齐架构图(Cross-Modal Geometric & Temporal Alignment Lock) —— 图中系统化地剖析了三层异构数据的物理拼装赛道:顶端青色轨道的视觉关键帧胶片列阵(Visual Modality)、中段灰色轨道的极高频声波列阵(Acoustic Modality)以及底端珊瑚色轨道的离散转述词块序列(Discrete Textual Tokens)。最为核心的设计在于中央那条贯穿三界的琥珀色闪烁轴线 —— The Temporal Lock (绝对几何时间锁)。当时间轴推移至 t=4.2s 时,这条轴线以物理强制力将“端起水杯的视觉动作”、“波谷处的特定声波特征”与 <start:4.2s> "Water cup" 的纯文本标签钉死在了一起(锚点处的小锁头标志)。最终,这三大被物理捆绑的孤岛矩阵在右侧被高度压缩坍缩,封印成为了一段极其珍贵的大模型时序预训练代码流(Unified Mixed Token Pipeline / JSONL格式),完成了从离散流媒体到世界物理认知课本的升华。

大厂通常会基于时间戳矩阵强制部署 Multi-modal Temporal Alignment Engine(多模时序融合校验门)。一旦前端识别器给出了一条类似 <start:2.1s><end:4.5s> 的坐标界限,代码就必须通过复杂的浮点数判定逻辑,去反切视频的对应帧。而在最后,这些对齐信息并不会单纯以视频形式打包丢给大模型,而是被转换为含有长串元数据集(Meta-data tags)、类似 HTML 的“多轨混拼长序列(Mixed Token Pipeline)”,以高度结构化(JSONL)的方式封印,交给了底层的训练 Dataloader 中展开。

10.3 多模态信息深度强化池与评价漏斗过滤拦截¶

虽然在 10.2 节中我们成功地把视音频分了家并在时间维度强行捆绑了起来,但这批基础框架(Raw Structured Samples)在真正走向预训练引擎的熔炉前,仍旧缺乏更高维度的“事件监督信号(Event Grounding Signals)”和“错配除草剂(Misalignment Killer)”介入。

10.3.1 多层级连续动态事件标签强化生成网络(Event Detection & Grounding)¶

一段野生视频不能只有单纯的画面和念字文本。它缺乏一种高阶的“物理世界动作流描述”。在大厂管线内部,会并行召唤成批的高级大标注辅助模型(如专精于行为理解视频的 LLaVA-Video、Video-LLaMA 等旁路模型集群)。对那些被对齐后的视频小切片发起海量的异步标注洗礼(Asynchronous Captioning Bath)。

它们不仅要给出视频的单剧全局一句话概括(例如“一个青年在滑板公园表演滑雪后空翻失败摔倒”),更要在底层产生细致到让令人发指的阶段性密集标注(Detailed Temporal Captions):

- <time: 01.2s-03.5s>: 男生助跑并借力跃上 U 型池抛面...

- <time: 03.5s-05.1s>: 男生试图在高空实现 360 度转体,但其背部失去平衡...

- <time: 05.1s-06.8s>: 男生后背重重砸在混凝土滑道上,产生沉闷的低频冲击声响。

正是这种融合了前因与后果、因果倒推的强化标签文本注入到了我们上一节制定的那个超长超级多轨对齐树(JSONL)中,这批视频死物在 AI 的神经元里才变得具有真正的“物理时空意义”。

10.3.2 声音与画面错位的幻觉检测防御雷达¶

长时序中严重的对齐错误,是“画面与声音发生了严重的不关联错位”。比如,视频里是一头安静吃草的长颈鹿,而因为视频剪辑者直接在该段混入了一段电音 DJ 舞曲或者一长段毫无关联的游戏解说词片段。如果这类数据顺利流入基座训练,你的下场就是:大模型在被要求看到长颈鹿图片时,会莫名其妙地为你高歌一首 DJ 舞曲并伴随着严重的幻觉(Hallucinations)。

为了彻底根治此类顽疾,工程内部必须引入不讲情面的强惩罚与高昂复检流程:

表10-1:时序流超频数据缺陷类型与多层检测处置策略表

| 缺陷类型与表现 | 根本原因分析 | 检测与修复策略 | 严重程度 |

|---|---|---|---|

| 严重音画不相关(Audio-Visual Hallucination Mismatch):画面是一片寂静森林的远景,而人声音轨却正在用极快的语速直播解说 FPS 射击比赛实况。 | 数据贡献者强行拼凑的二创鬼畜视频,或是自动化压片时的硬轨串线泄漏(Audio Track Bleeding)。 | 使用预训练判别器跑特征余弦比对分数:强行抽出当前中间帧的 CLIP 视觉高阶向量,与提取并编码的人声/音频 Audio 语义向量进行矩阵点乘夹角。如果跨模态向量相似度(Cosines Similarity)跌破预警红线,就地熔断摧毁这十秒的所有标注并废弃出场。 | 终极毁灭 P0 |

| 画面闪烁/黑屏/极端马赛克雪崩(Frame Corruption & Dark Out) | 原视频采集流编码比特率极低崩溃,或者传输网络发生极大程度丢包。 | 计算整段片段的亮度直方图极差均值与锐度得分过滤(Laplacian Variance Filters)。若画面全都是黑死像素点或是均方差模糊溢出,立即触发拦截,不仅要将视频送入黑垃圾池(Trash-pool),并且记录异常并退回抽帧模块反省排查 C++ 解码算子接口。 | 严重 P1 |

| 极端背景环境噪音使得人声淹没不可逆转(Irreversible Noise Flooding) | 现场麦克风破音故障被拉升放大,或者背景包含震耳欲聋且极难在特征池内剥离的高频电锯轰鸣噪音。 | 使用预判小模型针对全频带频谱(Spectrogram)运行声学信噪比基准诊断评估(SNR Estimation),低于底线阈值的人声轨判定为毒药级。如果是对话相关项目则彻底舍弃此视频语料的注入。 | 取决用途 P2 |

10.4 成本深渊算账、极刑量化设计与吞吐巅峰极致提效¶

任何在大语言模型文本序列(Text-only LLMs)上高谈阔论成本的人,在进入多模时序管线后,会看到一份吓到他们辞职谢罪的云服务 GPU 账单。

在文本处理时代,一台廉价的 64 核 CPU 服务器在一天之内足以解析和洗掉将近上亿个长篇 Markdown 爬虫文件;然而在视频大清洗阵营里,哪怕仅仅是读取 1 万小时的高清 MP4 文件序列并把它们在内存中解码转化为最纯粹的张量阵列供特征抽取使用,就能瞬间把这台服务器彻底压死并在两个小时内因过热而物理死机。

10.4.1 解码器算力(CPU/GPU)与 IO 带宽的极限量化¶

最大的深水炸弹就在于“到底用什么硬件去解压缩(Decoding)视频帧”。 1. 纯 CPU 解析防线溃败:在最初期的架构设计中,菜鸟工程师往往贪图便宜、调用纯粹的高配 CPU(配合多线程和简单的 ffmpeg 或者 python 本地 cv2 框架)进行软件硬性解码解码。殊不知,高并发下的内存指针轮转会彻底地霸占住所有 PCIe(高速通道)与 RAM 的传输上限带宽; 2. 硬件编解码网络引擎加速(Hardware Video Decoders, NVDEC):资深架构师一定会选择把消耗并发负载的繁琐解码流程任务卸载至专有硬件。通过调用 GPU 芯片里配置的视频解码纯硬硅晶模块(例如英伟达硬件 NVDEC API)。让极高的显存带宽以严重的数据搬运吞吐量(例如单机秒级吞吐突破五百路同时拉流解密视频文件),直接绕过软存调用。由此让 CPU 得以彻底解放,去全速调度后端所有的评价与校验业务代码流。虽然需要购买极端昂贵的 GPU 计算实例卡片,但在大规模集群分发清洗效率压测下,它竟然是最终极降本的核心手段。

表10-2:严苛的长时序音视频千卡集群(1000 H100 等效)核心处理成本分类分解与降本压榨矩阵

| 后端管线底层切削流程阶段 | 服务器核心资源极度开销大口径分析 | 云成本折算与集群资金占比(大概经验概略占比) | 对应的极限吞吐量优化压榨底层与工程缓解绝招策略 |

|---|---|---|---|

| 阶段 1:原始高压比特流下发、长视频并行拉流抓取与分块网络缓冲下载 | 千兆高防网卡出入流量,大区块对象节点访问 I/O(大量消耗骨干网)。 | 10% - 15% | 极不推崇直接访问长存储池。引入近计算边缘缓存网关节点(Edge Caching Layers),按照预先统筹的分片索引,把庞大的百 GB 大文件化作极小并发数据碎片预加载切入 GPU 临近的高速本地 NVMe 硬盘池上缓存。 |

| 阶段 2:强制画面解码爆破出图与自适应智能过采样 | 属于计算资源消耗的核心节点。显卡的专供视频解码内核单元阵列(NVDEC),以及极少部分配合支持处理调度的 CPU 中央总线流水列阵。 | 45% - 50% (集群计算成本核心) | 实施多尺度硬件下采样方案组合拳,并在流水线调用层面通过精细压榨框架(如 DeepSpeed-UIO 或 DALI 加速驱动)替换低效落后的 Python OpenCV 单流。使得每秒解码解压缩的输出拉升到最高级别极限帧数上限。 |

| 阶段 3:多旁路昂贵的异步标注洗炼(大规模重描述与声学提取如 WhisperX 等) | 密集的高端 GPU 推理矩阵累加计算算力消耗(例如动辄百页的稠密参数运行调用推断),大量极其烧显存。 | 15% - 20% | 使用更廉价的大规模量化轻量级模型(INT8 或更低位宽);严格使用动态批处理组装算法(Dynamic Batching),避免不平齐尺寸所带来 Pad(填充)算力浪费行为。 |

| 阶段 4:最后合集汇聚、大规模多维切块时序大封装排序与写入存储 | 后端云集群高速存储网络挂载(NAS / S3 对象池子)的大规模海量小文件高并发密集地写入 I/O。 | 少于 10% | 永远杜绝使用碎文件散装抛落的存储蠢策。采用诸如 WebDataset 后台、或者 TFRecord 那样的块状多序列巨幅紧凑容器格式并利用管道流形式连续灌满高速硬盘盘面大块空间(这能够给读取与写入负载双向大幅降维减负超 90%)。 |

10.5 工程案例复盘与章节小结¶

10.5.1 大规模视频数据管线失败案例复盘(P 项目系列)¶

在某视频自研项目中,团队积累了超过六万小时的高清混合视频素材,历时三个月的数据集构建工作最终以失败告终。

失败根源在于:工程架构中省去了多重关键的时序校准步骤。音频特征分离模块的接口传参存在约 30ms 的读取偏置(Reading Offset Bug),在数百次切分与合并操作后,该偏置累积导致约 70% 的后半段切片中,演员声音轨道相对口型和动作出现系统性超前或滞后。

将这批存在时序错位的数据送入 800 亿参数模型训练后,经过两周训练,模型的音视频关联能力完全混乱——在基准测试中,只要看到长发人物挥手,就会输出完全错误的声学预测。

这一案例再次印证了本书开篇(Ch01)的核心结论:没有严格的数据预处理工程保障,算法层面的投入无法弥补底层数据的根本缺陷。

10.5.2 本章小结与衔接¶

从第一、二篇的文本清洗,到第八、九篇的图文像素对齐,再到本章处理的长时序音视频数据,我们已系统地掌握了各类异构数据的预处理方法——包括视频帧抽取、ASR 转写、音画对齐、事件标注与质量过滤。

然而,无论数据质量多高,模型在完成预训练后仍需要明确的指令引导和价值观对齐,才能从"能理解世界"进化为"能听从人类指令"。这正是下一篇将展开的核心命题——《第四篇:指令对齐与人类偏好反馈数据系统》,从 Ch11 跨模态对齐延伸至 Ch12 及后续章节。

10.6 附录:工业级音视频管线高频崩溃日志与排雷手册¶

以下精选 5 类在大规模音视频预处理管线中真实发生的、具有代表性的崩溃模式,覆盖 I/O、解码、ASR 对齐、Diarization 和存储写入五大核心链路。每类附根因分析与修复方案,后附全类型速查表。

10.6.1 I/O 雪崩:S3 并发拉流超限导致 DataLoader 死锁 [TMP_ERR_CODE_1001]¶

[故障现象]:千卡集群在启动时,数百个 DataLoader worker 同时向 S3 对象存储发起大块 MP4 拉流请求,瞬间打爆骨干网带宽,节点文件句柄耗尽,训练进程全线卡死。

[堆栈快照]:

[FATAL] node-001.gpu-cluster.internal:

Connection reset by peer. Timeout extracting frame chunk from blob: /bucket-v/dataset/vid_slice_0001.mp4

File descriptor limits exceeded (Too many open files).

RuntimeError: Multiprocessing synchronization lock stuck at DataLoader worker 1.

AVSync_Module: Subtitle timestamp [1.21s] completely drifts out of matched acoustic window bounds.

[根因与修复]:

- 根因:未设置随机抖动退避(Exponential Backoff),所有 worker 在同一毫秒同时发起大块请求。

- 修复:①在 PyTorch DataLoader 读取逻辑中加入 jitter_sleep(0–500ms) 重试机制;②执行 ulimit -n 1048576 扩大文件句柄池上限;③将每次 S3 分块颗粒度从 128MB 降至 2MB,改用边缘缓存网关节点(Edge Caching Layer)预热到 NVMe 本地盘后再读取。

10.6.2 NVDEC OOM:GPU 硬件解码器显存溢出 [TMP_ERR_CODE_2001]¶

[故障现象]:在使用 NVIDIA NVDEC 硬件解码器进行高分辨率(4K)视频并发解码时,显存瞬间爆满,整个解码进程崩溃并拖垮训练节点。

[堆栈快照]:

[FATAL] node-007.gpu-cluster.internal:

NVDecCreateDecoder failed: CUDA_ERROR_OUT_OF_MEMORY (error 2)

Video resolution 3840x2160 exceeds NVDEC hardware capability on A100-40GB.

cudaMemcpy failed during frame copy: cudaErrorIllegalAddress

Decoder context invalidated. All queued frames dropped (estimated loss: 2.3TB).

[根因与修复]:

- 根因:4K 分辨率超过 NVDEC 单实例容量上限;多路并发解码未做显存配额隔离。

- 修复:①在解码前强制降采样到 1080p(-vf scale=1920:1080);②每张 GPU 限制最大并发解码路数(H100 建议 ≤24 路 1080p);③使用 DALI 的 VideoReader 替代 OpenCV,内置显存 quota 管理。

10.6.3 ASR 时序漂移:WhisperX 长视频字幕时间戳大幅偏移 [TMP_ERR_CODE_3001]¶

[故障现象]:对超过 30 分钟的长视频进行 ASR 转写时,WhisperX 输出的字幕时间戳在后半段产生累积性漂移,最严重时达 8–12 秒,导致音视频对齐完全失效。

[堆栈快照]:

[WARN] whisperx_worker_3: Timestamp drift detected at segment 847.

Expected anchor: [1823.4s], Model output: [1831.8s]. Delta: +8.4s.

[ERROR] TemporalAligner: Cross-modal lock failed — audio anchor outside visual frame window.

Alignment quality score: 0.23 (threshold: 0.75). Segment rejected and quarantined.

[根因与修复]: - 根因:WhisperX 使用 VAD(语音活动检测)切段时,静音片段被错误跳过,导致时间戳累积偏移;长视频中 BGM 混音干扰 VAD 判断。 - 修复:①将超过 15 分钟的视频强制切割为 10 分钟子段后再转写;②在 VAD 前先做 Demucs 人声分离,去除 BGM;③以 30 秒为窗口滑动校验时间戳锚点,超过 0.5 秒漂移立即触发重对齐。

10.6.4 Diarization 崩溃:说话人分离模型内存泄漏导致进程 OOM [TMP_ERR_CODE_4001]¶

[故障现象]:长时间批量运行 pyannote-audio Diarization 任务时,进程内存占用随批次数线性增长,运行约 4 小时后触发系统 OOM Killer,所有已处理任务结果丢失。

[堆栈快照]:

[ERROR] diarization_worker_12: Killed by OOM Killer (signal 9).

Process memory at kill time: 187.3 GB / 192 GB RAM.

pyannote.audio: SpeakerDiarization pipeline not released between batches.

torch.nn.Module references retained in embedding cache (est. leak: 2.1 GB/batch).

Unprocessed queue depth at crash: 3,421 audio segments (est. 68h audio).

[根因与修复]:

- 根因:pyannote Pipeline 对象在批次间未被显式销毁,嵌入缓存不断累积;PyTorch 计算图未及时释放。

- 修复:①每批次处理完后显式调用 del pipeline; torch.cuda.empty_cache(); gc.collect();②使用独立子进程(multiprocessing.spawn)运行每批 Diarization,批次结束后进程退出自动回收内存;③限制每批次处理音频长度上限为 2 小时。

10.6.5 WebDataset 写入碰撞:多进程并发写入同一 shard 导致文件损坏 [TMP_ERR_CODE_5001]¶

[故障现象]:分布式清洗管线在最终封装阶段,多个 worker 进程并发向同一 .tar shard 文件写入,导致文件结构损坏,训练时 DataLoader 抛出解析错误。

[堆栈快照]:

[ERROR] training_node_44: WebDataset TarReader failed on shard: /data/processed/shard_0023.tar

tarfile.ReadError: invalid header magic bytes at offset 2147483392.

Estimated corrupted samples in shard: ~4,200 (approx 12.3GB of aligned multimodal data).

DataLoader worker 0: Pipe broken, resetting shard iterator. Skipping shard.

[根因与修复]:

- 根因:未使用写锁(file lock)或分 shard 策略,多进程并发写同一文件导致字节流交叉写入。

- 修复:①每个 worker 分配独立 shard 文件(按 worker_id 命名);②写完后再由主进程合并或直接上传到 S3;③使用 wids(WebDataset Indexed Shards)格式替代 .tar,支持安全随机写入与索引。

10.6.6 高频错误速查表¶

| 错误代号 | 错误类型 | 核心触发条件 | 一句话修复策略 |

|---|---|---|---|

| TMP_ERR_CODE_1XXX | S3/I/O 超时雪崩 | 千卡并发拉流无抖动退避 | 加 Jitter Sleep + 边缘缓存预热 |

| TMP_ERR_CODE_2XXX | NVDEC OOM | 4K 视频无限制并发解码 | 降采样至 1080p + 限并发路数 |

| TMP_ERR_CODE_3XXX | ASR 时序漂移 | 长视频 VAD 错误跳过静音段 | 分段转写 + 滑窗校验时间戳锚点 |

| TMP_ERR_CODE_4XXX | Diarization OOM | Pipeline 对象批次间未释放 | 子进程隔离 + 每批显式 gc.collect |

| TMP_ERR_CODE_5XXX | Shard 文件损坏 | 多进程并发写同一 .tar | 每 worker 独立 shard + 主进程合并 |

| TMP_ERR_CODE_6XXX | 音画不相关幻觉 | BGM 混入训练语料 | CLIP-Score 跨模态余弦过滤 < 0.3 |

| TMP_ERR_CODE_7XXX | 解码帧乱序 | ffmpeg seek 精度问题 | 强制 -ss 参数放到 input 前 |

| TMP_ERR_CODE_8XXX | SNR 过低音轨 | 野外噪声超过 40dB | Demucs 分离 + SNR < 15dB 丢弃 |