第9章 重标注与文档理解¶

在上一章中,我们详细探讨了多模态数据清洗的前置流水线。通过剥离低分辨率图像、去除水印干扰、过滤敏感内容,并利用 CLIP Score 截断图文语义背离的劣质样本,我们在物理层面上构建了一个相对纯净的数据湖。

但当我们兴高采烈地用这批号称“黄金数据”送上训练集群,满心期待训出一个能和 GPT-4V 扳手腕的视觉模型时,现实往往是一盆极其冰凉的冷水——模型似乎只能当个“近视眼的傻子”。 当你问模型:“图中穿红衣服的女孩在干什么?” 模型会回答:“这里有一个穿红色衣服的女性。” 当你上传一张《财富》杂志全英文的财报扫描件,问模型:“2023年该公司的 Q4 营收涨了多少?” 模型不仅大概率答非所问,甚至会对密集的财报数字当场捏造幻觉。

这就引出了多模态数据工程步入深水区的核心命题:为什么极其干净的图文数据,依然不足以支撑一个能思考的高级多模态模型? 本章将解答这个问题,并带你深入多模态两大硬核高精尖工程:高质量重标注策略(Re-captioning) 与 OCR 结构化文档理解(Document Understanding)。

9.1 为什么原始 Caption 远远不够用?¶

9.1.1 “弱描述”与“漏描述”带来的能力阉割法则¶

即使那些经过前置流水线(如基于 CLIP Score 的双塔计算,余弦相似度拉满的对齐操作)层层筛选出的多模态数据,其绝大部分源头依然是基于全网粗暴爬取的。互联网文本生态存在一个根深蒂固的问题:网页开发者为了追求极致的页面加载高效、抑或是 HTML 文本填充组件(Alt-text)的天然设计局限,原生网页对网络图片的伴生描述普遍是极度“干瘪”(Impoverished)甚至是敷衍了事的。

以大规模开源数据集 LAION-5B 中的某个典型样本为例:一张拍摄到了金色阳光斜射的实木书桌,桌上放着一把樱桃青轴机械键盘、一杯喝了一大半的冰美式咖啡,且背景有着极具层次感的模糊书架(一张极高分辨率的 1080p 摄影图)。但在数据工厂爬取的原生态配对中,其极其简短的文本标签(Caption)很可能只是:

“一个普通的办公桌桌面” 或者仅仅是 “IMG_2023_Office.jpg”

对模型底层重构网的破坏性: 这种数据如果大量充斥在流水线中,其危害远大于“脏数据”。这是一种慢性毒药。如果将海量类似于“办公室一角”这种极度模糊、高度泛化的标签当做 SFT(监督微调)或者预训练的对齐前缀给到大语言网络,模型会将画面中整整 200 万个高清红绿蓝像素矩阵(RGB Pixels)全部暴力压缩并试图去拟合这短短 6 个汉字的条件概率。 因此,在这场跨模态的运算中,模型压根就不会去学习“半杯咖啡的反光”、“机械键盘键帽的凹陷”以及“阳光照射的真实光影方向”在视觉编码器隐空间里的确切表征向量。这种由于文本特征严重偏科或缺席,导致视觉模型自动屏蔽小面积物体的现象,在深度学习工程界被称为“弱描述导致的密集物体失明(Dense Object Blindness / Entity Dropout)”。

这不仅导致模型彻底丧失了细节特征捕捉的精细颗粒度,更可怕的一点在于,漏描述会引发严重的逻辑对齐冲突与训练震荡。设想图片里明明占据主位的是一只白猫,而爬取的短文本只字未提“猫”,只提了“白色背景”。那么当强大的视觉编码器(Vision Encoder)本能地抽取出猫的轮廓向量特征,然后顺着反向传播梯度强行要求与目标文本对齐时,视觉网络就会陷入极其崩溃的“隐性矛盾”中。它会误以为猫的轮廓就是“背景”二字的具象化,从而极大地损害最终多模态基础理解层在各项客观榜单中的稳定性评估成绩(例如导致模型在 MME 、MMBench 的目标检测与归纳分数上止步不前)。

9.1.2 简略描述与长文本细节描述的生态壁垒差异¶

在真实的研发与数据蒸馏管线(如支撑千亿参数基座的 P03 项目)中,数据架构师深知不能奢求“一套数据打通关”。为了使多模态基础模型的能力如阶梯般平稳爬升,必须在不同的训练阶段,将视觉数据严格划分为截然不同的文本粒度大类去投喂:

- 简短核心感知描述(Brief / Short-form Caption):

- 展现形式:像“一只奔跑的金毛犬”或“两辆停泊的红色轿跑”。

- 核心效用:此类数据成本低廉且容易获得(几十亿条级别)。它的唯一价值,是能够在多模态预训练极为早期的对齐阶段(Stage 1: Modality Alignment)迅速建立投影关系。

-

工程隐喻:它就像是在给模型发“看图识字卡片”,强行教会 Transformer 底座如何将基础物理世界解构件的外形与最基础的名词词典(Vocabulary)建立坚不可摧的底层绑定系数。不能多喂,喂多了模型就不会长篇大论了。

-

长文本密集结构化描述(Dense Detailed Caption / Recounting):

- 展现形式:如“在一片光线充足的午后草地上,天空飘着两朵稀薄的积雨云。一只毛发边缘沾有少许晶莹水珠的金毛犬正张着嘴向画面右侧奔跑,它的嘴里紧紧叼着一只带齿痕的红白相间塑料飞盘。背景有两棵因为相机大光圈虚化而显得极其模糊的百年橡树,画面整体色调温暖,呈现出一种充满张力的动感氛围。”

- 核心效用:此类数据资源稀缺,原始互联网上抓取量极少,只能依靠昂贵的二次计算人工合成或机器渲染。

- 工程隐喻:它属于高级燃料。只有在高阶 SFT 微调阶段(Stage 2 & Stage 3: Visual Instruction Tuning & Preference Alignment)被克制而精准地大量注入,才能逼迫并教导那个沉默寡言的模型打破“哑巴”状态,真正做到“如顶级人类观察者一般巨细靡遗地视察周围复杂环境并流利叙述”。

因此,要让模型从单纯的“看图识字(感知)”走向庞大深邃的“图像理解、世界规律推理与共情(认知)”,唯一的数据破局解法就是彻底丢弃原生爬取的廉价低质文本,踏入另一条大量消耗昂贵 GPU 并行计算成本、但最终对齐产出价值爆棚的硬核主赛道:Synthetic Re-captioning(大模型合成重述工程)。

9.2 工业级重描述策略 (Re-captioning) 的火力阵列¶

重描述(Re-captioning)的核心底层思想其实非常直白:既然野生爬来的标签数据太烂、太缺细节,那我们就倒逼流水线,让算力更强的闭源视觉大模型(甚至不惜动用到专家标注员)把海量的废土图片重新仔细地端详一遍,并写出一套令人赏心悦目的高质量解析长文。

然而,在这个动辄以“10亿张图片过滤”为基础单元的预训练战场上,重修十亿量级图片所消耗的 API 调用费与 GPU 显存日租足以摧毁任何一家中型 AI 公司的年度算力财报预算。因此,不能对所有图片一视同仁。建立包含多层级过滤分诊、级联降级策略自动化并发流水线调度打法,成为了工程师们在此立足的唯一根本。

9.2.1 金字塔分层流水线:从小尺寸快刷到大模型互审 (MoE-Judge)¶

在真实的工业数据工厂中,为了兼顾昂贵的 GPU 算力成本和标注的纯净度,业界通常不会“一招鲜吃遍天”,而是会采用严密的倒金字塔式漏斗调度策略(Pyramid Triage Strategy):

(1)底层基建清刷:开源模型自动化批量重注(Fast Prompting)¶

对于那些构图简单、基础物体占比超过 70% 的低端常识自然图像(如一张单纯的风景照或单色背景下的商品图),如果动量庞大数十亿,那么雇佣数据标注员甚至调用昂贵的 GPT-4V API 都是对金钱的犯罪。在这庞大如海的底座阶层,数据工程团队必须依赖部署于企业内部私有算力集群上的、且极易量产部署的“小参数但表现强悍的开源视觉模型”(如 LLaVA-1.5 7B、Qwen-VL-Chat、InternVL-1.2 等)去进行 Fast Prompting (流水线快刷)。

严苛的 Prompt 模板约束示例: 想要避免开源小模型写成发散的记流水账,Prompt 工程必须极度收敛。

[System Instruction]: You are a neutral, highly objective visually impaired helper.

[Task]: Describe the main objects, actions, and physical background in this image concisely and accurately.

[Constraint]: Do NOT use any generic filler words like 'This is an image of' or 'I can see'. Do NOT guess the location if no text is shown. Keep the entire response strictly under 50 words. Focus solely on visible facts.

(2)中坚层对冲:多模型交叉互审机制(Multi-Model-as-a-Judge)¶

当我们面对稍微复杂的“交错场景”图像、密集的杂乱环境或是含有细微文化特征的图片时,单一的百亿级别开源模型必然会暴露其致命短板——极其严重的幻觉发散倾向(例如把地上盘踞的一条黑色花园灌溉水管,信誓旦旦地辨识成一条巨大的黑色毒蛇)。 为了抵御这种不可避免的单一模型隐性缺陷,流水线会自动将此类复杂批次升级切入到 “三盲交叉互审制(MoE-Judge)” 流水线中: 1. 并行分诊(Parallel Inference):图像同时且独立地送入架构截然不同的视觉引擎 \(V_1\) (如基于 CLIP 偏向的 LLaVA)、\(V_2\) (如参数量庞大的专有版 InternVL)、以及 \(V_3\) (如偏向结构化认知的 Pix2Struct 或 Donut)。 2. 异构体产出(Heterogeneous Output):这三个视觉脑子会同时吐出三段极度不同的描述 \(C_1, C_2, C_3\)。 3. 判官裁决(LLM Judgement & Fusion):此时不需要任何视觉功能,直接切入一个极其强悍的纯文本逻辑裁判(比如 Claude-3.5-Sonnet 或 GPT-4-Turbo)。裁判会提取三个描述中的“重叠高频语义实体(Overlapping Semantics)”,并将三人产生分歧(只有单方观察到)的边缘名词或者可疑实体全部无情抹平。进而熔炼出一个兼顾了“细节丰富”却又“事实防弹壁垒极高”的无争议重述结果。

(3)顶层提纯:强人工精调与 Golden Truth 标尺确立¶

在整个漏斗流水线的最顶层(通常这部分数据仅占数据湖总量的不到 0.05%),自动化的脚本彻底沉寂,数据科学小组会向外部的精锐团队下达高昂的工单。 这些人工描画不是随便扔给众包平台的日结临时工就可以应付的。由于多模态对齐对于名词的精确度和层级结构有着类似于数学定理般的严谨追求,必须经过长达四周系统培训的精锐标注员(甚至要求本科以上学历)出马。他们要在专用的内部圈注工具上对细小边角逐一打靶。这一小撮数据虽然少,但它构成了随后重描述打分系统(Reward Model)或者微调底层基座模型(Base Model)时唯一不可撼动的终极 Golden Truth(金标真值库)。

表9-1:重描述自动化生产梯队对比与优劣表

| 重述层级调度方式 | 每百万张评估成本 | 集群并发生产吞吐速度 | 复杂场景及图表解析能力 | 核心优越性与落地防范隐患 |

|---|---|---|---|---|

| 小参数 VLM 本地批刷 (参数 \(< 15B\)) | \~$100 极低 | > 14,000 张/节点/小时 | 极弱(面对表格几乎完全空白) | 优势:纯属白菜价算力,能快速建立底层基础物体的对齐认知护城河。 防范隐患:极易产生幻觉灾难,绝不能用于细粒度训练。 |

| 头部商业 API 提纯 (API 如 GPT-4o) | \~$15,000 | 严重受限 (并发限流 \~5K/小时) | 极强,逻辑满分 | 优势:拥有无与伦比的语境常识感知,产出的长文本高密度、高质量。 防范隐患:燃烧预算飞快,且由于 API 的安全对齐过严,极易频繁遭遇阻断拒绝回答。 |

| 私有化混合框架多路互审 | \~$800 (纯折算内部消耗卡时) | ~ 2,000 张/多节点/小时 | 较弱 | 优势:完全本地自建防泄漏泄密,极大程度地通过交集抹杀了低级发散幻觉。 防范隐患:节点架构极其臃肿,三节点串行等待严重拖慢节奏。 |

| 多轮高昂的人工精标 | \~$200,000 以上 (天价成本) | < 50 张/专家/小时 | 完美全解解析,附带情绪色彩 | 优势:作为唯一不可被挑战的标尺质量天花板,指引模型上限。 防范隐患:毫无规模化放量的可能,人类标注员也极可能因视觉疲劳导致低级拖拽错位。 |

9.2.2 从“看图背书”到物理世界指引:细粒度对齐与 BBox 双向注入¶

传统的 Image Caption 技术最大的瓶颈在于:它仅仅将图像当成了一个个词汇的“堆填区(Bag of Words)”。只靠猛力堆叠文字词汇,依然不能打造出顶尖的具身智能(Embodied AI)或视觉助理模型。如果你想要让模型真正具备强悍的数学几何感、物理方位感以及对现实空间的控制力,我们必须在数据工程上引入一项具有颠覆意义的重磅操作:细粒度属性定位标记 (Fine-grained Grounding)。

毫无疑问,在这个深度技术模块的加持下,原本用来给人类阅读的连续文本,其底层的构成逻辑发生了翻天覆地的异变。文本本身必须化身为一套“自带微缩坐标系”的数据流标记结构:

在重写高分图片的描述流水线上,架构师会在旁路(Side-car Workflow)强行唤醒如 GroundingDINO 乃至专门训过的 SAM (Segment Anything Model) 等极强的零样本物件检测界碑框架。这些极度冷静冰冷的目标检测器,会如剥洋葱般提取到画作中所对应物体的精确像素或归一化坐标序列(例如:画面深处的一颗苹果精准定位于 [x_min=320, y_min=550, x_max=450, y_max=690] 这一微弱的包围盒中)。

面对这种底层结构,下游负责整合的文本组装 Python 脚本,将绝不再是仅仅满足于输出一句温吞的“一个通红的苹果放置在靠左下侧的方桌上”,而是会强硬地截断生成,并向这串本是给模型食用的自然语言字符串矩阵中,极其暴力地注入结构化且闭合的 XML 定位标记:

在画面深处的木制方桌的左下位置(阳光暗面),静静放置着一颗红润透亮的 <object name="apple" bbox="[[320, 550, 450, 690]]">苹果</object>,不仅如此,紧贴着它的左侧还有一摞极其陈旧的厚重 <object name="book" bbox="[[500, 520, 680, 750]]">相关医学书籍</object>。

为什么要进行如此具有破坏性而繁琐的数据组装?

这是因为 Transformer 本身并没自带对于“远近左高低”的空间绝对感知。当成千上万、多达数百万个这种从“人类口语词汇”横跨到充斥着密集排列的 [Bbox_xx_yy] 离散坐标数字令牌的数据组合进入训练引擎(SFT 流水线)被疯狂吸食之后,奇迹便会彻底发生:

在随后的推理评测中,这个模型便犹如开了天眼一般。它不仅能在回答“图里有什么”时对答如流,更能在你质问它“指给我看苹果在哪里”时,精确地在输出的回答语句中自带出一套坐标点阵,并在 UI 返回界面上精准地框选出一个极高质量的精密红框。这不仅是跨越幻觉最硬核的对抗手段,这也是诸如网页代理执行机器人(Web Visual Automation Agent)等诸多高端应用的唯一底层数据法则。

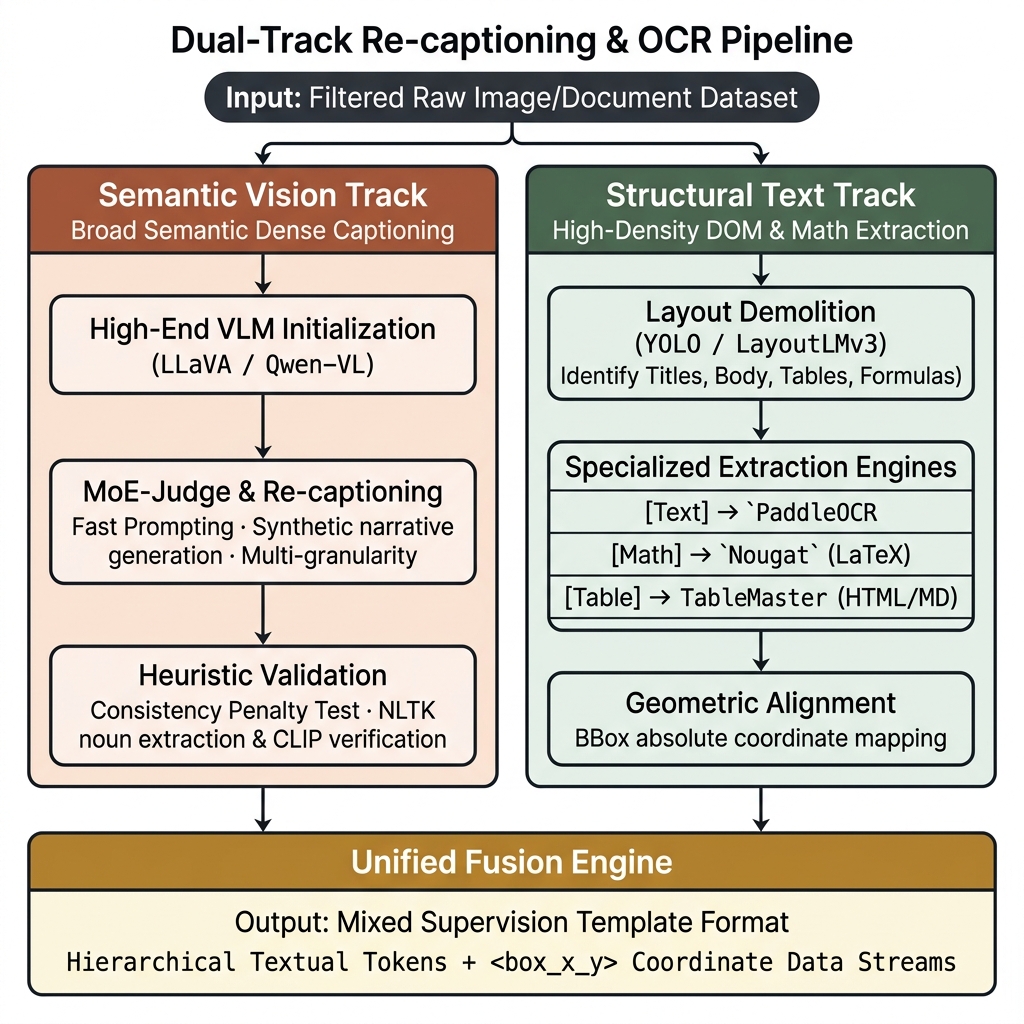

图9-1:重标注与 OCR 增强联合的双轨高阶管道图(Dual-track Pipeline) —— 全景清晰展示了现代数据引擎的两副面孔:左侧展现了从高配 LLaVA 切入最后融入重重启发式核验打分的宽泛语义密集叙述流(Semantic Vision Track),而右侧则展示了即将要步入雷区的最强硬骨头:强制包含苛刻的 DOM 排版分割与表格数学矩阵萃取的高密度结构流(Structural Text Track)。最终这截然不同的两派功夫将在最底部的归一融合引擎结为统一的混合监督模版格式。

至此,针对自然图像与纯景物类图片的重标注强化管线已经建立完毕。然而,真正能够在商业落地中区分企业级视觉大模型竞争力的,是接下来的高密度字符深水区:面向长文档的强阅读推理与复杂商业报表的结构化解码解析。

9.3 突破视觉像素极限:OCR 增强与长硬干文档理解¶

在自然景物图片中,普通的基座 VLM 似乎对分辨“这是金毛犬还是边境牧羊犬”驾轻就熟,仿佛已经具备了超越人类的认知。可一旦你给它投喂一张扫描版的增值税发票,或者包含了密密麻麻多级标题、嵌套合并单元格的 PDF 商业行研定量报告残页,哪怕你丧心病狂地把图像强行切分推高至 AnyRes 甚至夸张的 4K 分辨率输入,模型给出的答案依然会令人极度啼笑皆非:它不是理直气壮地读错关键的小数点,就是把第一列和第三列的财报数据硬给跨栏交叉连线,最终导致幻觉满天飞。

这背后的深度机理在于:无论多么庞大、架构多么花哨的 Vision Transformer (ViT),它的卷积降采样(Down-sampling)或自注意力机制的本质,始终是在提取大块连贯区域的平滑光影与颜色纹理规律(如猫毛的质感、天空的渐变)。然而,人类社会发明的文本符号恰好与纯视觉的低频渐变相反:文字是极端稀疏、频次极速变幻、充满高频断崖的离散突变点。对于字符而言,差一个偏旁部首,也就是差了 5 个像素,其代表的语义可能南辕北辙。指望大语言模型仅仅依靠纯视觉 Encoder 自身的权重,去从茫茫的 16x16 Patch 中领悟微弱的符号跳变规律学得认字认算,这就如同希望闭着眼睛的猿猴直接学会敲击键盘写出操作系统内核代码一样绝望。

为了攻克这道似乎违背了信息论法则的铁腕屏障,数据工程领域不得不从纯端到端的迷梦中醒来,并坚决引入了一条较为繁琐但实证有效的古典混合辅线:外挂 OCR 与文档解析强制增强流水线 (Optical Character Recognition & Layout Boosting)。

9.3.1 文档图像的结构化拆卸工序 (Layout Demolition)¶

处理长文档绝不仅仅是调用一下网上的某个百度 OCR 或者 Google Vision API 服务,拉回连续文本就万事大吉了。商业长文本存在常见且难处理的非线性视觉排版(Non-linear Layouts):左右分栏的双栏学术论文、横插在段落中间的财报宽图、侧边竖排的审阅注释、甚至毫无营养的页眉页脚和防伪水印干扰。如果在塞入模型之前不预先进行基于视觉结构感知的“解构重组”,暴力提取出的文字序列在模型语言大脑的眼里将毫无逻辑,阅读顺序完全错乱。

在顶流的数据清洗车间中,文档的预处理会被切割为如同流水线装配一般的严密层级:

- 第一层:版面边界截断网(Layout Detection via DocLayNet / YOLO) 我们要上的第一把重型手术刀,是专门用千万张结构标注图库打磨过的核心版面区域定位网络(如基于 YOLOv8 的布局分析架构或是微软的 LayoutLMv3)。它的唯一物理任务绝对不仅是阅读字,而是圈发诸侯疆场。算法会在几十毫秒内精准定位出:该版面哪里是粗体的标题组(Title),哪里是密集的正文池(Body Text),哪里是不起眼的脚注(Footnote),哪里是插入的柱状图容器甚至包含等宽格的代码块(Code Snippet)。

- 第二层:异构区域的精准转述与领域特化提取引擎 一旦原本完整的 PDF 被版面截断网给彻底“拆除粉碎”,分离封装好的各类独立像素模块(Cropped Patches)就会被分别打包,并发推送(Dispatch)给不同的专用 OCR 爬证甚至极其特化的编译器模型中进行抢救萃取:

- 对于纯文字段落,分发给具有超高容错性的 Tesseract 或者 PaddleOCR 进行高精度拼写矫正提取。

- 遇到密集的复杂学术公式组,标准 OCR 会面临极高的错误率。这部分切块需要路由给专门微调过的开源引擎(如 Nougat)或高质量的商业服务(如 Mathpix),将数学公式转化为严谨闭合的 LaTeX 代码流(例如:

\int_{0}^{\infty} e^{-x^2} dx)。 - 碰到最为头疼的多模框(带有合并单元格与跨页表头的表格图表),连版面网络都会发憷。必须重载调用类似 TableMaster 的专精架构,经过极慢推理后,强制转换为人类难以肉眼拼写、但机器读起来极工整的长篇 HTML 表格标签链或者多维带属性 Markdown 树。

在这其中,此处的工程难点在于坐标全对准机制(Modality Absolute Geometric Alignment)。提取出的这三类文字如果不与图片上的像素区域建立明确的羁绊,多模态模型依旧不知道眼睛该往哪儿看。于是业界创造了类似上文那样繁琐的 <box_coord> 的文本映射串,迫使阅读神经注意力必须遵循这些“带刺的坐标指南针”移动。

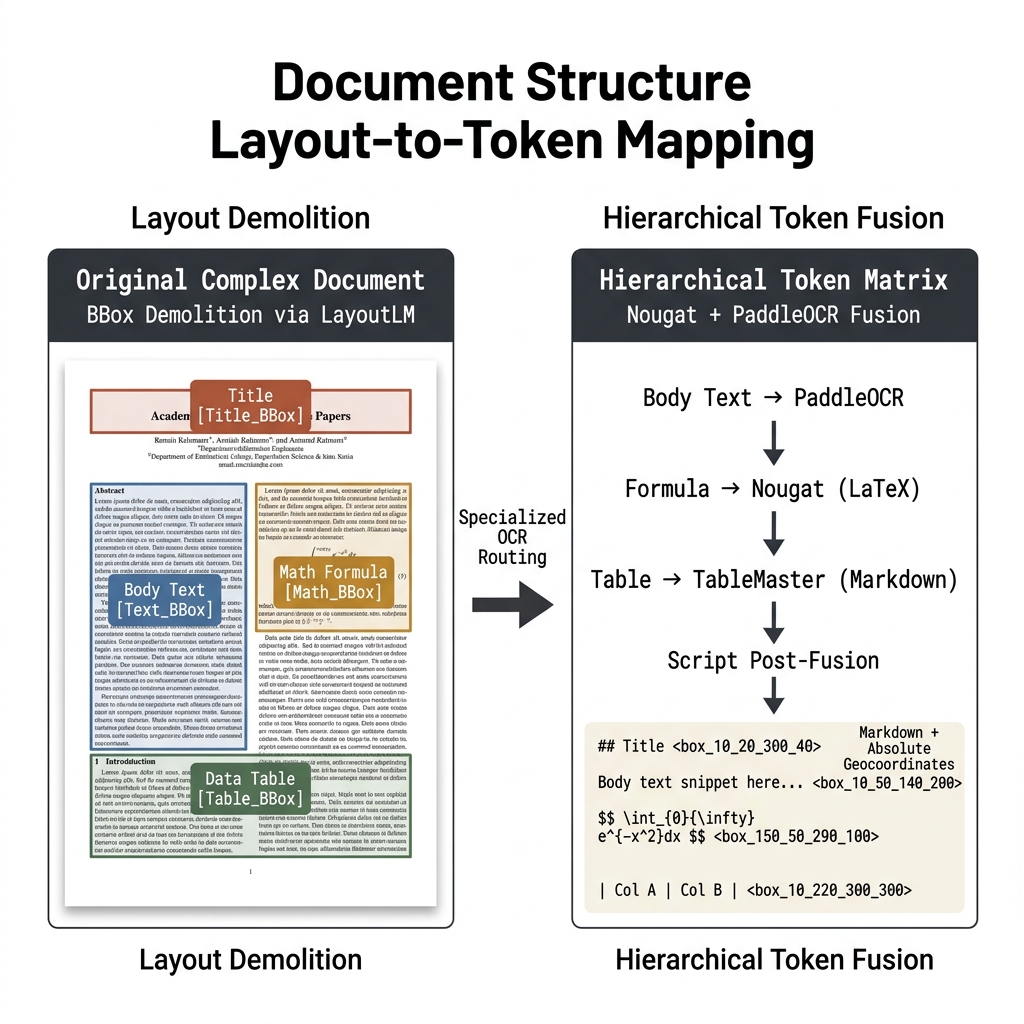

图9-2:文档结构 Layout-to-Token 映射图(Document Structure Layout-to-Token Mapping) —— 图中左半区全景展示了一份经典的极度复杂双栏学术报告残页;系统首先通过 Bounding Box 阵列将其残暴洗劫与拆卸提取(配合各异的红黄蓝分类颜色锚框标注);而右半区则详尽地解剖了:由外挂特化模型矩阵(Nougat+PaddleOCR)各自为战硬解析后,又是如何通过脚本后置强制归并,最终交织生成为层级深渊分明的(Hierarchical Textual Tokens) Markdown 代码文本 + 精确离散绝对坐标 [x_y] 的巨长富文本数据流。正是这批包含了海量知识拓扑的数据流,构成了深度教导基座 SFT 从此“懂得认知世界规整排版”的终极“微积分强化课本”。

9.3.2 “强文本引擎”对超高分辨率的碾压收缩与降维打击¶

这种建立在“视觉特征提取 -> Bounding Box -> 结构化离散字符串序列”基础上的数据预处理机制,一旦打通,将极大地释放底层训练集群的计算瓶颈。因为原本需要视觉模型在训练期耗费大量算力去识别的高难度字符集,已经在外挂预处理车间(CPU/GPU 混合 OCR Pipeline)中被解析为了长文本 Prompt,并作为上下文输入。此时,视觉模型只需在相对较低的分辨率下快速处理全图,提取宏观的排版布局与物理空间特征即可。

系统随后将立刻切断视觉端的所有负荷,将所有剩下的长文本账单深究主场任务(如第三行和第十行的乘积是多少),统统让渡给大模型基座体内那个深沉如海、强悍无匹、计算成本相对廉价的长上下文序列分析器(Long-context LLM Brain)。 这就将多模图文理解这场超级难缠的二维恶战,降维打击式地拉扯到了超十万字上下文运算阅读 (Long-context Comprehension) 这一大语言自然模型最无敌、也是其最擅长统治的主战场赛道之上。这也直接揭开了为何近期涌现的那批最新架构(犹如 Qwen-VL 等系列),只靠不高的百亿参数,便能在各大中英双语的复杂财报查验与顶级商业卷宗试卷榜单中,做到大杀四方的终极底气和面纱。

9.4 质量评价框架、抽检漏斗与缺陷归因测试矩阵¶

在这个每天动辄用千万级人民币经费砸出来的 OCR 与长程 Re-captioning 庞杂交织预处理车间里,如果你把质量监督环节当做可有可无的放羊式管理,那么哪怕仅仅是 0.5% 的崩塌样本或者幻觉标签倒灌,也足以让耗资几个亿的千卡算力集群在几个月的日夜运转后,最终吐出一个只会胡言乱语、毫无商业价值的“智障模型”。因此,在将这些合成后的重注数据推向主训练流之前,我们必须建立起一道不讲任何情面、如同铁腕一般的大厂工业级数据质检刑场。

9.4.1 机器无情评分的悬丝诊脉法(Heuristic & Model Scaling Validation)¶

对于高达数亿级别的数据,人工是不可能看完哪怕万分之一的。我们首先必须部署全量自动化的大规模启发式与验证模型(Heuristic & Scaled Validator):

- 苛刻的长短文本一致性交叉降维校验(Consistency Penalty Test):

- 算法架构流水线:重注中心通常会产出长达 500 字的啰嗦密集文本(Dense Caption)。前置质检探针(Probe)会先将这 500 个字通过一个轻量级的词性标注器(如 NLTK 或 SpaCy),强制抽提浓缩成 5 个最核心的物理实体大名词(如“键盘、咖啡、桌子、显示器、阳光”)。

-

双盲自裁决标准:随后,让这五个被抽提出来的大名词回归最初的本源:强行使用最底层的原版视觉网络去跑一遍前代的 CLIP Score 相似度余弦散列计算(将抽提名词特征空间与原始图片像素特征点阵列比对)。如果发现这五个核心名词的特征向量内积均值,不仅没有比原始互联网爬取的废纸标签(如“办公室一角”)变得更高,反而出现了异常跌落——系统会立刻触发 P0 级红色警报。这必然说明上游的“重注大模型彻底飘了”,它完全放弃了看图,陷入了不可名状的自言自语。运维中控机将立刻发令定点爆破,销毁该节点当日产生的所有数据包。

-

纯粹粗暴的标点、正则流与大语言防环路污染过滤(Syntax & Glitch Sweeping):

- 即便不看复杂的几何语义模型反馈,光看生成文本的隐层字符排布也能抓住严重的合成质量问题。如果大批经过 OCR 模型(如 PaddleOCRv4)加持后生成的 PDF 富文本数据末尾,频频出现了孤立异常规模的未闭合 HTML 标签诸如

</html>、连串卡死的[ERROR] [NO_RESPONSE]、值得注意的乱码(比如满屏的äääää或 `` 占位符污染)。 - 最为致命的,是大模型长程推理常常陷入的连续超过 20 行完全重复的无逻辑废话(经典的 Repetition Glitch 极速死循环死锁)。一旦系统日志中此类正则异常截断率超过节点水位线的 0.05%,调度节点必须直接物理熔断该推理实例,防止毒数据无底线地注入核心特征水库。

9.4.2 Human-in-the-Loop 人工盲抽与多阶层法医级归因框架¶

即便机器防御雷达扫描过的地方一切安好,最后一道昂贵的专家人工盲抽校验池(Human-in-the-Loop Blind Sampling & Verification)依旧不可逾越。每天,总控中心会随机抽样调取 20,000 张包含重箱嵌套结构的超复杂文档测试用例样本,派发给高度专业的人工审核专家大厅。

这批专家不仅要评判优劣,更要像法医一样,从长达几百页的 Token 列表中为模型开发团队提供详尽的“战损归因报告”。为了彻底阻断“算法各模块的工程师遇到训练发散时只会互相甩锅不承认”(例如视觉工程师怪大语言底座差,大语言工程师怪视觉漏了特征),集团评测组必须依照如下铁律架构,建立了工业界最为著名的事故定性分流排查树:

表9-2:跨模态及高级文档识别 OCR 核心错误归因与修复阵列矩阵

| 灾难级别错误特征在底座视角的物理表现层 | 专家工作台根源鉴定(法医级归因分析剖析) | 核心修复工程开发流水线阻击策略与架构迭代迭代方案 |

|---|---|---|

| 细小数学物理公式或下划线账单全线读错崩溃,小数点移位灾难 | 这是纯粹的外挂 OCR 或 Table 识别引擎提取精度的绝对失败。 | 不能怪语言模型。必须立刻更换架构或者强制重采数百张密集表格,重新微调上游基于 Paddle/Mathpix 的视觉子网络,并且将文档入模的 AnyRes 分辨率强行提高。 |

| 版面结构彻底错乱:大纲标题串区,第一张图表的图例强行乱入了第二栏学术正文 | PDF 版面分析算法(Layout Analysis Boundary)的分类器框定策略发生破损或遭遇极强水印重叠蒙蔽。 | 立即重做布局节点特征树聚合启发式代码;立刻摒弃原本基于弱规则组合的 HTML 抽取,强行改用极其消耗算力的 LayoutLM 或高阶 YOLO 进行全监督回归画框。 |

| 指鹿为马的高深幻觉:比如把左边桌子上的一堆细长黑色笔筒,强行赋予深远寓意解释成“茶杯拉长的水纹倒影” | 视觉编码基座并没有瞎,而是作为大脑的 Re-captioning大模型在合成长文本时,过度文青发散,陷入了常识盲区的多模态联想幻觉发作。 | 必须换用百亿参数量以上、带有极其严格的拒绝惩罚 RLHF (强化学习对齐) 机制的模型进行二次重注;在流程中强制引入前置的三盲互审引擎投票判决机制来剔除修饰词。 |

| 胡言乱语答非所问,前言不搭后语,输入了中英文但输出全成了不带逻辑火星文或全零矩阵 | 此类毁灭性现象通常不是弱智,绝大概率是在最底层的多线程数据序列化、Byte-Pair 打包,或是 Tokenizer 词表隐射转换过程发生极其严重的指针越界、数据越位泄漏。 | 研发主架构师接管阵列。这完全属于上层应用组装 C++/CUDA 的内存泄漏报错。必须完全叫停所有训练脚本进程,返回到数据读取算子层执行深切大修与断点排错调试。 |

9.5 真实工程案例与后传连接点¶

9.5.1 金融行研知识库重生的艰难历程(项目P05)¶

在 2025 年初,集团算法部门接到了一个全公司的年度核心业务:构建某国字号券商级别的“商业全报表智能辅助穿透与质控引擎”(代号 P05)。起初,算法研发小组过度依赖于“大力出奇迹”的狂热信仰,他们将收集来的整整八百万份各行业研报 PDF 以及脱敏财务扫描件直接进行了粗暴分页。随后,他们寄希望于将这些切分后的纯图片输入给拥有 72B 参数的百亿视觉基座模型中,期待模型能够凭空引发奇迹并看懂一切。

结果在耗费了极高昂算力的第一轮闭门盲测中,模型上演了令人惊骇的灾变:它不仅只能笼统地回答“图中有一张表”,更可怕的是,在回答诸如“三线城市重金属业务的分润同比下跌与环比上涨对比”这种极度细节的拷问时,它竟然会直接跨越行段当场捏造一个完全不存在的营收数字;面对一份厚达数百页、充满了页眉水印干扰的招股书扫描件,这台造价上亿算法机器的实际可用性和问答准确率甚至完全比不上使用 PDF 软件 Ctrl+F 搜索框的一名高校在校实习大四全职生。

在被愤怒的金融业务方彻底打回原形后,我们随即切断了整个算力阀门,耗时整整大半个月,硬是将这原本寄予厚望的八百万份财报打回数据车间彻底重造。 这不再是简单地把图片丢进显存里。在新重构的极端的 OCR 装配流水线中,每一页、每一张长图都被多层网络精确、毫不留情地切割。它不仅单独扣出了饼状图与折线图的图像特征板块,更将那些繁长晦涩的密集营收表格全部压碎。随后,数据中心满载调用了重型算力集群和特种的高配 Table OCR,硬生生地在原来那 800 万份图片周边,塞满了高达大几十 GB 的巨量附魔辅助文本:其中密密麻麻地包含了所有的单元格绝对边界位置锚点(BBox Anchor)、结构化嵌套且首尾完美闭合的 HTML 或者 Markdown 转述语义标签树的数据驱动矩阵串联。

真正的事实证明,没有严格的数据工程基础,再强大的算法也难以弥补数据的缺陷。在这如同淬高强度般严丝合缝的重建阵列护持之后,我们才再次批准重启大模型训练。仅仅三个轻量的训练周期(Epoch)过去,这个大基座模型的长复杂图表阅读推理得分(ChartQA、TabMWP)就如同毫无阻力一般原地飙升了超过 45 个绝对百分点,其展现出的恐怖数值洞察力瞬间彻底击穿了所有传统金融投行陈旧分析系统的基准安全红线。

9.5.2 本章工程之眼,开启高维长时序视频大航海纪元¶

从这份 1100 页大纲指南的第一篇开始,我们跟随着数据工程师的脚步,历经了从单模态纯文字清洗与过滤压缩(第一/二篇幅的 NLP 打怪升级)、再踏入平面多模态图文世界的草莽混沌年代(第八章的分辨率切割抗争),直到此刻——我们终于能够稳稳握住极致精密的像素解剖手术刀切开庞杂文档矩阵并完美结构化重构这个复杂的 2D 世界(本章的高阶双流向重标注与文档结构化网络构建工程)。可以说是打下了一座坚不可摧的地基:目前,在那些静态的、寂静无声的二维数字物理世界里的所有脏坑乱洼、毒数据与排版死角污染,无论图像再巨大、底噪杂音再多、工程图纸再难拆,在这套系统性打造的自动化分流筛选的铁网漏洞下,它们都会被提纯为金光璀璨的、高浓度高阶监督指令信号。

但是,物理真实世界从来都不可能仅仅是一幅定格静止的相片或一张不会变动的电子发票! 我们的现实世界,它是有着前后连续逻辑的强烈纵深、有着无尽流淌的时间维度交织,以及混合着多波段空间音频信道(Audio Channels)紧密裹挟而成的浩瀚多维时空长河。 试想一下,在此前静态图片预训练中被我们推崇至极、大放光彩的 AnyRes 取回策略虽然强大,但它面对一秒钟就产生足足 60 幅连贯高分辨率重叠照片、并且随随便便就能持续长达几个小时播放时长的数字时序视频怪兽时,哪怕把你把世界上十座最宏大的万卡 GPU 高速互联网络全部凑在一起,也会在短短几秒内瞬间过载发热,便陷入极度算力崩溃、显存溢出(Out-of-Memory)报错的绝境深海。

这就残酷地引出并在整份多模态 AI 数据工程全景图的最边缘,竖立起了最后一座极其诡异、当前在整个全球学术与工业界依然尸骨累累的、尚未被大规模有效攻克的黑暗堡垒冰峰。下一节,我们将重新审视一切已知的特征工程兵器,全神贯注且极其紧绷神经,全副武装且带上最新的长序列动态压缩算子系统,正式步入跨度极度宽广、特征体量呈指数级庞大爆炸,且图文声音逻辑信道交缠得极度微弱的四维时空大雷区:“第 10 章 视频与音频流多模态数据工程基建”。跟随我们的视角,推开下一扇沉重的数据之门,一起来解开那条让 Sora 乃至一切世界模拟器(World Simulators)诞生出物理规律理解法则的终极数据风暴锁链吧。