第11章 跨模态对齐与融合¶

在完成第八、第九章(图文)和第十章(音视频)的单模态清洗后,我们已将图片水印清除、错误 OCR 纠正、长视频精确抄帧为关键帧切片,付出了大量工程代价。

然而,把土豆洗干净、把牛肉切好,并不等于你做出了土豆烖金錢腹。如果只是把各自清洗完毕的图片流、声音波形和文字 Token 堆叠进大模型的 Context Window 里,模型并不会学会“跨模态推理(Cross-modal Reasoning)”——各模态信号之间的对应关系缺失,会导致训练信号相互干扰,引发严重的幻觉(Hallucination)问题。

本章作为《第三篇:多模态高质量数据工程》的收官章节,聚焦于多模态数据工程的核心难题——如何制作跨模态融合的训练监督样本(Cross-modal Fusion & Alignment Samples),让不同模态的编码向量在同一语义空间中实现有效对齐。

11.1 跨模态对齐要解决的到底是什么问题¶

11.1.1 模态鸿沟与异构空间挑战¶

“对齐(Alignment)”这个词在 AI 届有着宽泛的涵义。在下一卷(第四篇)中,它将代表人类核心价值观的 RLHF 对齐;但在本章的底层数据准备中,这里的“对齐”特指解决数学级灾难的异构空间模态鸿沟(Heterogeneity Gap)。

文本在 Embedding 空间里是一条高度抽象的高维向量,它代表“语义(Semantics)”;而一张图片的像素矩阵如果被 Vision Encoder 编码出来,它代表的往往是“边缘、颜色、纹理集合(Patch Features)”;一段波形文件则映射着高低频振幅空间。 这三大类向量不仅维度尺寸完全不一样,而且它们所映射的数学流形(Manifold)在原始状态下是彻底正交、老死不相往来的。所谓“跨模态对齐工程”,就是指构建出一批苛刻的高质量数据集,去逼迫多条不同的 Encoder 编码器,在面对同一个物理概念(比如:一只正在叫的橘猫)时,输出在同一个数学空间中距离无限接近的联合表征向量。

11.1.2 为什么单独洗图文/音视频还不够¶

在单纯的前置处理中(如 Ch08 中我们做过的那样),我们只负责把画质模糊的图片丢掉,或者把没声音的视频删掉。但如果我们仅仅满足于做这种“卫生学清洗”,就会错失真正的认知飞跃。

独立清洗不能带来对应关系。 想象有一百万张高清猫咪图片,另有一百万句描写猫咪的绝美网文。它们各自的数据质量都是 100 分。如果你不将这具体的某一张图与某一段文字发生刚性连接(Hard Link),模型就不知道“橘黄色猫毛”这个 Token 对应的是图片里哪个像素。这就是“为什么我们需要额外投入恐怖规模的人力和算力,去构筑专门的配对(Pairs)和交错对(Interleaved Data)”。

11.1.3 模型收敛失败的数据级背锅侠¶

当一个千亿规模的视觉端大模型训练 Loss 发生了灾难级抖动发散,或者在推理时面对图片胡言乱语。算法团队往往会第一反应去怪罪学习率没调好,或者怪罪 Attention 架构不行。 但数据工程师必须站出来说真话:绝大多数多模态端到端融合模型的收敛失败,根本源于对齐样本里的“软挂载”和“高伪像”带来的脏信号反噬。 举例而言,当训练数据给出一张图是“巨大的埃菲尔铁塔”,而旁边的文字标注却是“我今天在巴黎开心地吃了个羊角面包”,这就是一条典型的“弱相关甚至互斥”毒药。系统将强行把“吃面包的欢快语义”和“埃菲尔铁塔的视觉张量”扯在一起强做余弦优化合并(Contrastive Loss),久而久之就把模型的常识彻底撕裂。

11.2 工业级三级金字塔:对象级、片段级与文档级对齐策略¶

想要实现完美对齐,必须要有金字塔般严密的层级结构设计规划。在顶级的大厂数据中台里,我们把对齐颗粒度(Granularity)残酷地分为了三个阶层。

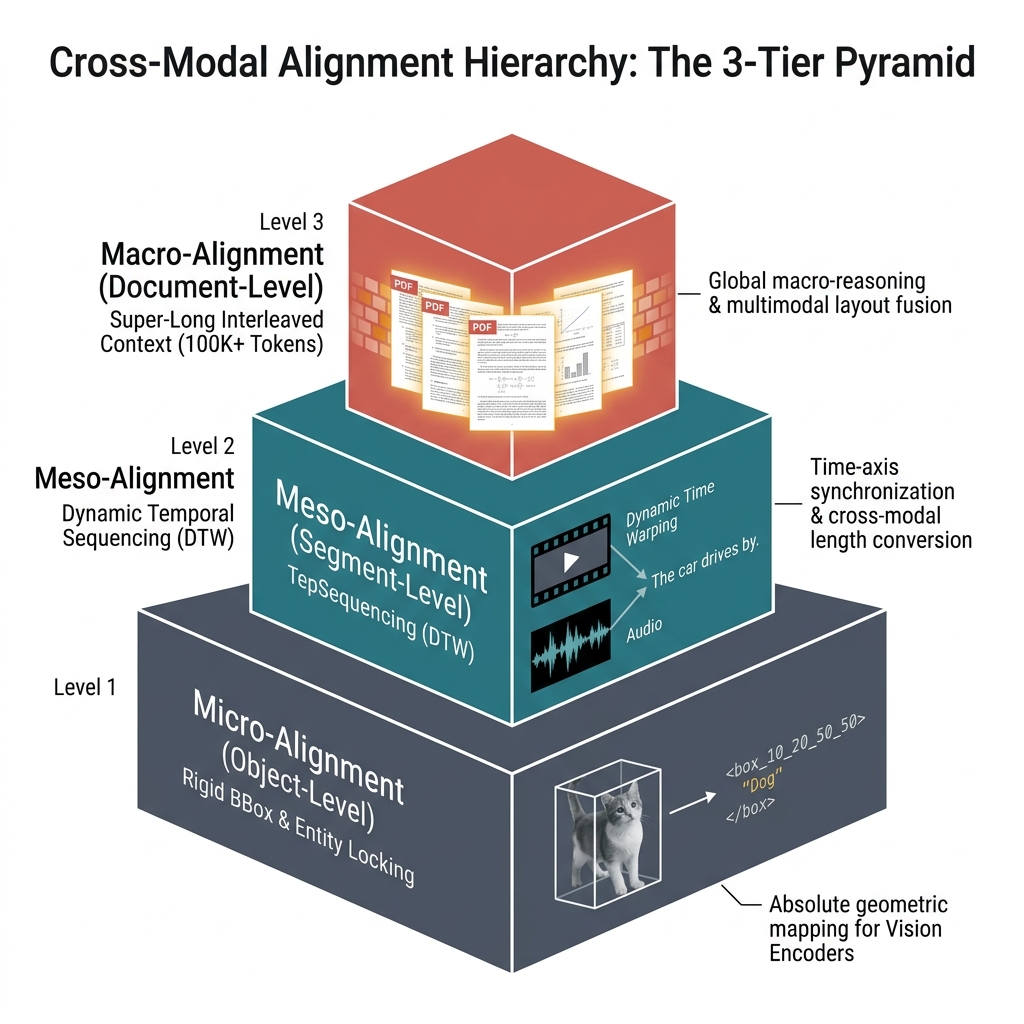

图11-1:跨模态对齐的三级金字塔架构 —— 展现了从微观到宏观的三级对齐体系:底层为基于 BBox 的对象级对齐(Object-Level),中层为基于 DTW 时序同步的片段级对齐(Segment-Level),顶层为超级长上下文交错缝合的文档级对齐(Document-Level),三者逐级支撑大模型的多模态认知底座。

11.2.1 对象级(Object-level / Micro-alignment):框与词的细粒度锚固¶

这是多模态基座在婴儿期必须吃下的第一口奶也是必须要修的最底层的地基。

在此级别不需要大道理。只需要精确的几何坐标映射关联:例如图片中出现的一只猫,就必须被绝对无误的 Bounding Box(2D边框坐标)框出来,比如 [x1:100, y1:200, x2:350, y2:450];然后在对应的文本 JSON 中写道:<box> 猫 </box>。

这是为了在早期的 Projection Layer(投射层)训练中,告诉模型:“你看,不管你看到了多少眼花缭乱的光学信号,最后这个框里面的这堆红绿蓝颜色堆积,跟文本词汇表里 ID 为 45321 的 Cat,在数学上是同等存在。”

这一层的对齐如果出大面积失真(坐标偏移导致框了猫却打上了狗的标签),将直接严重损伤大模的 Vision Encoder 本地响应映射函数。

11.2.2 片段级(Segment-level / Meso-alignment):连续时间序列映射¶

这是我们在 Ch10 里重点攻坚的层级。这个级别引入了长度的跨模态不等量换算。一段 3.5 秒钟的视频,包含 105 个连续运动的视网膜成像帧序列,同时伴随 3.5 秒的声带高能气流波段;而转换到的对应文本,可能仅仅是为了极其简短的一句 “The white car drives down the street.”。

105 个视觉画面如何对应 7 个英文单词?数据工程师往往运用耗费算力的 DTW(Dynamic Time Warping,动态时间规整)或复杂的基于注意力图的软关联系统去切割它。需要注意的是,标准 DTW 的时间与空间复杂度均为 O(N×M)——对于长达 4500 帧 × 6200 词的片段,内存需求可超过 90GB,因此生产环境中通常配合 FastDTW 近似算法(线性复杂度)并将片段限制在 60 秒以内(详见 §11.6.4 的 OOM 案例)。在这一层对齐中,允许少量的前后滞后浮动时间容错(通常设置 Sakoe-Chiba 带宽为 ±0.3–1.0 秒),但绝不容忍"因果倒置"式的前后时序序列混乱。

11.2.3 文档级(Document-level / Macro-alignment):超长交错的多体宇宙宏观对立融合¶

当模型已经能认识短句子里的所有图文和动作小视频对应后。就要进入真正的终极大考阶段(这也是目前通往 GPT-4o 级别乃至更高远深邃大一统多模态长上下文处理的最前沿主战场)。 这里的对象不再是切碎的块,而是动辄几十上百页带有精美图解的说明书、论文或是极长极长带连续回放的电影胶片集(例如一个巨大的 PDF 文件渲染出来的几十张连续图片序列)。 在此时数据制作的最精髓之处,并非如何抠细节坐标。而是如何在高达 100K 乃至 1M 的 Token 训练窗口中,将这些图、文、声信号极具规律地、错落有致地排布(Interleaved Ordering),让模型不仅进行微观的视觉提取,甚至需要在成百上千页文本跨度范围内,根据前面某一页给出过的图标图例去长线推理后面第 50 页文本内容的最终隐喻象征。

表11-1:三层异构对齐策略与其必须应对的最前沿大模型适用特种任务一览表

| 颗粒度封层 | 对齐的手段与重度特征表达 | 数据依赖的构建开销 / 极度成本代价 | 为大语言模型(LLM)开启解锁的核心适用顶级特工任务 |

|---|---|---|---|

| 底层防线:对象级 (Object-level) | 高昂的人工密集标注 BBox;或者通过先进大模型教师强制生成精细抠图区域与绝对对应单词坐标点。 | (高昂,重度依赖人工众包或者大量预处理小核芯推断算力的烧录) | Region Grounding(区域级溯源)、极小区域病理图像诊断寻找病灶、无人机视觉锁定打击。 |

| 中层壁垒:片段级 (Segment-level) | 时间轴对齐算法;通过双塔打分(如 CLIP Score 或 CLAP Score)进行密集矩阵过滤。 | (算力烧损,大量消耗高速内存显存用于高频短段解压重排计算) | Action Recognition(动作解析识别)、Video Captioning(短剧解读与摘要生成)、Voice Translation。 |

| 顶层天宫:文档级 (Document-level) | 高级排版提取引擎(如类似 Nougat 的解构网络);采用含有极其多图文互相引用的超级超长交错排序流。 | (重在长文本调度编排,对上下文缓存 Context Cache 和 KV 大幅压榨挑战极大) | 超大长流程 Multi-modal QA(多页财报或研报的审读回答)、长时多线程事件因果超级推理(长连载动漫逻辑自洽分析)。 |

11.3 表示、融合与难负样本设计工厂¶

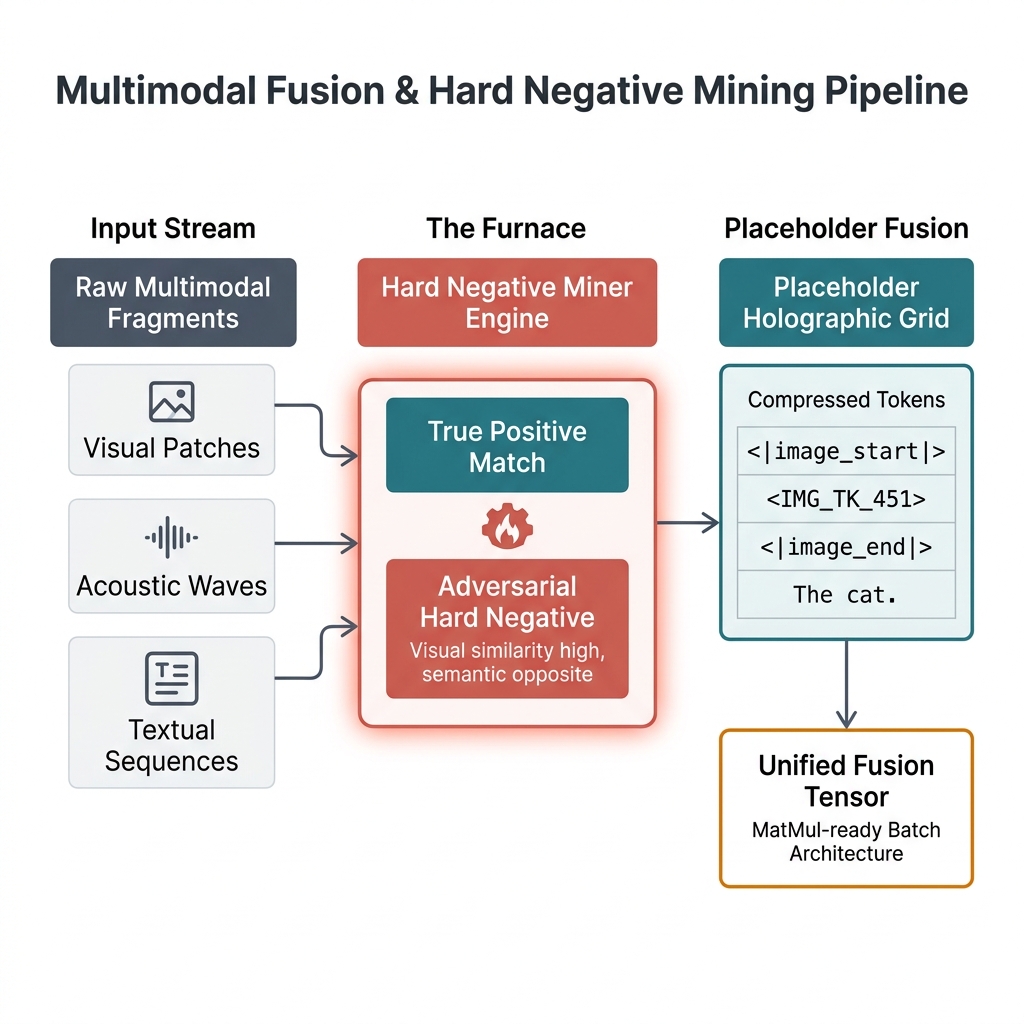

在明白了对齐的层次之后,接下来的核心战役是如何把它们真正打包成一个能够顺滑流过大型矩阵乘加网络(MatMul)的数据结构体。这需要高度严密的表示融合工程方案出场。

11.3.1 统一超维张量表示与精细的占位符工程(Placeholder Engineering)¶

所有的大语言模型骨架天生只能吞吐离散化的 Token(如 1 代表 I,2 代表 love)。那图片和声波怎么变成离散 Token?这就是 Placeholder Engineering 和 Quantization 的力量源泉。当通过诸如 VQ-VAE 或者前沿的高阶离散 Auto-Encoder 抽取后,连续的色彩张量会被强行压成高度收敛的离散编号(如图像块转为 <IMG_TK_451>)。在合成训练流时,原本的 JSON 样本数据流中并不会真正在文本字符串中塞满庞大的矩阵浮点数序列。而是采用简洁优雅的占位符模式。比如:<|image_start|> <IMG_TK_451> <IMG_TK_882> <|image_end|> 这是一只可爱的猫。

图11-2:多模态融合与负样本挖掘管线 —— 左侧离散的音视图多模态输入,经中端的对比挖掘引擎(Hard Negative Miner)筛选出强对抗样本后,在右侧通过占位符技术(Placeholder Grid)映射为离散 Token,最终打包成统一维度的融合张量块供下游模型预训练。

11.3.2 “难负样本(Hard Negatives)”深度挖掘与极限生存生成策略¶

这可能是在多模态监督对齐(Supervised Contrastive Alignment)里最最烧脑的核心数据构建环节。如果你的模型总是能轻易区分出“这是猫,那是狗”,那么它的能力提升就会遭遇强烈的边际递减效应瓶颈。必须人为制造地狱难度的干扰选项,逼迫模型去寻找更细微、更本质的差别。 难负样本的五大核心挖掘手段:

-

极小微差替换法(Subtle Replacement Mining):将正样本图片"一只蓝色的杯子放在木桌上"原样保留,然后从海量句库中找出只改变了一个关键修饰词的文本——"一只黑色的杯子放在木桌上"——强行将其配作"负类样本"输入模型。这就逼迫 Vision Encoder 死死关注画面里的颜色细节,而不是只做大语义匹配。实践中可结合词性标注(POS Tagging)自动识别"高区分度词槽",再从同义词库或 LLM 生成变体句批量产出难负样本对。

-

跨模态属性错位法(Cross-modal Attribute Swap):在图片级进行局部语义篡改。通过 Inpainting 模型(如 Stable Diffusion inpaint)将图片中的"红色苹果"改写为"绿色苹果",同时保留原始正向文本;或者反向操作——保留原图,只把文本中的空间关系词"左边"改成"右边"。此类错位强迫 Cross-attention 层精确感知视觉区域与文字描述之间的细粒度绑定关系,而不是仅靠场景类别做大粒度匹配。

-

批内在线最难负样本挖掘法(In-Batch Online Hard Negative Mining, OHNM):在每个训练批次内部动态计算所有样本两两之间的跨模态相似度矩阵,挑选出相似度最高但语义确实不匹配的样本对作为当批负样本。OHNM 无需额外构建静态数据库,而是让模型当前能力边界实时决定"最有训练价值的困难样本"——随着模型能力增强,难负样本难度自动适应提升,形成自然的课程学习(Curriculum Learning)效果。

-

时序扰动法(Temporal Perturbation,适用于视频-文本对):将视频字幕与相邻时间窗口(如前后 3 秒)内的另一段画面错位配对,制造"时序错位负样本"。例如正样本是「

<00:03-00:06>运动员起跑」配「起跑」文本,负样本则是该文本错配到「<00:10-00:13>运动员冲线」画面。此类负样本迫使模型学会严格的时间因果关联,而不是仅匹配"运动员"等粗粒度语义标签。 -

大模型合成难负样本法(LLM-Generated Synthetic Hard Negatives):调用指令微调后的 LLM,输入一段正向描述文本,要求其生成"语义极相近但含关键事实错误"的对抗文本。例如,原文"一个戴眼镜的中年女性坐在红色椅子上",LLM 输出"一个不戴眼镜的中年女性坐在蓝色椅子上"。相比词典替换,LLM 生成的负样本在语法流畅性和语义覆盖多样性上远超传统方法,是当前业界主流的规模化难负样本生产方式,成本低廉、可扩展性极强。

表11-2:五种难负样本挖掘策略对比

| 挖掘策略 | 生成方式 | 适用粒度 | 主要优势 | 主要风险 |

|---|---|---|---|---|

| 极小微差替换 | 词典/属性词库替换 | 词/属性级 | 精准控制替换位置 | 需维护细粒度词典 |

| 跨模态属性错位 | Inpainting / 文本改写 | 区域/关系级 | 图文双向制造困难 | Inpainting 质量不稳定 |

| 批内在线挖掘 | 动态相似度矩阵 | 样本对级 | 自适应难度,无需预构建 | 批内假负例风险较高 |

| 时序扰动 | 时间轴错位配对 | 片段级(视频) | 强化时序因果学习 | 需精准的时间戳标注 |

| LLM 合成生成 | 大模型指令生成 | 多粒度 | 规模大、多样性高 | 存在假负例,需质检过滤 |

11.4 工业评价绝对框架与严格的质量反向裁决闭环漏斗¶

如果辛辛苦苦耗资千万编排好的庞大融合数据对齐批次,没有任何指标就下放,那就无异于把黄金当废纸往熔炉里倒。

表11-3:核心评价指标防线与严重误差来源对照表

| 高阶自动化严密评估指标参数核算口径 | 其在多模体系中代表的真正工程业务物理含义 | 如果该数值遭遇血崩意味着到底是在哪里混入了何等级别的恶性致死毒药污染 | 工业防御救赎措施 |

|---|---|---|---|

| 模态一致性反向重召回率(Cross-Modal R@1 / R@5) | 输入这一段包含 50 个复杂对象的图片,能够在另一端用文本反向搜索时前 5 次精准捞起对应描述句子的超强召回概率。 | 如果此项偏低,说明你的 Object Level 对齐坐标点或者字典建立映射关系完全张冠李戴,大范围串片! | 即刻熔断停止预留。重新回归调用教师模型去洗涤全量 BBox。 |

| 时间轴交叉顺延性对齐分数(Temporal Alignment Continuity Score) | 音轨转录词序列在视频动态切片的连续发生时间先后顺序排列情况,是否和真实物理世界事件链发生序列匹配一致。 | 时空因果律逆转!你极有可能使用了极为低级的打散重排序抽帧算法或者没带全局时间 ID! | 强制加入绝对时间戳(Global Timestamps Constraint)。 |

| 文本蕴含度冲突容灾指数(Textual Entailment Conflict Rate) | 同一张图,用了十句不同的人工外包描述;这十句话彼此之间会不会存在完全相悖的逻辑冲突。 | 重度外包数据注水或集体眼花事故。人工标注质检网全线形同虚设! | 发起 HITL(Human-in-the-Loop)十倍惩罚重新抽检。 |

11.5 终章:在极度黑暗的真实千卡集群试炼中的失败模式与绝境补救¶

作为本篇的收尾,以下两个真实失败案例揭示了跨模态对齐工程中最典型的错误模式,对数据工程师具有重要的警示意义。

11.5.1 案例一:医疗多模态问答中的灾难级部位张冠李戴(对象错位)¶

在一家顶尖健康 AI 机构开展的基于长篇胸透 X 光片(超高像素密度)与对应主治医师极长医嘱文本序列的大对齐项目中。一切初期跑分极为完美。 然而上线后遭到了严重的信任危机:模型居然开始指着患者左肺上的正常阴影节点说是晚期癌变区域!究其根源:由于在这批对齐原始扫描样本的数据录入生成时,工程师疏忽漏掉了对于“X光胶片物理翻转和镜像(Mirroring Data-Augmentation)”的绝对禁止红线设定!这引发了底层空间中左肺张量和右肺结节张量的左右颠倒投射污染。此一战让该机构销毁了足足历时六个月耗费大量算力打磨的核验集。

11.5.2 案例二:安防长篇视频检索中的“时空穿梭”幻觉记忆(片段错位)¶

某前沿安防平台的大模型训练遭遇令人困惑的“穿梭幻听”。当监控记录到一个歹徒翻墙逃逸的画面时,模型并没有发出翻墙的声音推理,而是非常诡异地生成并在旁边输出了两小时之后审讯室里的嘈杂争吵人声。 致命病因排查发现,在 11.2 节的片段级对齐管道环节,那名外包的分布式处理大数据实习生工程师使用了存在缺陷的弱一致性数据库存储方案(NoSQL Eventual Consistency),导致了超过 12,000 个监控录像片段的长音频音轨因为极小的读写延迟而发生了一整格指针的高速位移偏移(Offset By One Bug)!就这微弱的一个偏移导致了所有的事后音频全部嫁接到了提前一幕的视频上,造就了严重的音画错位倒挂!

11.5.3 第 3 篇完结寄语及前瞻:迈入对齐人类核心与价值观的核心对齐领域¶

回首这一路的漫长旅程。我们从最简单的图片清洗除水印起步,历经严重的海量视频时空打散对抗重组,最终在刚才用宏大的三层多模态金字塔对齐策略,成功结束了这场规模浩瀚异常、死伤无数的数字异构数据底座远征战役。至此,全套的数据工厂流水线已经被我们彻底组装完毕。所有流入那个极点深渊大模型嘴边的数据,均是这颗星球上经过最优结构化淬炼、最极尽对齐排版以及没有任何模态隔膜的顶尖智慧原料包。

然而,感知能力的建立只是第一步。预训练完成的模型仍需要明确的指令引导和价値观对齐,才能真正服务于人类的实际需求。这正是《第四篇:对齐与指令数据(Alignment and Instruction Data)》将重点探讨的内容——从 Ch12 的 SFT 数据设计,到 RLAIF、PPO 与人类反馈系统的全链路工程实践。

11.6 附录:跨模态对齐分布式训练高频崩溃日志与排雷手册¶

以下精选 5 类在万卡跨模态对齐预训练中真实发生的代表性崩溃场景,覆盖对齐 Loss 发散、BBox 坐标错位、负样本污染、DTW 内存溢出和多模 Token 混合格式错误五大核心链路。

11.6.1 Contrastive Loss 瞬间发散至 NaN [ERR_CROSS_MDL_FUSION_7X001]¶

[故障现象]:在 42 个 Epoch 稳定训练后,导入最后一批含大量低质量视频语料的融合批次时,Contrastive Loss 在数秒内几何级暴涨,整个训练节点以 NaN 宕机。

[堆栈快照]:

[WARNING] node-001.storage-backend.local:

Infinity detected in temporal grounding cross-attention matrix!

Attention weights collapsing due to zero-division in normalization.

Traceback Exception raised in /transformers_mod/alignment/fusion_encoder.py line 2001.

Loss scaled to NaN. Global step 14510 aborted.

Cross-Modal Feature Match Score dropped from 0.89 to 0.00000000003.

[根因与修复]:

- 根因:极少量含啸叫噪声或纯黑屏的异常样本进入批次,触发交叉注意力层权重的零除法极化;伪负样本(Noisy Negatives)同时干扰对比损失。

- 修复:①在融合节点前加高通余弦裁切滤波器,强制对特征向量做 Norm Clipping(L2 norm 上限为 10);②从难负样本池中撤出所有损坏样本(CLIP-Score < 0.1 或音频 SNR < 5dB);③启用梯度裁剪 max_norm=1.0 防止极端梯度传播。

11.6.2 BBox 坐标系翻转导致对象级对齐大规模失效 [ERR_CROSS_MDL_OBJ_FLIP_002]¶

[故障现象]:对象级(Object-level)对齐准确率指标 R@1 在某一数据批次导入后从 0.82 骤降至 0.31,推理时出现大规模左右空间方向错误("左"说成"右","左肺病灶"标注到右肺)。

[堆栈快照]:

[ERROR] grounding_eval_worker_05:

Region match failure: predicted bbox [x1:680, y1:200, x2:920, y2:450],

ground truth bbox [x1:80, y1:200, x2:320, y2:450].

IoU score: 0.00. Entire partition eval batch rejected.

Suspected data augmentation mirror flip applied AFTER bbox annotation.

[根因与修复]:

- 根因:数据增强管线中随机水平翻转(HorizontalFlip)在图像翻转后未同步更新 BBox 的 x 坐标(应将 x1 替换为 W - x2,x2 替换为 W - x1);医疗影像 X 光胶片还额外存在物理扫描仪镜像输出问题。

- 修复:①所有涉及几何变换的数据增强操作强制绑定 BBox 同步变换(使用 Albumentations 框架的 BboxParams);②对医疗影像增加物理方向元数据字段校验(metadata.orientation);③在流入训练前加 BBox-Text 一致性检测(检查 BBox 内区域的 CLIP 向量与标注文本余弦距离)。

11.6.3 难负样本挖掘误杀真正正样本导致对比损失崩溃 [ERR_CROSS_MDL_HARD_NEG_003]¶

[故障现象]:在引入 Hard Negative Mining 后,Recall@5 不升反降,训练损失的方差异常增大,模型对近义词和语义相近句子的区分能力完全丧失。

[堆栈快照]:

[WARN] hard_negative_miner_worker_2:

False negative rate in batch 3421: 38.7% (threshold: < 5%).

Positive pairs incorrectly tagged as hard negatives: 8,240 / 21,300.

CLIP cross-modal similarity threshold set too aggressively: 0.92 → too many true positives excluded.

Contrastive loss variance: 4.82 (expected < 0.8). Training instability detected.

[根因与修复]: - 根因:Hard Negative 挖掘的相似度阈值(0.92)过高,大量真正的正样本对被错误分类为难负样本,产生"假负例污染(False Negative Contamination)"。 - 修复:①将阈值从 0.92 降至 0.75,并引入两阶段判断:先用 CLIP 做粗过滤,再用人工规则(如图文是否有词汇级别共现)做精筛;②限制每批次 Hard Negative 占比不超过正样本数的 2 倍;③部署独立的 False Negative 检测器,定期抽样人工审核。

11.6.4 DTW 时间规整内存溢出导致片段级对齐管线停摆 [ERR_CROSS_MDL_DTW_OOM_004]¶

[故障现象]:处理超过 90 秒的长视频片段时,DTW 对齐计算进程因内存耗尽被 OOM Killer 杀死,整个对齐管线卡死,积压数万条待处理任务。

[堆栈快照]:

[FATAL] dtw_alignment_worker_08: Killed (signal 9).

DTW matrix allocation failed: requested 94.3 GB for sequence lengths (4500, 6200).

MemoryError: Cannot allocate ndarray of shape (4500, 6200) dtype float32.

Queue depth at crash: 14,382 pending segments. Estimated loss: 890h of aligned audio-visual data.

[根因与修复]: - 根因:标准 DTW 的时间和空间复杂度均为 O(N×M),对 4500 帧 × 6200 词的长片段分配矩阵高达 94GB;未对输入序列长度做限制。 - 修复:①强制将超过 60 秒的片段切割为 30 秒子段后再做 DTW;②使用 FastDTW(线性复杂度近似算法)替代标准 DTW;③为每个 DTW worker 设置最大内存配额(32GB),超限后触发降采样而非直接 OOM。

11.6.5 多模 Token 混合格式错误导致 Placeholder 解析失败 [ERR_CROSS_MDL_TOKEN_FMT_005]¶

[故障现象]:训练进入多模 Token 混合批次后,模型 Embedding 层抛出索引越界,部分样本的图像占位符被误解析为文本 Token,导致 batch 级训练中断。

[堆栈快照]:

[ERROR] multimodal_dataloader_worker_3:

Token index 152104 out of vocabulary range (vocab_size=128256).

<IMG_TK_451> placeholder decoded as raw text token, bypassing vision encoder.

JSONL sample malformed: missing <|image_start|> sentinel in sample_id: mm_00483921.

Affected batch: 256 samples. Training step 28,441 aborted.

[根因与修复]:

- 根因:JSONL 打包脚本在写入多模样本时,对包含特殊字符(<、>、|)的 Placeholder 进行了 HTML 转义(< 等),导致 Tokenizer 无法识别哨兵 Token;部分样本还遗漏了 <|image_start|> 前缀。

- 修复:①在 JSONL 序列化时对 Placeholder 字段使用 ensure_ascii=False 且跳过 HTML 转义;②在 DataLoader 的 __getitem__ 中加断言,确保每条多模样本包含成对的 <|image_start|>...<|image_end|> 哨兵;③建立格式校验器(Linter),在入库前 100% 扫描所有 JSONL 文件的 Placeholder 完整性。

11.6.6 高频错误速查表¶

| 错误代号 | 错误类型 | 核心触发条件 | 一句话修复策略 |

|---|---|---|---|

| ERR_CROSS_MDL_FUSION_7XXXX | Contrastive Loss → NaN | 噪声样本触发注意力零除法 | Feature Norm Clipping + 梯度裁剪 |

| ERR_CROSS_MDL_OBJ_FLIP | BBox 坐标翻转 | 几何增强后未同步更新 BBox | Albumentations BboxParams 绑定变换 |

| ERR_CROSS_MDL_HARD_NEG | 假负例污染 | Hard Negative 阈值过激 | 双阶段筛选 + 占比上限控制 |

| ERR_CROSS_MDL_DTW_OOM | DTW OOM 崩溃 | 长片段 O(N×M) 矩阵爆内存 | 切片 + FastDTW 近似算法 |

| ERR_CROSS_MDL_TOKEN_FMT | Placeholder 解析失败 | Placeholder 被 HTML 转义 | ensure_ascii=False + 入库 Linter |

| ERR_CROSS_MDL_TEMPORAL | 时序因果倒置 | 数据库最终一致性写入偏移 | 强一致性存储 + 全局时间戳约束 |

| ERR_CROSS_MDL_MIRROR | 医疗影像镜像污染 | 扫描仪物理输出镜像未校正 | orientation 元数据校验 + 方向固定 |