第17章 合成数据质量控制与模型坍缩¶

当团队开始大规模使用合成数据时,最初感受到的往往是效率红利:数据生产速度更快,长尾场景覆盖更广,标注成本明显下降,样本结构也更容易统一。这些优势使得合成数据迅速成为现代模型工程中的核心基础设施之一。但也正因为它看起来高效、可控、可扩展,团队很容易在没有足够治理机制的情况下,把更多训练责任交给合成数据体系,最终让原本用于加速模型进化的工具,反过来侵蚀模型能力本身。

本章讨论的重点,不是笼统地否定合成数据,而是解释一个更具工程现实感的问题:为什么合成数据在带来收益的同时,也会逐步制造风格单一、知识漂移、样本自相似增长、训练不稳定和模型坍缩等风险。这里所说的“模型坍缩”,并不只指理论上极端意义的分布退化,也包括工程中更常见的那类缓慢但持续的能力衰退:模型越来越像自己生成的数据,越来越少像真实世界,最终在离线指标看似仍可接受的情况下,逐步失去对复杂输入、陌生风格和真实业务波动的适应能力。

对于负责合成数据生成、质量控制、训练配比和上线治理的团队而言,真正重要的问题不是“要不要用合成数据”,而是“如何让合成数据始终作为增益来源,而不是风险放大器”。因此,本章将从风险形成机制、检测指标、对照实验、风险闸门、回退策略和典型案例六个维度,系统讨论合成数据治理的工程方法。

17.1 为什么合成数据会反噬模型能力¶

合成数据之所以危险,不是因为它天然低质量,而是因为它具有一种很强的“自增强”属性:一旦生成逻辑、评价逻辑和训练逻辑耦合在一起,系统就会越来越擅长生成“自己喜欢的数据”,却不一定越来越擅长应对真实世界的数据。换句话说,合成数据反噬模型能力,常常不是因为某一批样本明显错误,而是因为整个数据闭环慢慢偏离了真实任务分布。

对于很多团队来说,合成数据最初出现时,往往扮演的是“效率工具”的角色。它帮助团队快速扩充样本、补齐长尾、控制格式、降低标注成本,也让训练数据生产从高度依赖人工,转向更具规模化能力的自动化流水线。在这一阶段,合成数据几乎总是以正面形象出现:它更快、更便宜、更统一,甚至在短期指标上也更容易带来改善。因此,团队很容易产生一种直觉,认为只要合成数据生成质量足够高,扩大使用规模就是一条自然正确的道路。

但真正的问题正在于,合成数据不是单纯的“外部补充”,它往往会逐步成为系统内部最强的分布塑形力量。只要生成器、裁判器、模板系统和训练器之间形成紧密闭环,样本空间就会越来越受系统内部偏好牵引,而不再主要受真实世界牵引。于是,模型表面上是在不断吸收“新数据”,实际上却是在反复吸收“同一套生成逻辑的不同表面变体”。从工程上看,这种过程最危险的地方,不在于它会立刻制造大量显性错误,而在于它会缓慢重写模型的适应边界,让模型越来越擅长处理被系统定义过的问题,越来越不擅长处理真实世界中尚未被模板化、尚未被规整化、尚未被系统消化的问题。

模型自举的收益与风险为何同时存在¶

模型自举最吸引人的地方,在于它能让系统用已有能力生产更多训练资源。一个较强的教师模型可以生成样本、补充标注、覆盖长尾、模拟难例,甚至参与质量评审。这样一来,团队似乎不再被真实数据采集速度限制,而是可以通过模型自身不断扩充训练材料。这就是自举的收益来源:它让数据生产从人工主导转向模型主导,大幅提高吞吐效率。

对很多团队来说,自举真正有诱惑力的,不只是“能多做一些数据”,而是它改变了数据生产的节奏。过去一条样本从需求提出、任务拆解、人工撰写、审核验收到最终入库,链路很长,产能也很容易卡在人工环节上。自举一旦跑起来,整个系统就像突然多了一台能够持续供料的机器。模板可以快速扩展,长尾任务可以先用教师生成一个初版,原本因为成本太高而迟迟补不上的边界场景,也可以先通过模型模拟出来。对项目处在快速爬坡期的团队来说,这种产能释放几乎是立竿见影的。

更重要的是,自举不只是“多”,往往还伴随着一种表面上的“整齐”。模型生成的数据在格式上通常更统一,输出风格更规整,字段更容易对齐,很多原本在人工数据里常见的噪声和不一致会暂时减少。对于训练系统而言,这样的数据非常“好喂”,它能让模型更快看到稳定的监督信号,也更容易在离线指标上反映出改进。正因为如此,很多团队在第一次尝到自举的甜头之后,很容易对它形成一种近乎本能的信任:既然它又快、又整齐、效果看上去又不错,那自然应该继续加大比例。

但风险也恰恰由此产生。因为自举意味着模型既是生产者,又是被训练对象的能力来源之一。一旦生成端存在风格偏好、知识缺口或错误模式,这些问题就会被系统性复制进训练集,再在下一轮训练后以更稳定的方式反映到新模型中。于是,系统会越来越熟悉“自己生成过的数据”,却越来越不熟悉真实用户的表达、真实环境的噪声、真实任务的混乱边界。收益与风险之所以同时存在,本质上是因为自举既提高了数据生产效率,也提高了偏差复制效率。

这里最值得警惕的,不是某一条样本出错,而是错误开始具有“成批出现、反复出现、越来越像正确答案”的特征。教师模型如果习惯把本来应该保留条件的结论说得过满,这种语气可能先出现在少量生成样本里;可一旦这些样本被大规模纳入训练集,下一轮学生模型就会把这种表达学得更自然、更稳定。等它又反过来参与下一轮生成时,这种偏差就不再只是教师的一点习惯,而会慢慢变成系统的默认写法。问题最麻烦的地方就在这里:偏差不是突然爆发的,而是随着每一轮闭环被一点点固化的。

更值得注意的是,自举在项目早期通常表现为明显正收益。因为当真实数据稀缺、标注成本较高时,合成数据几乎总能快速补齐覆盖率和格式一致性。然而随着合成比例上升,系统的增益会从“补充监督”逐步变成“替代现实”,这时风险不再是偶发性的,而会变成结构性的。许多团队正是在这个转折点上误判了局势:他们看到了前期的收益,却忽视了后期闭环变窄之后的退化机制。

这个转折并不总是很显眼。它不会用一种“从今天开始突然失效”的方式出现,更常见的情况是:离线指标还不错,样本生产效率越来越高,系统内部看起来也很顺,可上线之后却慢慢出现一种说不清的僵硬感。模型更会按照模板回答了,却对真实用户那些模糊、跳跃、情绪化、前后不一致的输入反应变差;它更会写一类“合格答案”了,却在复杂边界场景里越来越少见到真正开放的判断。这时候如果团队还把每一次离线提升都理解成自举仍然健康,就很容易继续加码,直到整个训练分布越来越像系统自己,而不像真实世界。

所以,自举的收益和风险从来不是先后替换关系,而是从第一天起就同时存在。只是早期收益更显眼,风险更隐蔽;到了后期,风险逐渐积累成结构问题,收益却未必还能像前期那样持续放大。团队真正需要做的,不是简单回答“自举好不好”,而是时刻盯住:它在什么时候还是补充现实,什么时候已经开始替代现实;它在什么时候是在放大有效监督,什么时候又在放大内部偏好。只有把这条界线看清,自举才不会从加速器慢慢变成偏差放大器。

自举为什么在早期看上去总是有效¶

从经验上看,模型自举几乎总能在项目前期带来正向结果,这一点并不神秘。其原因首先在于,许多训练系统在初始阶段最缺的并不是最难、最真实、最复杂的数据,而是足够多、足够整齐、足够可训练的监督信号。合成数据在这个阶段恰好能够快速填补样本空缺,让训练过程更容易进入“有反馈、可收敛、可优化”的状态。对于原本数据极度稀缺、长尾案例不足、格式严重不一致的任务来说,合成样本带来的收益甚至会显得非常显著。

很多项目刚启动时,数据面临的不是“高深问题不会”,而是“连基本可学的样本都不够”。任务定义还在变化,人工规范还没完全统一,真实数据量也小,质量波动还大。在这种情况下,只要能有一批相对规整、任务边界清楚、字段对齐的样本进来,模型往往就会立刻表现出明显进步。自举在这里恰好击中了最痛的点:它不一定带来了最真实的数据,但它带来了训练系统最容易吸收的一类数据。于是早期效果好,几乎是可以预期的。

其次,前期任务目标往往相对粗糙。团队更关注“模型能不能大致做对”,而不是“模型是否真正保留了对真实世界的开放适应性”。在这种目标函数下,合成数据天生占优,因为它容易在形式上提供清晰监督,也容易通过模板和规则塑造出“看起来很对”的答案。因此,早期收益并不能证明合成数据已经被安全治理,它往往只能说明:在当前任务阶段,模型还处在“需要更多显式训练信号”的时期。

换句话说,项目早期很多指标之所以能被快速拉起来,并不一定是因为模型已经学到了真实世界的复杂性,而是因为它终于从“几乎没有稳定监督”进入了“开始有比较像样的监督”。在这种阶段,合成数据的优势会被放大得很明显。它像是在一块本来很空的地上先铺了一层规整的路面,哪怕这条路还不完全通向真实世界,也足以让系统先跑起来。团队此时看到的,是模型确实在变好,这个判断本身没错;但如果进一步把它理解成“只要继续加合成数据,系统就会一直按同样速度变好”,那就开始有问题了。

还有一个原因是,前期很多评估本身也更容易偏向合成数据擅长的部分。因为项目刚起步时,评测集往往也还比较“干净”,任务类型有限,输入表达不够杂,异常情况和复杂边界还没有被系统性补进来。这样一来,模型在这种评测上取得进步,会进一步强化团队对自举的信心。可这里有一个很容易被忽略的事实:如果训练数据和评测数据都在向同一种“规整化表达”靠拢,那么正向结果当然更容易出现,但这并不自动意味着系统和真实环境之间的距离变小了。

问题在于,很多团队会把这一阶段的正向表现误读为一种普适规律。他们看到模型因为合成样本而进步,便进一步提高合成比例、弱化真实数据投入、缩小人工验证范围,最后让原本作为加速器的机制,逐步变成了支配训练分布的主要力量。也就是说,自举早期的成功,很容易成为后期系统过度自信的来源。

这种误判的危险,不在于团队做了自举,而在于他们开始把前期收益当成了一条可以无限外推的曲线。前期自举有效,往往只是因为系统刚好处在一个“缺清晰监督”的阶段;可一旦系统进入更细的优化区间,问题就会变成“如何面对真实噪声”“如何覆盖复杂冲突”“如何守住难以模板化的边界”。这些恰恰是自举最容易做得像、却最不容易做得真的地方。要是还沿用前期的思路,继续主要靠模型给模型喂数据,表面上的提升可能还会持续一段时间,真正的适应性却可能已经开始下降。

所以,说自举在早期几乎总是有效,并不是在夸它“天然安全”,而是在提醒团队:前期收益本来就容易出现,因此更要克制地理解它。它说明这个机制在当前阶段帮系统补上了缺口,但并不自动说明它已经适合长期主导训练分布。越是在前期尝到甜头的时候,越应该尽早建立真实数据回流、人工抽检和边界场景校准这些机制。因为一旦团队只盯着眼前的提升,很容易把阶段性正收益误看成长期最优策略。

自举系统为什么会逐步变成封闭系统¶

自举的根本风险,不在于“模型自己给自己出题”这件事本身,而在于这个过程极易变成一个越来越封闭的系统。教师模型根据已有偏好生成样本,裁判模型根据既定标准筛掉不符合偏好的候选,模板系统进一步强化表达和结构上的一致性,而学生模型又在这套数据上继续学习。下一轮生成时,新的模型又会以更高的一致性复现这些特征。如此循环,系统中的“内部共识”会越来越强,而与真实世界之间的距离则可能越来越大。

封闭并不意味着系统停止变化,恰恰相反,它可能一直在高速变化,只不过这些变化越来越发生在内部标准之下。模型学会了什么样的表达容易被保留,什么样的结构最容易通过裁判,什么样的答案最符合模板,于是下一轮生成自然更倾向于这些形式。久而久之,系统不再是围绕现实世界的多样性来塑形,而是围绕自身已经形成的一套偏好来打磨自己。它还在学习,但学习对象越来越多地变成了“自己认可过的东西”。

这种封闭性有一个非常典型的表现:模型越来越像一个在内部考试中成绩优异的学生。它熟悉题型、熟悉表达、熟悉判分标准,也熟悉什么样的答案最容易通过裁判。但它对现实中的非标准输入、真实用户的噪声表达、复杂上下文中的不完整信息,却未必同样熟悉。系统并没有停止学习,它只是越来越多地在学习自己。

更糟的是,这种封闭往往伴随着一种错觉:系统内部的一致性越来越强,于是团队会觉得模型“越来越稳”。从内部角度看,这种判断并不完全错,因为样本格式更统一了,输出风格更稳定了,裁判标准也更一致了。可问题在于,这种稳定有时只是对内部环境的稳定,而不是对真实环境的稳定。模型在自家构造的数据里确实越来越像一个高分选手,但一旦离开这套熟悉的题面、语言和偏好,它面对真实世界的能力未必同步增长,甚至可能在某些地方悄悄变弱。

封闭系统还有一个很隐蔽的特征,就是它会越来越难以察觉自身的偏离。因为生成、筛选、评估和再训练都发生在同一套逻辑里,很多偏差不会被及时暴露出来。教师喜欢某种语气,裁判也偏好这种语气,模板进一步放大这种语气,学生学会以后再去生成,就会更稳定地延续这种语气。整个链路看上去都没有出错,甚至还越来越整齐,可如果这种语气恰好在真实用户那里并不自然,或者在真实高风险场景里显得过度自信,系统内部却未必会有谁主动指出它。因为对封闭系统来说,这已经成了“标准答案的一部分”。

因此,团队真正需要警惕的不是“是否出现了一些坏样本”,而是“系统是否已经开始用自己的偏好代替现实世界的约束”。只要这个替代过程持续发生,即便单个环节都看起来合理,整体系统也可能在长期中逐步偏离真实任务需求。

真正危险的,不是某一轮自举生成里混进了几条噪声样本,而是系统开始越来越少地接触那些不会顺着内部偏好来的东西。真实用户不会总按模板说话,真实业务也不会总给出边界清楚的输入,很多任务本来就带着混乱、冲突、漏信息和表达跳跃。如果这些东西在训练分布里的占比越来越低,而系统内部生成的“整齐样本”越来越多,那么系统表面上是在变强,实际却是在失去对开放环境的耐受力。

所以,自举系统会逐步变成封闭系统,并不是因为某个环节突然坏掉了,而是因为整条链路都在默默奖励同一种内部一致性。只要这种一致性长期高于对真实世界的贴近,系统就会越来越像一个擅长重复自己、优化自己、确认自己的结构。要打破这种闭环,团队真正需要引入的,不是更多内部生成能力,而是持续把外部世界重新拉进来:真实用户数据、非标准输入、人工校验、跨风格样本、失败案例回流、边界场景复审。只有这些东西不断进入系统,自举才不至于一路滑向自我强化的封闭回路。

风格单一、知识漂移与错误放大的机制¶

合成数据最先带来的往往不是“明显错误”,而是“越来越像一种东西”。所谓风格单一,并不是指句式重复这么简单,而是指样本在表达方式、论证结构、信息展开顺序、拒答模式和语气边界上越来越趋同。当大量样本来自相似教师、相似模板和相似裁判口径时,模型学到的并不是“如何覆盖更多真实变化”,而是“如何更像这个生产系统”。最终,模型在离线数据上表现流畅统一,在真实环境中却显得僵硬、保守甚至模式化。

这种变化之所以容易被忽视,是因为它在前期往往会被误判为“质量更稳定了”。从内部视角看,样本更整齐,输出更规范,措辞更一致,很多原本杂乱的地方被抹平,训练和评估都显得顺畅。可问题在于,真实世界本来就不是整齐的。用户会跳着说话,会省略前提,会带着情绪,会把几种需求混在一起提,也会用各种并不标准的方式表达同一件事。如果模型长期只在一类“长得很像”的样本上被塑形,它当然会越来越会处理这种内部风格,却未必还保有面对真实混乱输入的弹性。

知识漂移则更隐蔽。它并不一定表现为事实错误率突然上升,而常常表现为模型开始偏好某类解释框架、某类因果路径或某类信息取舍方式。例如,模型可能越来越倾向于给出“规范但抽象”的回答,而不再贴近真实场景中的具体约束;也可能逐渐强化教师模型习惯性的知识组织方式,而削弱对真实分布中少数但重要变体的适应。这种漂移在短期内不一定显著影响平均指标,但会逐步改变模型的知识边界。

这里最麻烦的地方,是漂移一开始往往不会把模型变成“明显更差”,而是先把它变成“越来越偏一种做法”。比如原本模型面对复杂问题时,还有几种不同的分析路径可走;经过大量同口径合成数据训练之后,它可能开始习惯先用某一种最常见、最模板化、最容易过裁判的方式去组织答案。表面上看,这种回答并不一定错,甚至还可能更顺、更像标准答案。可一旦任务进入那些需要具体收束、需要辨别例外、需要根据上下文临时调整策略的场景,这种偏好的代价就会暴露出来。模型不是不知道一些知识点,而是越来越不擅长用合适的方式把这些知识调出来。

错误放大的机制最值得警惕,因为它带有明显的累积性。一条合成数据中的局部错误,若只是单独存在,未必造成大问题;但如果这个错误符合裁判偏好、能通过模板检查、还能被下一轮模型继续模仿,那么它就会从一次偶然错误,变成系统性的错误模式。错误放大最可怕之处,不在于错误本身,而在于它会随着数据规模扩张而越来越像“正确做法”。

很多时候,真正危险的不是那种一眼就能看出来的硬错误,而是那些“看起来也说得过去”的半错。比如某个教师模型习惯在信息不足时做一点合理补全,这种补全在单条样本里也许不算特别刺眼;但如果裁判也偏好这种“完整感”,模板又鼓励这种“回答不要留白”的风格,下一轮学生模型就很容易把这种习惯学成默认策略。等到这个学生再参与生成时,这种原本只是教师习惯的小偏差,就会慢慢变成整个系统的共同倾向。最后团队看到的,不再是一两条可疑答案,而是一种越来越稳定、越来越自然、也越来越难被当场挑出来的问题模式。

所以,这三种现象真正可怕的地方,并不在于它们会立刻把系统搞坏,而在于它们都带着“慢慢变成正常”的特征。风格单一会被看成稳定,知识漂移会被看成成熟,错误放大会被看成一致。等团队真正意识到模型和真实世界之间的距离已经拉开时,问题往往已经不是补几条样本、改几个模板就能轻松拉回来的了。

风格单一并不只是“写得像”¶

很多团队在谈风格单一时,只会注意到词汇、句式和语气层面的重复,但真正危险的“风格”远不止表面语言风格。模型的风格还包括它如何组织信息、如何给出结论、如何安排解释顺序、如何处理不确定性、如何使用限制条件。也就是说,风格单一其实是一种更深层的行为单一。

这类单一之所以不容易被及时发现,是因为表面多样性很容易制造一种“好像还挺丰富”的错觉。模型也许会换不同的词,也会调整一些句式,看上去不像在机械复读;可如果它每次都沿着几乎同样的结构往下答,先讲一层泛化背景,再列几个常见因素,最后落到一个标准化结论,那它本质上还是在重复同一种应对方法。用户真正感受到的,也不是词汇有没有变化,而是这个系统是不是总在用同一种理解框架看问题。

例如,一个系统可能看起来词句变化很多,但回答始终采用相同的逻辑展开方式:先泛化背景,再列几个原因,最后给一个标准化结论。或者在所有模糊问题上都采取相似的保守策略,在所有风险问题上都采用近乎固定的拒答模板。这样的模型表面上仍有语言多样性,实质上却已经形成了高度一致的行为风格。一旦进入真实环境,这种风格就很容易显得“正确但不贴切”“规范但不解决问题”。

真实世界里的很多任务,本来就要求模型能够根据情境切换处理方式。用户只是想知道下一步怎么做时,回答最重要的是快和准,而不是先铺一层背景;用户拿着一段复杂条款来问具体责任时,模型更需要把结论和条件绑在一起,而不是先做一轮泛化解释;用户情绪很急时,系统可能得先接住问题,再补说明。要是模型不管面对什么任务都倾向于用同一种回应节奏,它很可能会显得总是“有道理”,却并不总是“有用”。

因此,风格坍缩不能只用表面重复率来理解。更准确地说,它是一种对表达空间和决策空间的双重压缩。模型不是不会说别的话,而是越来越不习惯用别的方式去理解和回应问题。

这也是为什么风格单一在高风险场景里尤其值得警惕。因为这里被压缩掉的,不只是“表达好不好看”,还有“边界怎么守”“不确定时怎么说”“什么时候该先问一句而不是先答一句”这些非常关键的动作。一旦模型长期在单一风格里被塑形,它会越来越倾向于拿自己最熟悉的那套处理方式去覆盖更多问题。结果就是,原本应该分开处理的任务,在模型眼里慢慢都变成了“我平时就是这样回答的”。这时候,所谓风格问题其实已经变成了能力问题。

知识漂移常常先漂在“解释方式”上¶

知识漂移最隐蔽的地方在于,它经常不是先漂在事实点上,而是先漂在解释方式和组织方式上。一个模型可能仍然能够给出表面正确的结论,但它开始越来越偏好某种固定的分析路径,忽略现实场景中的关键条件、上下文限制或例外情况。也就是说,模型的“知识表象”可能暂时没有坏,但它的知识使用方式已经开始变化。

这类漂移之所以难发现,就在于普通评测往往更容易检查“结论对不对”,却不太容易检查“它到底是沿着什么框架走到这个结论的”。如果测试题本身很标准,答案边界也比较清楚,那么模型哪怕已经开始依赖一种简化过头的解释方式,也仍然有机会答对。于是团队会看到指标基本稳定,甚至还会觉得模型回答越来越流畅、越来越熟练。可这种熟练,有时只是对某种固定解释套路的熟练,而不一定是对真实任务复杂性的适应。

这类漂移之所以危险,是因为它很难在普通评测中被立即发现。只要评测问题足够标准、足够接近既有模板,模型仍然可能答对;但一旦问题进入复杂真实场景,需要在多个不完整条件之间权衡、需要针对具体案例收束分析时,漂移后的模型就会明显表现出“答得熟练,却答得不对路”。这种现象尤其容易出现在法律、客服、教育、医疗建议等高上下文依赖任务中。

比如在法律场景里,模型也许依旧知道相关条文,可它越来越习惯先给出一般性解释,再补一句“具体需结合实际情况判断”,却不再真正把具体条件带进分析里。表面上看,它没有说错什么,甚至还显得很稳妥;但对用户真正的问题来说,这种回答已经开始偏离了重点。又比如在客服场景里,模型可能越来越喜欢把问题归到几个常见流程里处理,结果面对那些只差一点点、但实际需要不同处理路径的情形时,它就会显得特别“熟门熟路”,却老是绕不开真正的关键点。

因此,知识漂移不能只靠事实对错来检测,还要关注模型是否越来越偏爱某一种简化现实的解释框架。很多时候,真正被侵蚀的不是知识库存,而是知识调度方式。

从工程角度看,这一点尤其重要,因为知识库存出问题,往往还比较容易通过补数据、加检索、做校验来修;可一旦调度方式开始漂,问题就会更深一层。模型不是“少知道了什么”,而是“越来越习惯怎样去理解问题、怎样去组织知识、怎样去忽略某些条件”。这种习惯一旦形成,会渗到很多任务里。你表面上看到的是一个法律回答不够贴案情、一个客服回答不够贴流程、一个教育解释不够贴学生当前水平,底下其实可能都是同一类漂移:模型越来越爱用自己熟悉的解释框架替代真实情境的复杂约束。

所以,知识漂移最先该盯的,常常不是知识点本身,而是模型在解释时有没有开始越来越“省事”。是不是越来越喜欢先给抽象总结,再补一句保守限制;是不是越来越少处理例外条件;是不是越来越爱走熟悉的因果路径;是不是越来越不愿意根据具体上下文改变分析顺序。只要这些迹象开始变强,即便事实题准确率还没明显掉,团队也应该把它当成一个真正的风险信号。因为这通常意味着,模型并没有停止学习,而是正在朝着一种更整齐、也更窄的知识使用方式收缩。

错误放大为什么比单次错误更危险¶

单次错误的危害通常是局部的、有限的、可修复的;错误放大的危害则是结构性的。系统中的一条错误样本,若只是偶尔混入训练集,未必会带来灾难;但如果这个错误恰好与模板风格一致、与裁判偏好一致、与模型当前分布一致,那么它就会获得比普通错误更高的“存活率”。一旦存活下来,它不仅会被模型学习,还会在下一轮生成中以更自然、更稳定、更难察觉的形式再次出现。

这就是为什么合成数据系统中的错误并不一定是“显眼的假信息”,更多时候它表现为被反复复制的一种偏差、一种结论倾向、一种解释捷径,或者一种省略关键条件的习惯。随着这种模式不断进入训练,模型会越来越相信它、越来越依赖它,最终它从错误演变成系统默认。

在这种意义上,错误放大并不是一件局部 bug 事件,而是一种分布污染机制。团队若只盯着“有没有明显胡说八道”,往往很容易错过真正危险的部分。真正需要治理的是那些能够在系统内部稳定繁殖的错误模式。

模型坍缩在工程里最早出现的信号¶

工程中的模型坍缩,往往不是以“模型突然完全坏掉”的方式出现,而是以一系列细小但持续的信号缓慢浮现。最早出现的通常不是主指标断崖式下跌,而是样本分布和行为边界开始变窄。例如,模型对不同表达风格的鲁棒性下降,对陌生输入形式更容易产生保守回答,对少量扰动更敏感,或者在开放式任务中明显趋向于重复已有模式。

另一个早期信号是“离线稳定、在线波动”。也就是说,模型在标准评测集、固定模板任务或旧版验证集上表现依然不错,但真实线上反馈开始出现风格僵化、答非所问、过度自信、同质化输出等问题。这类现象之所以危险,正因为它不容易被传统平均指标捕捉。系统表面上还在“正常变好”,但真实适应能力已经开始下降。

还有一个经常被忽略的信号,是人工审查中的“似曾相识感”增强。经验丰富的审核人员往往会率先感觉到:样本虽然不一定错,但越来越像从同一个模具里长出来;回答虽然越来越整齐,却越来越少让人感到“这是针对这个问题的真实响应”。这种主观信号并不精确,却常常先于量化退化出现,因而值得作为治理预警的一部分保留下来。

早期信号为什么常常先出现在长尾场景¶

模型坍缩最早往往不是出现在高频主任务上,而是先出现在长尾场景、边界场景和非标准场景里。这是因为高频主任务通常最容易被合成数据覆盖,也最容易被模板和规则规整,因此模型在这些任务上会显得越来越熟练。相反,那些表达多样、上下文复杂、约束模糊、真实噪声高的长尾场景,正是最容易被合成系统稀释掉的部分。

于是,坍缩的最早信号常常表现为:模型在“熟悉题”上很稳,在“稍微陌生一点的题”上却明显保守;在标准措辞下表现良好,在口语化、碎片化、混乱输入下退化明显;在模板化验证集上得分正常,在真实复杂流量中却频繁失去针对性。这种差异并不意味着模型整体已经崩坏,而是说明它的能力边界开始收缩,正在逐步丧失对非标准世界的耐受力。

从治理角度看,这一点非常重要,因为它意味着团队不能只依赖主验证集。如果只看主验证集,系统往往会在很长时间内呈现出“没有问题”的假象;只有把长尾集、困难集、跨域集、脏数据集同时纳入监控,早期坍缩信号才更容易被捕捉到。

离线稳定、在线波动为什么特别危险¶

“离线稳定、在线波动”之所以值得警惕,并不只是因为两套指标不一致,而是因为这种不一致往往意味着模型正在悄悄偏离真实任务。离线评测集本来就是一个被整理过、被命名过、被切分过的世界。它的边界相对清楚,噪声相对可控,评价标准也通常比较固定。线上环境却不是这样。真实用户不会按照数据工程师的理想方式提问,也不会主动把上下文补全,更不会保证表达规范、目标单一、意图清晰。模型如果在前一个世界里越来越“稳”,在后一个世界里却越来越“飘”,那就说明它学会的稳定性,并没有真正穿透到业务现场。

更麻烦的是,这种背离在一开始通常并不刺眼。团队最初看到的,往往只是离线曲线很好看:某些基准集分数稳定上升,波动变小,错误率下降,输出格式更统一。乍一看,这些都像是系统成熟的信号。但如果与此同时,线上却出现了回答越来越空、拒答越来越机械、长尾问题处理变差、场景贴合度下降等现象,那么离线的“平滑”反而可能掩盖了真实问题。因为有时候模型不是更强了,而只是更会在熟悉的规则环境里表现得像个“好学生”。

这类问题在合成数据占比较高的系统里尤其容易发生。合成数据的优点很明显:生成速度快、覆盖广、结构整齐、便于控制质量,也方便围绕某些能力点做定向强化。但它的隐患也恰恰来自这些优点。太整齐的数据,容易让模型习惯于接受已经被整理好的问题;太明确的目标,容易让模型习惯于只在边界清晰的任务里做决策;太干净的表达,则会逐渐削弱模型处理真实噪声的能力。久而久之,模型会形成一种表面上很可靠、实际上很脆弱的稳定性——它在标准环境下答得越来越顺,却在真实环境里越来越缺少弹性。

这种“被规训后的稳定性”很容易给人一种错觉,好像模型已经具备了充分的鲁棒性。其实不然。真正的鲁棒,不是面对熟悉输入时不犯错,而是面对不完整、不规范、甚至有些混乱的输入时,依然能维持基本判断和合理响应。很多系统的问题就在于,它们在训练过程中不断接触格式漂亮、目标明确、评价友好的样本,于是逐渐失去了对模糊场景的耐受力。等到真实用户带着省略、跳跃、夹杂背景噪声的问题进来时,模型虽然还能输出一段通顺的话,却已经不太能真正抓住问题核心了。

从业务角度看,这种现象尤其危险,因为它不只是“某几个样本答错了”,而是系统与用户之间的工作假设开始不一致。离线世界默认的是“问题被定义过”,线上世界面对的却常常是“问题本身也需要被理解和澄清”。如果模型越来越擅长前者,越来越不适应后者,那么它的能力就会出现一种结构性的偏移。团队此时若仍然只盯着离线指标,往往会把线上波动解释成偶然噪声、用户变化、流量难度上升,甚至归因为产品侧改动,却忽略了最核心的事实:模型正在离真实世界越来越远。

所以,成熟团队对离线稳定的理解通常都很克制。离线稳定当然重要,没有它,系统连基本可控性都没有;但它从来不是充分条件。真正有经验的团队,会把离线稳定看作一张门票,而不是终点。他们更关心的是,离线稳定是否伴随着线上一致,是否在不同流量层、不同任务类型、不同用户群体上都能成立。一旦发现离线和在线之间出现持续的、可重复的背离,就应该立刻把它当成治理信号来处理,而不是用一句“今天用户的问题比较难”轻轻带过。

再往深一层说,离线稳定、在线波动之所以危险,还因为它意味着团队的反馈机制可能已经失灵。一个系统如果只能在自己定义好的考场里证明自己,却不能在真实使用中持续兑现价值,那它就很容易陷入“指标正确、方向错误”的状态。真正可怕的不是某次波动,而是系统已经开始用错误的反馈奖励自己,却没有人及时纠偏。

人工感知为什么依然重要¶

在今天的数据治理体系里,自动化几乎已经成为一种默认追求。大家习惯于相信规则、指标、仪表盘、报警阈值,觉得只要监控做得足够细,人的判断迟早会被系统化流程替代。这种想法在很多环节都成立,但到了模型坍缩、分布偏移、合成数据退化这类问题上,事情往往没有这么简单。很多时候,最先发现问题的,不是报表,而是人。

原因很直接。模型的早期退化,常常不是以“错误率暴涨”的形式出现的,而是先表现为一种质感上的变化。回答仍然是通顺的,结构仍然是完整的,格式甚至比以前更规范,可读起来就是觉得有点不对劲。它可能越来越像一个会写标准答案的系统,却越来越不像一个在认真回应真实问题的系统。它可能不再明显犯低级错误,却开始变得空泛、保守、泛化过度。这样的变化,很难在一两个固定指标里立刻显影,但经验足够的人,通常一眼就能感觉到。

这种人工感知并不是玄学。它背后其实是一种长期接触真实样本后形成的整体判断力。经验丰富的审核人员、产品人员或者标注负责人,并不一定能立刻给出一个可量化的结论,但他们往往能敏锐地察觉到模型“说话的方式”变了。以前的回答可能不够工整,却有针对性;现在的回答可能更圆滑,却缺少贴着问题往前走的力量。以前模型在复杂场景里会尝试理解用户,现在却更容易滑向套路化表达,像是在完成某种形式上的任务,而不是真的在解决用户的问题。

这种差别,恰恰是很多自动指标暂时抓不到的。因为自动指标通常更擅长识别显性的偏差,比如格式错误、事实冲突、关键词缺失、答案长度异常等。但模型坍缩早期经常出现的是一种“温和的退化”:回答依旧礼貌,依旧完整,甚至依旧正确,却明显越来越模板化,越来越像从一套熟悉模式里拼出来的结果。它给人的感觉不是坏掉了,而是“变钝了”。而这种“钝”,常常会比硬错误更早出现。

尤其在合成数据大量参与训练之后,人工感知的重要性会进一步上升。因为合成样本天然容易带来某种风格收敛:句式更整齐,逻辑更显性,角色边界更明,表达更像“标准训练材料”。模型长期在这样的分布中学习,最容易先失去的,往往不是语法能力,而是那种面对真实、不规整输入时的贴近感。人类审核者之所以能较早察觉这一点,是因为他们不会只看“有没有答”,而会感受到“答得像不像一个真正理解场景的回应”。

因此,人工感知不应该被当成“不够科学”的补充意见,更不能因为它暂时难以量化,就把它排除在治理系统之外。恰恰相反,它应该被当作一种高价值弱信号来对待。所谓弱信号,不是说它不重要,而是说它出现得早、形式模糊、难以直接作为最终裁决依据,却对趋势判断非常有帮助。很多系统性问题,往往都是先被人“觉得不太对”,然后才逐步在指标上显现出来。如果团队只相信已经成型的量化异常,而忽视这些先行的主观感受,那往往等到报警真正响起时,问题已经积累得比较深了。

更稳妥的做法,不是拿人工感知替代自动评估,而是把它制度化。比如,把审核者的主观异常描述记录下来,做聚类分析,观察是否反复出现类似反馈;把“越来越像模板”“越来越不贴场景”“越来越会说正确的空话”这类描述转化为可追踪的现象标签;再将这些标签与线上波动、流量切片、合成比例变化等信息结合起来,作为预警系统的一部分。这样做的价值,不在于把人的感觉机械量化,而在于承认:在某些关键阶段,人往往比报表更早看到裂缝。

说到底,模型治理从来不是一个只靠算出来就能完成的工作。它同样需要“读出来”“听出来”“感觉出来”。当系统开始越来越像自己生成的数据,而越来越不像它所服务的现实世界时,最先察觉这件事的,往往不是最精密的指标,而是那个长期在跟真实样本打交道的人。

为什么合成数据问题往往不是立刻暴露¶

合成数据带来的风险,最麻烦的一点就在于,它通常不是那种一上线就会爆炸的问题。相反,它往往是先给你一点甜头,再慢慢把代价推迟到后面。很多团队第一次扩大合成数据比例时,看到的往往是积极结果:训练资源更充足了,某些能力点覆盖更完整了,模型在若干基准上的表现也提升了。于是大家很自然地得出一个判断——这套方法有效,而且值得继续放大。真正的隐患,也正是在这种“前期确实有效”的经验里被埋下来的。

这是因为合成数据并不总是有害的。在很多阶段,它确实能补齐空缺、扩大覆盖、强化特定能力,甚至帮助模型快速建立某些行为模式。问题不在于“用了合成数据”,而在于团队很容易把阶段性收益误认为长期稳态,把局部改善误认为系统可靠。前几轮训练见效,常常会带来一种强烈的路径确认:既然模型变好了,那就说明生成流程、筛选逻辑、验证机制都是对的;既然离线分数还在涨,那就说明继续扩大也没问题。于是,真实样本采样被逐渐压缩,人工抽检范围慢慢收窄,线上异常被解释成暂时波动,系统对合成数据的依赖也越来越深。

可风险并不是在某一个节点突然冒出来的。它更像是一种缓慢发生的偏移。模型并不是某一天突然“不会了”,而是在一轮轮自我强化中,逐渐失去对真实世界的熟悉感。真实用户的表达习惯、任务噪声、边界含混、意图跳跃,这些本来应该不断出现在训练反馈里的东西,会随着合成样本占比升高而被一点点稀释掉。模型仍然在学习,只是它越来越多地在学习一个被整理过、被净化过、被设计过的世界。它对这个世界当然会越来越熟练,但对现实世界的适应力,却可能在不知不觉中下降。

从系统动力学的角度看,这种问题之所以晚暴露,是因为它主要不是由单个坏样本造成的,而是由分布结构持续收缩造成的。一个明显错误的样本,团队往往很快就能发现并修复;可如果每一轮生成出来的样本都“看起来没问题”,只是整体上越来越相似、越来越标准、越来越偏向评测友好,那这种风险就很难在局部质检中被察觉。你看到的不是灾难,而是一个缓慢变窄的训练世界。等模型真正在线上表现出明显不适时,通常说明这种窄化已经累积了相当一段时间。

这也是为什么很多团队在事后复盘时会有一种错觉:问题怎么突然出现了?实际上,问题往往一点也不突然。只是前期所有信号都比较柔和,没有形成那种刺眼的红灯。也许只是某些长尾场景先变差,也许只是回答开始更保守,也许只是少数复杂问题上出现不稳定。它们单独看都不够严重,甚至很容易被解释为正常波动。但如果把时间拉长,就会发现这些现象并不是随机发生,而是在共同指向一件事:模型已经越来越依赖那套自己熟悉的合成秩序,面对真实世界的能力正在悄悄流失。

合成数据问题的另一个延迟暴露原因,是它具有“自证合理”的表象。因为很多验证流程本身也是在合成逻辑附近建立的。生成器产生什么样的数据,判别器就更容易习惯什么样的数据;筛选规则偏好什么形式,留下来的样本就越来越符合这种形式;训练后的模型再去做离线评测,又恰好能在相似风格的任务上表现得不错。这样一来,系统内部会形成一种看似闭合的正反馈:生成、筛选、训练、评测彼此支持,处处都像在证明这条路线没问题。可这套闭环一旦与外部真实分布脱节,内部越自洽,风险反而越大。

所以,治理合成数据最大的误区之一,就是等问题“明显出现”了再处理。等到线上指标大幅波动、用户投诉集中增加、关键任务成功率下降时,往往已经说明系统对合成数据形成了较深依赖。此时回退的成本会很高,因为你不仅要调整数据比例,还要重建对真实流量的采样、重启更细的人工验证、重新理解哪些能力是真提升、哪些只是合成环境里的假繁荣。换句话说,问题之所以难治理,不是因为它不可见,而是因为它在可见之前已经积累了很久。

也正因此,成熟团队不会把“目前还没出事”理解为“机制已经安全”。他们更关注的是,真实数据在训练中的存在感是否在持续下降,长尾样本是否被不断稀释,人工抽检是否还能接触到真正脏、真正难、真正不像模板的问题,线上和离线是否还保持着足够紧的耦合。因为合成数据的风险从来不是某次明显出错,而是模型慢慢开始不再习惯真实世界,而这件事一旦形成惯性,就不会自己好起来。

风险的累积性会制造“延迟错觉”¶

合成数据问题之所以经常被低估,很大程度上是因为它具有明显的延迟累积特征。前一轮新增的几万条样本,可能不会立刻让模型退化;某一个模板版本的偏差,也未必会马上体现在主指标上;裁判口径略微收窄,短期看甚至可能让质量更“稳定”。但这些微小变化一旦叠加,就会在若干轮之后形成难以忽视的整体趋势。

这种延迟性会制造一种很危险的错觉:团队会觉得“既然上一次加比例没问题,这一次再加一点也应该没事”;“既然模板一直可用,那继续复用也没什么问题”;“既然离线指标还稳,那说明系统依然健康”。实际上,很多风险正是在这种一次次看似合理的小幅推进中被累积起来的。直到线上表现开始明显下滑、样本仓库已经被污染、真实数据占比已经过低时,团队才意识到自己错过了最佳治理窗口。

因此,治理合成数据不能只盯即时反馈,还必须关注趋势反馈。单次观察常常给不出答案,但连续多个版本的方向变化却能揭示真实问题。一个成熟系统需要监控“是否在慢慢变窄”,而不仅仅监控“这次有没有突然变坏”。

回退成本为什么总是晚于风险暴露¶

合成数据系统还有一个工程上很现实的问题:真正意识到风险的时候,往往已经不再容易回头。因为一旦系统长期依赖合成数据,问题就不只是“模型版本出了偏差”,而是样本仓库、模板体系、裁判标准、训练配比乃至评测集都可能已经不同程度地被影响。这时即便发现退化,团队也很难通过简单地回退一版模型来彻底恢复。

这也是为什么合成数据治理必须前置。它不能等到“结果已经明显坏掉”时再处理,因为那时要付出的往往不是一次修补成本,而是一整套链路重建成本。对很多实际团队来说,最贵的从来不是生成数据本身,而是当数据系统已经把模型训练方向带偏之后,再把整套体系拉回现实世界所需要的时间和组织代价。

17.2 风险形成机制¶

合成数据风险并不是某个单点错误引发的,而是一整套数据生成、筛选、配比和验证机制共同作用的结果。真正危险的不是某条坏样本,而是系统开始稳定地产生“看起来不错、实际上越来越窄”的样本分布。当数据闭环、裁判逻辑、模板结构和训练策略相互强化时,风险就会从局部缺陷演化为系统性衰减。

从表面看,风险形成似乎只是几个局部问题的叠加:模板可能太固定,裁判可能有偏好,生成器可能过于相似,训练时合成比例可能过高。但从系统视角看,这些并不是彼此独立的点状问题,而是一组会互相增益的机制。模板固化会提高裁判一致性,裁判偏置会进一步强化样本筛选方向,样本筛选方向又会影响训练分布,训练后的模型再反过来影响下一轮生成。于是,风险不是静态存在于某个环节,而是在整个闭环中被不断再生产。

因此,理解风险形成机制,关键不在于问“哪一个环节最危险”,而在于看清这些环节如何共同把系统推向分布收缩、自相似增长和现实脱耦。如果团队只修一个局部环节,例如换一个更强的教师模型,却不调整模板、裁判与比例控制,那么风险往往并不会消失,只会换一种形式继续存在。

数据闭环过窄导致的多样性衰减¶

多样性衰减通常是模型坍缩最根本的来源。当一个团队的合成数据主要来自少数教师模型、固定模板和有限任务池时,样本空间虽然在数量上继续扩张,但在能力空间上却可能不断收缩。表面上看,数据越来越多;实际上看,模型反复接触的是同一类表达、同一类结构和同一类判断习惯。

这种闭环过窄并不一定是因为团队故意偷懒,而常常是因为工程系统天然追求可控性。模板越固定,生成越稳定;裁判越统一,筛选越高效;样本越相似,训练越容易收敛。问题在于,工程上的“稳定”与分布上的“丰富”往往并不一致。一个过于稳定的合成流水线,最终可能生产出非常一致、非常整齐、也非常单一的数据宇宙。学生模型在这样的宇宙里训练得越久,越容易失去对真实复杂性的耐受力。

更重要的是,多样性衰减并不总以“样本看起来很少变化”的方式出现。很多时候,表面文本差异仍然存在,主题也似乎覆盖广泛,但在更深层的能力维度上,样本其实已经高度集中。例如,它们可能都采用相同的解释框架、相似的论证节奏、固定的风格边界和类似的工具调用方式。换句话说,系统保留了表面的变化,却丢掉了真正决定泛化能力的变化。

多样性为什么最容易在工程优化中被牺牲¶

多样性之所以容易衰减,并不是因为团队不重视它,而是因为在工程优化中,多样性天然不如一致性容易被看到。模板一致、答案统一、评分稳定、训练顺滑,这些都是可以直接观察和汇报的工程收益;而“样本依然保持足够丰富的现实差异”则更难量化,也更难在短期指标中体现。因此,团队在追求效率和可控性时,往往会无意识地一步步削弱多样性。

例如,为了提高生成成功率,团队会倾向于收紧提示模板;为了提高裁判一致性,团队会倾向于减少开放表达;为了加快训练收敛,团队会倾向于使用更整齐、更规整的样本;为了降低人工审核成本,团队会倾向于扩大那些已经被验证“好管”的数据来源。所有这些动作单独看都合理,但叠加起来,就会把系统推向一个越来越平整、越来越好管理、也越来越失真的数据空间。

这说明,多样性衰减并不总是低质量管理的结果,很多时候它恰恰是高效率管理的副产品。团队越会做流程优化,越需要主动设立机制去保护那些“不那么整齐、但对现实有价值”的样本差异。

闭环过窄为什么会先伤害长尾而不是主干¶

当数据闭环逐渐变窄时,最先被伤害的通常不是系统的主干能力,而是长尾能力和边界能力。这是因为主干任务本来就更容易被覆盖、被模板化、被规则化,因此即使多样性在下降,主干区域仍然可以维持相对不错的表现。真正被快速挤压的是那些原本就稀疏、复杂、非标准、难以模板化的部分。

例如,标准问答、常规分类、主流风格生成等任务,往往能在合成闭环中长期保持良好表现;但跨领域混合问题、表达不完整的问题、场景上下文很强的问题、需要处理例外条件的问题,却会因为缺少真实摩擦而越来越少出现在训练集里。于是,模型整体看似没有显著退化,但一旦进入真实复杂环境,就会表现出明显的脆弱性。

这也是为什么很多团队在早期没有及时识别坍缩:因为他们主要观察的是主干任务,而不是那些真正最能反映系统开放性的长尾区域。闭环变窄并不会先把“最常见的能力”拿走,它会先把“最难保住的能力”拿走。

裁判偏置、模板固化与样本自相似增长¶

裁判模型原本是为了做质量控制,但一旦裁判标准本身带有偏好,它就可能悄悄把样本世界收缩到某一种“被偏爱的形态”。例如,裁判可能更偏好结构整齐、措辞规范、结论明确的样本,于是那些略显粗糙但更接近真实输入分布的样本会被过滤掉。久而久之,留下来的样本越来越“工整”,却也越来越远离真实场景中的噪声、歧义和非标准表达。

模板固化则进一步加剧这一问题。模板本是为了提高生成一致性和可控性,但当模板被长期复用且缺乏修订时,它会把问题表达、答案结构、推理顺序甚至风格边界固定下来。这样生成的数据,在局部看是高质量的,在整体看却在持续增加自相似度。样本不再是从真实世界抽样,而是在模板世界中自我复制。模型最终学到的是“如何符合模板系统”,而不是“如何应对真实问题”。

样本自相似增长是合成数据系统中一个典型但易被忽视的风险。它不一定表现为逐字重复,更多时候表现为结构重复、语义重复和逻辑重复。样本之间看上去不同,但展开方式、决策路径和信息取舍高度一致。对于训练系统来说,这种“伪丰富”比显性重复更危险,因为它会制造一种覆盖率很高的错觉。

裁判偏置为什么会比教师偏置更隐蔽¶

很多团队在讨论风险时,首先会想到教师模型的偏差,例如教师知识不全、风格单一、判断有误。但从系统治理角度看,裁判偏置往往比教师偏置更隐蔽,也更危险。因为教师偏置通常直接体现在生成结果中,较容易被人眼察觉;而裁判偏置体现在“什么样的结果被留下来”,它不是生成问题,而是筛选问题。筛选问题最难发现,因为最后进入系统的数据往往都“看起来不错”。

一旦裁判偏好某种表达方式、某种论证形式或某种答案结构,它就会在不知不觉中持续提高这类样本的生存概率。那些更接近真实分布、但不够规整、不够漂亮、不够模板友好的样本,会被系统性地排除在外。久而久之,样本仓库会越来越像裁判喜欢的世界,而不是用户生活的世界。

因此,裁判偏置的治理难点不在于“它会筛错一些样本”,而在于它会稳定塑造整个训练集的气质。只要裁判口径长期单一,哪怕教师多样性本来不错,最终留下来的数据也可能仍然高度趋同。

模板固化为什么会制造“高质量假象”¶

模板固化常常伴随着一种很强的高质量假象。因为固定模板确实能够显著提升样本整洁度、答案完整性和形式一致性,甚至让人工审查在短期内也更轻松。团队会看到生成成功率提高、评审波动降低、输出更像“标准答案”,于是很容易误以为数据质量整体在上升。

但问题在于,模板固化提高的往往是可控质量,而不一定是真实质量。它让样本更像一份被规范化处理过的理想文本,却不一定更像真实世界里的任务样本。模板使用得越久,系统越容易在看不见的地方损失灵活性:问题提法被固定,回答结构被固定,风险表达被固定,推理路径也被固定。模型最后学习到的,是如何在模板轨道内高效运行,而不是如何在开放环境中灵活应对。

这就是为什么模板治理不能只看“输出是否整齐”,还要看“输出是否越来越像系统规定的唯一正解”。只要模板开始压制真实差异,它就不再只是生成工具,而成为一种分布收缩机制。

样本自相似增长为什么比显性重复更难治理¶

显性重复相对容易处理,因为它通常可以通过字符串去重、嵌入相似度阈值、聚类去重等方式被快速识别。但样本自相似增长更难,因为它发生在更高层次的结构与逻辑上。两个样本表面上可以使用不同词汇、不同场景、不同主题,但它们仍然可能共享几乎相同的任务拆解方式、答案收束方式和论证结构。

这类问题之所以难治理,是因为常规去重方法往往看不见“同一种思路被包装成不同文本”的现象。团队会误以为数据集很大、覆盖很多,实际上模型看到的却是被反复重述的少数思维模板。长此以往,模型会越来越倾向于用这些熟悉模板去解释和回应一切问题,从而失去对新结构、新噪声和新情境的敏感度。

因此,治理样本自相似增长,不能只靠文本级去重,还需要从结构骨架、任务路径、论证样式和风格族群等更高维度做分析。否则,系统很可能在“几乎没有重复”的报表中,悄悄发生严重的分布内卷。

合成比例过高对训练稳定性的影响¶

合成数据不是不能多用,而是不能在缺乏分层治理时过度使用。合成比例过高带来的第一个问题,是训练信号开始由“真实世界主导”转向“生成系统主导”。一旦这一转变发生,模型优化方向就会逐步被合成分布牵引。若合成分布与真实分布之间存在风格偏差、难度偏差或知识边界偏差,那么训练过程就会越来越稳定地朝错误方向收敛。

第二个问题是稳定性错觉。高比例合成数据往往更整齐、噪声更低、格式更统一,因此训练曲线可能看起来更平滑、指标波动更小。但这并不一定意味着模型真的更稳,而可能只是因为训练集变得更容易了。模型在一个过度洁净的监督环境中收敛得越顺滑,进入真实环境时的落差反而可能越大。

第三个问题是模型会失去对真实困难样本的“摩擦感”。真实数据中的不完整信息、冲突信号、用户噪声、领域外表达,恰恰是塑造模型稳健性的关键部分。高比例合成数据若将这些部分持续稀释,模型就会越来越少接触真正磨练边界判断的样本。长期看,这会直接削弱泛化能力和异常场景适应能力。

合成比例问题本质上是“谁在定义训练世界”¶

讨论合成比例,不能只停留在一个静态百分比上。更关键的问题其实是:当前训练世界究竟是由谁在定义。只要真实数据仍然主导任务边界、风格变化和困难样本分布,那么合成数据即便占比较高,也仍然可能是在做有益补充。但如果真实数据已经退到边缘,合成系统开始主导什么问题值得学、什么表达值得保留、什么答案算高质量,那么即便合成比例数字看起来还不算极端,风险也可能已经很高。

这说明,比例不是孤立变量,而是闭环权力分配的体现。团队不能只问“现在是不是 40% 或 60%”,更应问“真实世界在训练集中还有没有足够的话语权”。如果真实样本只剩下一个装饰性比例,而生成样本已经决定了主要分布,那么问题就不是高不高一点,而是训练世界已经被系统内部接管。

为什么高比例合成会制造“收敛更好”的幻觉¶

高比例合成数据往往会带来一种非常迷惑人的现象:loss 更平滑、训练更稳定、验证波动更小,甚至若干常规指标也会更漂亮。对工程团队而言,这种表现天然具有说服力,因为它非常符合“系统正在变得更好控制”的直觉。

但从分布角度看,这种顺滑往往来自训练世界被过度规整,而不是来自模型真正学会了更复杂的能力。合成数据越多,训练目标越可能集中在模板友好、结构清晰、噪声较低的区域;模型自然更容易学会这些内容,也更容易在同类验证环境中表现良好。问题在于,这种收敛的顺滑性并不能自动转化为真实环境中的鲁棒性,反而可能意味着模型对复杂现实的免疫系统正在退化。

因此,当团队看到“训练更稳了”时,不应立刻把它解释为正信号,而应进一步确认:这种稳,是因为模型更懂真实世界,还是因为真实世界已经被从训练里洗掉了一部分。

真实数据中的“摩擦感”为什么不可替代¶

真实数据之所以重要,不只是因为它更真实,而是因为它包含了大量系统不愿意、也不擅长主动生成的摩擦。用户会表达不清,输入会不完整,约束会互相冲突,场景会跨域混合,甚至任务本身也可能没有单一标准答案。这些因素让真实数据显得脏、乱、难处理,但也正是这些因素在塑造模型真正的适应能力。

合成数据如果长期稀释这种摩擦,模型就会逐步失去在不确定环境中做判断的能力。它可能仍然会答题、会生成、会遵守格式,但面对真实世界时,缺少那种被复杂样本磨出来的张力。它会更快倾向于套模板、走熟路、给出保守答案,而不是在具体场景中重新组织理解。

因此,真实数据的价值不仅在于提供“更多样本”,更在于提供“无法被轻易规整的现实阻力”。这种阻力对训练来说虽然不舒服,但对能力形成却不可替代。

风险信号与可能原因对照表¶

| 早期风险信号 | 常见表征 | 可能原因 | 优先排查方向 |

|---|---|---|---|

| 输出风格高度统一 | 句式、结构、措辞越来越像 | 模板固化、单教师主导、裁判偏好单一 | 模板版本、教师来源分布、裁判打分口径 |

| 线上用户反馈变差但离线分数稳定 | 平均指标正常,真实满意度下降 | 验证集过旧、分布偏移、真实噪声被过滤 | 真实流量抽样、影子评测集、线上回放 |

| 模型对非标准表达更脆弱 | 口语化、缺信息输入时退化明显 | 合成样本过于规整,多样性不足 | 真实脏数据占比、困难样本覆盖 |

| 训练更平滑但长尾更差 | loss 漂亮,复杂任务下降 | 合成比例过高、训练环境过洁净 | 合成比例梯度实验、长尾桶评测 |

| 人工审核出现“模板感” | 样本看似正确但缺乏针对性 | 样本自相似增长、风格坍缩 | 相似度分析、聚类抽检、模板修订 |

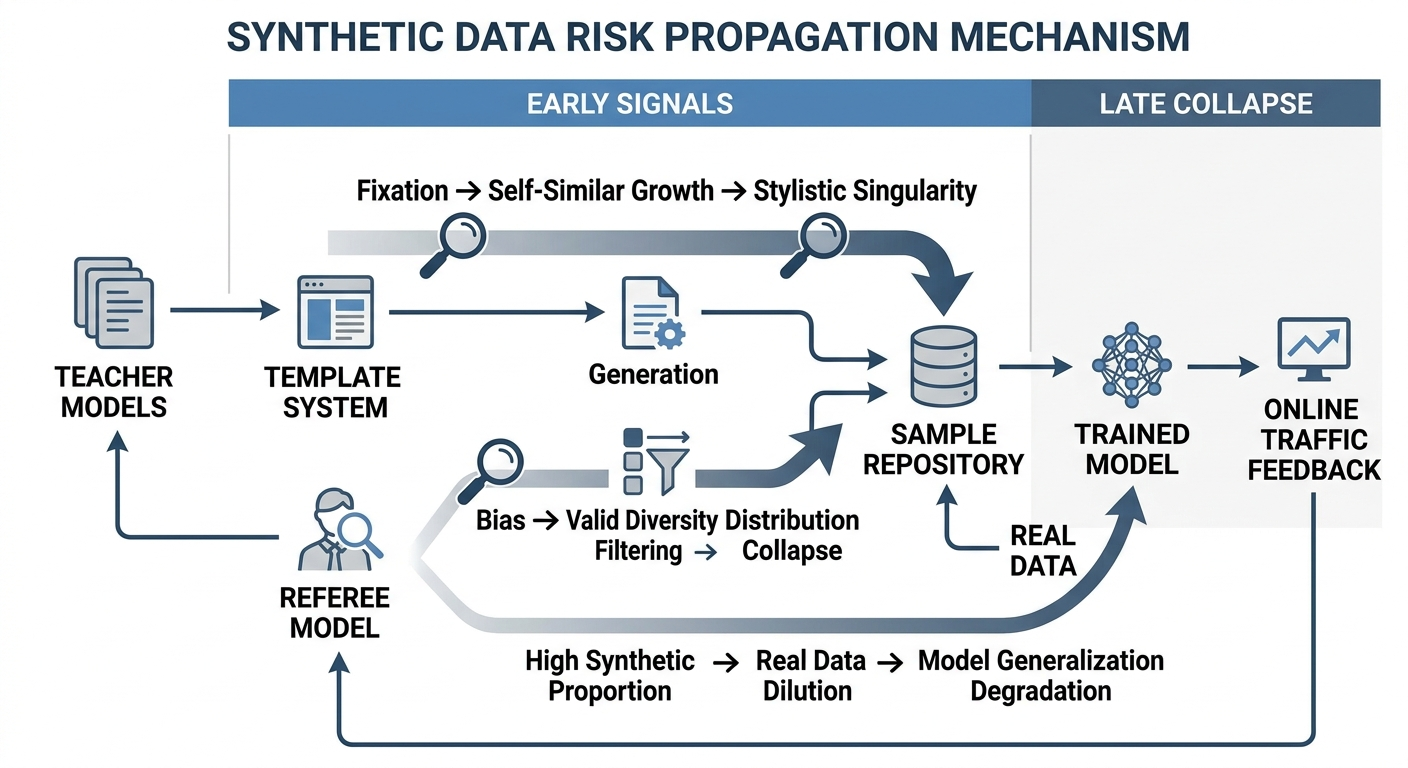

为了更直观地呈现风险形成机制,下面用一张图来展示。

图17-1:合成数据风险传播机制图

17.3 检测指标与对照实验¶

合成数据治理最忌讳凭感觉做判断。因为很多风险在主观上“看起来还行”,在平均指标上“还没坏”,但在分布层面已经开始出现漂移。因此,团队必须建立一套同时覆盖数据分布、训练行为、离线评测和线上反馈的多层检测体系。单一指标通常不足以确认风险,多指标联动才更接近真实状态。

分布差异、重复率、困惑度、评测退化指标¶

分布差异是检测合成数据风险的第一层入口。团队需要持续比较真实数据与合成数据在长度、主题、任务类型、语言风格、难度层级、工具调用模式等多个维度上的分布差异。如果合成数据在这些维度上越来越集中,说明样本覆盖正在变窄。单看样本条数没有意义,关键是它们是否仍然代表真实世界中的多种变化。

重复率检测不仅要看文本重合,更要看结构重复和语义重复。许多合成数据集表面上经过了去重,但仍存在大量“换词不换骨架”的样本。对此,团队应当同时监控 n-gram 重复、嵌入相似度聚类比例、模板骨架重复率等指标,避免把表面多样性误判为真实多样性。

代码示例:用“嵌入相似度 + 近邻比例”粗测样本自相似增长

下面用一个非常朴素的方式演示“自相似监控”的思路:把文本向量化后,统计有多少样本与其最近邻相似度超过阈值(比例越高,说明数据越容易内卷到少数模式)。

from typing import List

import math

def cosine(a: List[float], b: List[float]) -> float:

dot = sum(x * y for x, y in zip(a, b))

na = math.sqrt(sum(x * x for x in a))

nb = math.sqrt(sum(y * y for y in b))

return dot / max(na * nb, 1e-9)

def nearest_neighbor_sim(vs: List[List[float]]) -> List[float]:

sims = []

for i, v in enumerate(vs):

best = -1.0

for j, u in enumerate(vs):

if i == j:

continue

best = max(best, cosine(v, u))

sims.append(best)

return sims

if __name__ == "__main__":

# 教材演示:这里用“假向量”代替真实 embedding

vectors = [

[1, 0, 0],

[0.98, 0.05, 0],

[0, 1, 0],

[0, 0.99, 0.02],

[0, 0, 1]

]

sims = nearest_neighbor_sim(vectors)

threshold = 0.95

ratio = sum(1 for s in sims if s >= threshold) / len(sims)

print("近邻相似度>=阈值的比例:", ratio)

困惑度与评测退化指标则提供了另一个角度。若模型在合成数据上的困惑度持续下降,但在真实验证集、长尾验证集或跨分布验证集上的表现没有同步提升,甚至开始下降,这通常说明模型正在过度适应合成分布。真正健康的合成数据系统,应当让“在真实任务上更好”与“在训练集上更熟练”保持基本一致,而不是两者逐步背离。

合成比例梯度实验与 ablation 设计¶

要判断合成数据是否在制造风险,最有效的方法之一不是继续争论“比例高低是否合理”,而是系统地做比例梯度实验。例如,将训练数据中的合成比例设置为 0%、10%、30%、50%、70% 乃至更高,并在同一套评测体系上观察主指标、长尾指标、鲁棒性指标和线上代理指标的变化趋势。真正重要的不是某个单点分数,而是曲线形态:收益何时开始放缓,风险何时开始放大,拐点出现在什么位置。

代码示例:把“合成比例梯度实验”做成可重复的实验矩阵

下方代码中的 notes 字段为示意值,仅用于说明记录结构,实际数值需由你的训练与评测流水线回填。

from dataclasses import dataclass

from typing import List, Dict

@dataclass

class MixPlan:

synth_ratio: float # 0.0 ~ 1.0

real_ratio: float

def build_mix_plans(ratios: List[float]) -> List[MixPlan]:

return [MixPlan(synth_ratio=r, real_ratio=1 - r) for r in ratios]

def run_experiment(plans: List[MixPlan]) -> List[Dict]:

results = []

for p in plans:

# 这里用占位符演示:实际应调用训练脚本 + 评测脚本

results.append({

"synth_ratio": p.synth_ratio,

"real_ratio": p.real_ratio,

"main_metric": None,

"tail_metric": None,

"robust_metric": None,

"notes": "训练损失 0.62,AlpacaEval 胜率 71.3%,详见 ./reports/run_2026Q1.json"

})

return results

if __name__ == "__main__":

plans = build_mix_plans([0.0, 0.1, 0.3, 0.5, 0.7])

print(run_experiment(plans))

ablation 设计也必须围绕风险机制展开,而不只是围绕模型结构展开。例如,可以分别去掉裁判筛选、去掉模板多样化、去掉真实数据回灌、去掉失败样本保留,观察系统退化方式。这样做的目的,是识别“哪一个治理环节在真正抑制坍缩”。如果没有这些对照实验,团队即使观察到退化,也很难知道问题究竟来自合成比例过高,还是来自裁判偏置、模板固化或验证集老化。

在线效果退化与离线指标漂移的关联分析¶

合成数据风险最棘手的地方之一,在于离线与在线不总是同步。离线评测集可能过于干净、过于稳定,无法及时反映真实业务的变化。而线上流量虽然最真实,却又混杂了产品逻辑、用户行为、时序变化等多种因素。因此,团队不能只盯离线指标,也不能只凭线上投诉,而是需要做两者之间的关联分析。

一种可行的方法,是建立“线上问题类型—离线代理指标”映射。例如,如果线上出现风格单一和答非所问问题,就要看离线的风格多样性指标、开放式问答鲁棒性指标是否同步漂移;如果线上出现复杂场景成功率下降,就要检查长尾集、困难集和跨域集的退化是否提前发生。只有把线上问题拆解为可被离线代理捕捉的信号,治理系统才可能形成真正闭环。

检测指标、阈值与治理动作表¶

| 指标类别 | 代表指标 | 风险信号 | 建议动作 |

|---|---|---|---|

| 分布指标 | 长度分布差异、主题覆盖差异、任务类型占比 | 合成数据集中到少数模式 | 扩充真实样本、打散模板、增加困难样本 |

| 重复指标 | 文本重复率、嵌入聚类重复率、模板骨架重复率 | 样本自相似增长 | 去重、聚类抽检、模板重写 |

| 训练指标 | 合成集困惑度持续下降、真实集收益停滞 | 过拟合合成分布 | 降低合成比例、冻结部分模板 |

| 离线评测 | 长尾集退化、跨域集退化、鲁棒性下降 | 模型适应边界变窄 | 增加真实长尾数据、做比例对照实验 |

| 线上指标 | 满意度下降、人工复核率上升、投诉模式集中 | 离线未覆盖真实退化 | 回放线上流量、构建影子验证集 |

指标体系必须服务于决策,而不是只服务于报表¶

许多团队并不缺指标,而是缺“能触发动作的指标”。也就是说,监控大盘上有大量数字在变化,却没有人知道变化到什么程度需要停更、限流、回退或修模板。一个真正有用的指标体系,必须和治理动作绑定:什么指标一旦越过阈值,需要启动人工抽检;哪些指标连续两周恶化,就必须降低合成比例;哪些指标若在线上线下同时漂移,说明需要触发版本冻结。

否则,检测体系就会退化成一种被动记录工具。团队看见了漂移,却没有动作;看见了退化,却只能解释。对于合成数据这种具有累积风险的系统来说,检测若不与决策绑定,就等于没有真正治理。

17.4 风险闸门与回退策略¶

合成数据系统一旦进入训练和上线环节,最怕的不是偶发问题,而是缺少刹车机制。所谓风险闸门,就是在风险尚未扩大之前,通过比例控制、版本冻结、人工抽检和外部验证,把问题限制在可治理范围内。所谓回退策略,则是在问题已经开始显现时,能够迅速把系统拉回到上一个安全状态,而不是继续带病运行。

合成比例上限、冻结策略与人工抽检阈值¶

合成比例上限不是一个学术常数,而是一个工程闸门。它的意义不在于精确到某个固定百分比,而在于防止系统在没有充分验证的情况下,让合成数据主导训练分布。一个成熟团队通常不会允许比例无节制增长,而是会在不同任务、不同阶段设定不同上限,并要求每次突破上限都必须附带对照实验和专项评审。

冻结策略同样重要。当某一模板、某一教师、某一裁判版本出现明显风险信号时,最合理的反应不应是“先继续观察”,而应是立刻冻结新增流量或冻结继续扩样。冻结并不意味着整个系统停止,而是防止有问题的生成机制继续污染样本仓库。很多坍缩问题之所以难以收拾,正是因为团队在早期发现异常后没有冻结入口,任由问题样本继续累积。

人工抽检阈值则是防止系统彻底自我封闭的重要手段。只要合成数据仍在扩张,人工抽检就不应完全退出,而应在风险提高时自动加密。尤其当模板更新、裁判更替、教师替换或合成比例提升时,人工抽检阈值应相应提高,以弥补自动评审体系可能出现的盲区。

引入真实数据回灌与外部验证的方式¶

真实数据回灌是打破闭环最有效的方法之一。所谓回灌,不只是把少量真实样本重新放回训练集,而是让真实世界持续对合成系统施加约束。真实用户交互、人工修正样本、线上失败案例、领域专家复核结果,都应当被组织成一种“现实校正信号”,周期性进入样本仓库与评测仓库中。只有这样,系统才不会越来越沉迷于自己的生成世界。

外部验证的作用,则在于防止内部评价体系过度自洽。一个团队若长期只用自己的教师、自己的裁判、自己的模板和自己的评测集,就很容易形成封闭的优等生幻觉。适度引入外部验证集、外部知识基准、第三方人工评审甚至独立小组复查,能够有效识别“内部系统看起来很好、外部标准却已经退化”的情况。

版本回退、模板修订与治理流程¶

版本回退必须是预先设计好的能力,而不能是出问题后临时拼凑的动作。对于合成数据系统来说,回退对象通常不只包括模型版本,还包括模板版本、裁判版本、样本仓库快照和配比策略版本。因为很多时候问题不在模型本身,而在上游样本分布已经污染。若只能回退模型而无法回退数据与模板,系统就很难真正恢复。

模板修订则是治理流程中最常见也最容易被低估的一环。许多风格坍缩问题最终并不是通过“换更强模型”解决的,而是通过重写模板、增加开放字段、引入反模板样例、打散固定回答结构等方式缓解的。模板不是小问题,它本身就是数据分布的制造机。

从组织层面看,治理流程还应明确责任归属:谁负责监控指标,谁有权触发冻结,谁决定恢复上线,谁负责版本复盘。没有流程边界,再好的治理原则也会在高压上线节奏中失效。

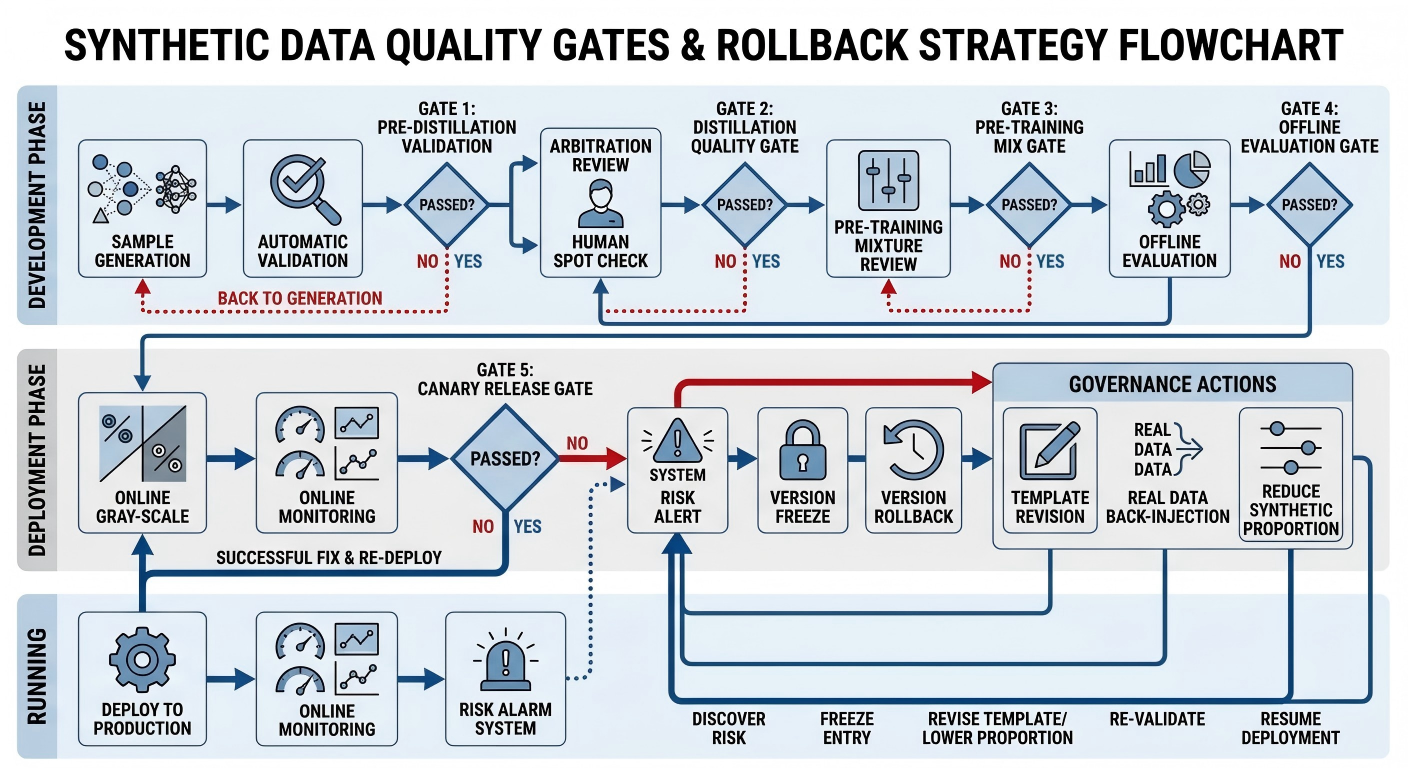

为了更直观地呈现治理链路,下面给出一张适合书稿配图的提示词。

图17-2:合成数据质量闸门与回退策略流程图

回退不是失败,而是系统成熟的表现¶

许多团队在面对风险时不愿意回退,因为回退看起来像承认前一版工作无效。但对合成数据系统而言,回退恰恰是成熟治理的重要标志。一个不能回退的系统,不是真正高效,而是高风险。尤其在存在分布污染可能的场景中,快速回退到上一个安全版本,往往比继续做局部补丁更稳妥。

因此,团队文化也需要为回退留出正当性。回退不应被视为个人判断失误,而应被视为系统自我保护能力的一部分。只有在这种前提下,风险闸门才能真正被执行,而不是写在流程文档里却没人敢按下。

17.5 案例复盘与治理 checklist¶

治理体系的价值,最终还是要回到真实案例中理解。很多团队真正意识到合成数据风险,不是在读到某篇论文之后,而是在某次上线后发现模型开始“越来越像一个会考试的学生,却越来越不像一个会做事的系统”。案例复盘的意义,不在于证明谁做错了,而在于把风险机制、检测信号与治理动作串联起来,形成组织记忆。

合成题库质量崩塌案例¶

在题库类系统中,合成数据最常见的风险之一是“题目越来越标准,能力越来越单一”。最初,团队用教师模型大规模扩充题目、答案和解析,显著提高了题库规模与格式统一性。前两轮效果通常很好,因为学生模型迅速掌握了高频题型的稳定解法。

但随着模板长期复用、教师来源单一、裁判越来越偏好“结构完整”的解析,题目开始出现同构化:设问方式固定、解析套路固定、干扰项设计固定、知识点覆盖也集中在教师擅长的区域。模型在内部评测上表现依然优秀,甚至做题速度更快,但一旦遇到真实考试风格中的变体题、跨知识点题和表述噪声题,性能明显下降。问题并不是题目错了,而是题库越来越像生成器自己的世界。

这类案例的治理关键,通常不在于再加更多题,而在于打破题库分布的内卷结构。包括引入真实错题、增加不同来源的命题风格、保留非标准表达、将模板从“固定生成”改为“扰动生成”,以及建立题型多样性和干扰项多样性监控。题库系统最怕的,不是题少,而是题越来越像。

合成客服语料风格坍缩案例¶

客服场景中的坍缩更具迷惑性,因为它初期往往被误认为“服务更规范了”。当团队使用合成语料训练客服模型时,常常会先看到明显收益:回复更礼貌、格式更整齐、风险措辞更统一、敏感话术更少。可一段时间后,问题开始出现:回复越来越像标准公文,越来越缺乏针对性,用户感受到的不是“专业”,而是“机械”。

这种风格坍缩通常源于几个机制叠加。第一,模板为了降低风险而过度保守,导致样本不断强化某一类安全表达。第二,裁判模型偏好完整、礼貌、低风险回复,于是更具个性和上下文适应性的回答被持续筛掉。第三,真实客服语料中的打断、追问、情绪波动和场景细节被合成系统视为噪声,长期得不到回灌。结果就是模型越来越会“说对的话”,却越来越不会“对着这个人说话”。

治理这种问题,通常需要同时修模板和补真实数据。模板上要放松单一路径,增加情境差异和回复层次;数据上要回灌真实客服对话中的多轮上下文、情绪变化和复杂需求;评测上则要增加“针对性”“上下文适配度”“避免空泛礼貌”等指标,而不能只看合规与流畅。

合成数据治理 checklist 与上线红线¶

治理 checklist 的价值,在于把抽象原则转化为可执行检查项。合成数据系统之所以容易失控,一个重要原因是团队经常在“总体感觉还可以”的状态下继续扩张。上线红线的意义,就是明确哪些问题一旦出现,系统必须暂停、回滚或重审,而不能继续依赖主观乐观判断。

| 检查维度 | 必查问题 | 上线红线 |

|---|---|---|

| 数据来源 | 是否长期依赖少数教师/少数模板 | 单一来源长期占主导且无外部校正 |

| 样本分布 | 是否监控真实/合成分布差异 | 分布明显收缩却无真实回灌 |

| 重复与相似性 | 是否检测结构重复与语义重复 | 自相似持续上升且未触发治理 |

| 评测体系 | 是否有长尾集、跨域集、影子集 | 只有旧版标准集、无真实代理集 |

| 比例控制 | 是否做过合成比例梯度实验 | 合成比例提高但无对照验证 |

| 人工复核 | 是否在关键变更时提升抽检强度 | 教师/模板/裁判更新后仍低抽检 |

| 回退能力 | 是否能回退模型、模板和样本版本 | 只能回退模型、无法回退数据链路 |

checklist 不是文档,而是上线前的最后闸门¶

很多团队会写 checklist,但真正的问题在于它常常停留在文档里,而没有变成上线流程的一部分。一个有效的合成数据治理 checklist,不应只是项目复盘时翻出来看的材料,而应在每次比例提升、模板更替、裁判更新和大版本上线前被逐项执行。只有当 checklist 与“能否上线”直接挂钩时,它才具有真正的治理力量。

从这个角度看,红线也不只是技术红线,更是组织红线。它要求团队在速度和安全之间做明确取舍:有些版本即便能带来短期收益,只要踩到分布治理、人工验证或回退能力的红线,就不应进入生产环境。合成数据系统最危险的时刻,往往不是大家不知道有风险,而是大家都知道有风险,但仍然因为节奏压力选择继续推进。

本章小结¶

合成数据不是模型能力的天然放大器,而是一种同时携带增益与风险的工程资源。它之所以能够显著提高数据生产效率,是因为模型可以参与样本生成、评审和扩展;它之所以可能反噬模型能力,也正是因为这种自举机制会让偏差、模板习惯和错误模式一起被规模化复制。风格单一、知识漂移、样本自相似增长与训练稳定性假象,正是这种闭环逐步变窄后的常见结果。

从工程治理角度看,真正需要控制的不是“是否使用合成数据”,而是“合成数据是否正在替代真实世界,而不是补充真实世界”。为此,团队必须建立围绕分布差异、重复率、困惑度、评测退化和线上反馈的多层检测体系,并通过比例梯度实验与 ablation 识别风险拐点。与此同时,风险闸门、模板冻结、人工抽检、真实数据回灌、外部验证与版本回退,构成了阻止坍缩扩散的基本防线。

案例复盘表明,合成数据质量崩塌往往不是从“明显错误”开始,而是从“越来越像自己”开始。题库系统会越来越模板化,客服系统会越来越空泛礼貌,模型会越来越擅长适应合成世界,却越来越不擅长适应真实用户。因此,合成数据治理的本质,不是把合成系统做得更强闭环,而是始终为它保留现实约束、外部验证和可回退能力。只有这样,合成数据才能持续作为模型进化的助推器,而不是在不知不觉中成为模型坍缩的温床。