篇前导读

如果说纯文本大模型(LLM)是在学习人类几千年沉淀下来的“抽象符号系统”,那么以 GPT-4V、Gemini 乃至 Sora 为代表的多模态大模型(MLLM),则是在直接吞吐我们所生存的“物理世界镜像”。从干瘪的纯文本跃迁到栩栩如生的图文对、交错排版的网页图文、乃至奔流不息的视频和音频片段,这绝不仅仅是给基础大模型多插配一个预训练好的 Encoder 插件这么简单。跨越模态护城河的旅途,在数据工程底层面临着四重维度的爆炸性挑战: 1. 对齐(Alignment):文字和图像在数字世界的构成法则是天然割裂的,如何向一个仅仅懂得矩阵乘法的模型证明“Apple”这个序列与一张由红色与多边形构成的像素矩阵精确指向同一个物理实体? 2. 表示(Representation):纯文本先天拥有确定的 1D 序列边界(即明确切分好的 Vocabulary 词表),而多模态视觉信号是连续且具有极高维度的。如何将一张极高分辨率的 4K 网页截图压缩并无损打包进变长 Token 序列列车? 3. 评价(Evaluation):文字可以通过 PPL 或 TTR 指标来极其低成本地测量基本质量,而试图判断一幅图是否具备“高质量摄影美学”或“存在阴暗的版权水印”,其计算代价通常要调动千万级别参数的额外深度学习模型去进行特征扫描。 4. 算力成本(Cost):图像的磁盘存储、分布式集群的 I/O 解码带宽(如 PCIe)与内存张量传输成本,往往是等额纯文本的 100 倍到 1000 倍以上。

本篇(第8至第10章)将系统性揭秘全球前沿多模态大模型的训练基础底座与算力调度体系。我们将以业界最成熟经典的“图文对数据工程”为起点(直接支撑起集团 P03 等超大型视觉对话模型的研发构建),随后深入探讨攻克商业落地顽疾的重标注与真实文档 OCR 理解(第9章),最终进阶到处理时序相关的视频与高并发数字音频流(第10章)。

第8章 图文对数据工程¶

8.1 多模态数据为何难于文本¶

当一个 NLP 数据工程师首次接手视觉语言模型(Vision-Language Model, VLM)的数据清洗任务时,最真切的体会常常是:“原本极其确定的规则,突然全部失效了。”

8.1.1 视觉噪声的隐蔽性与“薛定谔的坏图”¶

在纯文本的数据工厂中,所谓的“脏数据”或“乱码”往往是可以被极其廉价地检测出来的——写个正则表达式、跑个 MinHash 或者算一下困惑度(PPL),甚至不需要动用 GPU 即可筛除。但在图像的世界里,什么是噪声?它常常呈现出“薛定谔的状态”: - 概念隔离噪声:一张 4K 高清、画质完美、色彩极好的风景照,由于被人为恶意编辑,角落里带有一个仅占 15x15 像素的半透明色情水印(NSFW),这种图对多模态合规性是致命的。 - 空间失真噪声:一张背景极其凌乱的东南亚街头杂货铺抓拍,描述语写的是“摊位上的一把梳子”。但这把关键的梳子在全图中仅仅占了 3 个像素,不仅人眼难辨,经过卷积网络下采样后更是荡然无存。 - 频域(Frequency Domain)压缩噪声:一张包含详尽财务报表或医学心电图的截图,由于在其流传过程中经历了多次微信、推特的二次 JPEG 压缩,高频细节周围产生了严重的“振铃伪影(Ringing Artifacts)”。人类看似乎还能猜出文字,但对依赖边缘特征的深度识别网络(OCR)而言则变成了无法跨越的灾难障碍。

这些“视觉隐蔽噪声”根本无法通过传统的哈希指纹或文件 MD5 对比来排除。在多模态数据流中,我们常常必须部署并长期运行数个预先训练好的轻量级视觉判别引擎(如基于 ResNet-50 的二分类水印检测器、基于 LAION Aesthetics 评估器)来进行“稠密推理扫雷”。这意味着,即便是“洗数据”这件毫无产出的前置工作,也开始大把大把地燃烧异常昂贵的 GPU 计算时。

8.1.2 语义缺失与跨模态“多义错位”(WebTox)¶

多模态的对齐学习,建立在一个天真的假设之上:我们抓取到的(Image, Text)对,它们彼此在描述同一个事物。然而,互联网上海量的“图片与替代文本(Alt-text)”天然是高度撕裂且毫不对应的。

由于十余年来网页爬虫与 SEO(搜索引擎优化)被恶劣滥用,爬虫工程师每天都会抓取到几百亿个长成这样的恶性图文对: - 肉眼看到的图片内容:一只正在草地上开心奔跑的金毛犬。 - HTML 里提取到的 Alt-text:“2023包邮正品优质特价全场满减买一送一宠物用品”。

如果你将这种充满了商业目的诱导数据,不做任何因果剥离直接喂给模型,模型将在反向传播(Back-propagation)中,被迫压榨自身的特征权重,最终学会了“金毛犬的毛发纹理等于包邮促销折扣”这种极其荒谬的绑定逻辑(即跨模态的语义强行错位)。 这一现象在多模态数据工程实践中被研究者俗称为 WebTox(网络语义毒数据)。实验表明,该类噪声的大量混入甚至会使得千亿规模模型在视觉问答(VQA)基准上的表现,劣于未经微调的 1B 基线模型。正是为了系统性地缓解这一问题,学界与工业界才逐步发展出了以 CLIP Score 为核心的跨模态语义过滤技术。

8.1.3 画像分辨率与 GPU 显存的四次方博弈¶

在纯语言建模时代,无论作者是写一篇长篇大论的主题报告,还是随口吟诵的一句几字短诗,送入大语言模型的代价仅仅与 Token 的长度呈线性增长(Linear Scaling)。但在多模态领域,图像分辨率(Resolution)对于计算开销(FLOPs)的惩罚是极其严厉且呈指数级攀升的。

我们以最主流的基于 ViT(Vision Transformer)架构的视觉编码器为例。假设我们设定的切割模块(Patch Size)尺寸恒定为 \(14 \times 14\) 像素: - 当向网络输入一张极为克制的低清 \(224 \times 224\) 分辨率图片时,它会被切成 \((224/14) \times (224/14) = 256\) 个 Patch Token。此时,自注意力机制(Self-Attention)的计算复杂度大约是 \(256^2 = 65,536\) 级运算量。 - 但如果你为了让模型能够看清楚一张扫描版发票上的数字,不得不拔高输入分辨率至 \(1008 \times 1008\)(以保留文档图像上的微小文字),那么图像 Token 序列的长度将剧增至 \((1008/14) \times (1008/14) = 5184\) 个。 - 由于标准 Transformer 的 Attention 计算开销是与其产生的 Token 序列长度呈“二次方(Quadratic)复杂度”的,此时单层注意力的计算量飙升到了 \(5184^2 \approx 26,873,856\) 级运算量!

仅仅将图像的边长拉大了 4.5 倍,Attention 层的计算量就显著地膨胀了近 410 倍(注意:这里衡量的是 Self-Attention 的二次方复杂度,而非整个模型的 FLOPs;其他层如 FFN 的计算量与序列长度呈线性增长,实际总训练算力涨幅仍然显著但略小于 410 倍)!这样暴戾的显卡显存消耗,将使得再庞大的训练集群也难以负担。因此,图文多模态数据工程最为核心的技术妥协艺术之一,就是不断摸索“如何对超清大图执行最高效的动态裁切降维与多尺度 Patching 策略”。

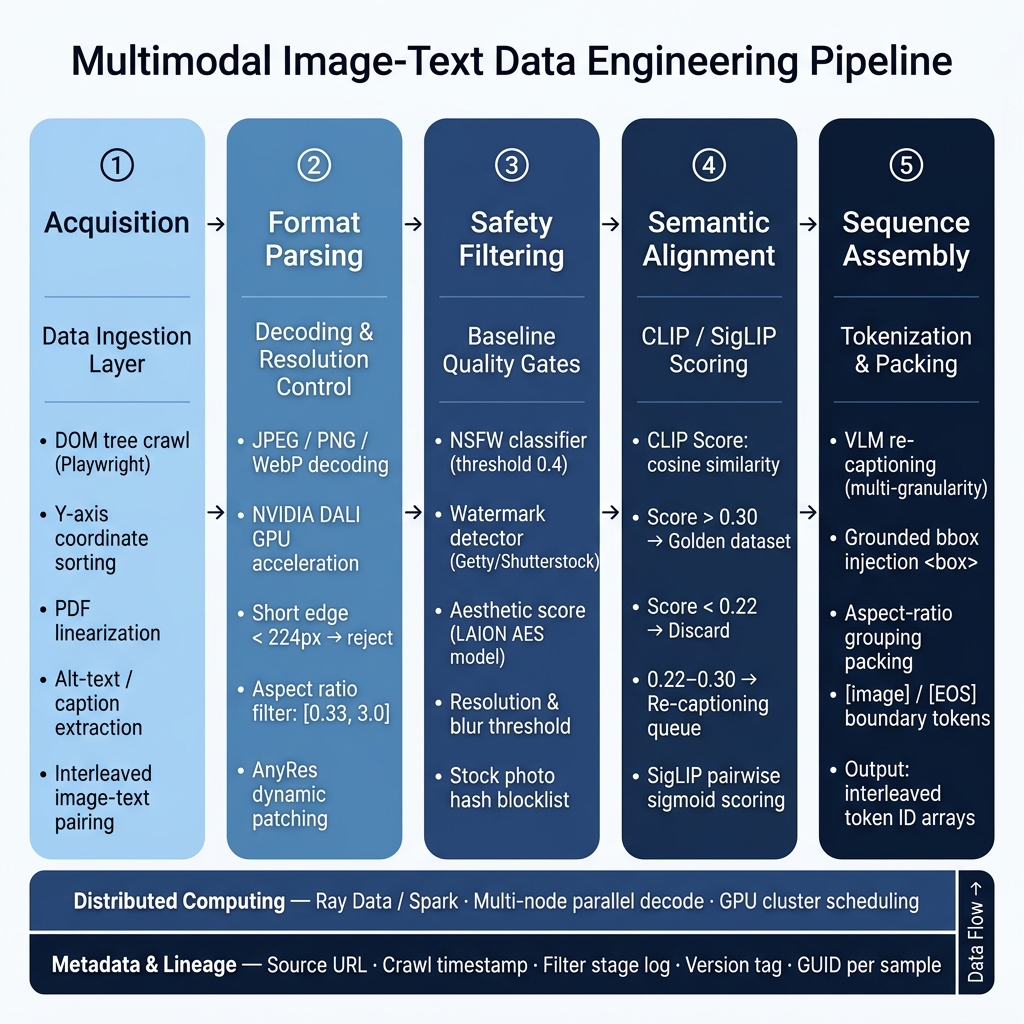

图8-1:多模态图文数据工程全景图 —— 从最左侧的 DOM 树抓取与 PDF 解析起始,依次穿透格式解析、水印底线过滤、CLIP 语义对齐、直至最右侧的交错序列拼装与 Token 化表示。分布式计算与 Metadata 是横跨底层的核心支撑。

8.2 图文样本的范式:从配对到交错¶

大模型不同阶段的训练目标,决定了我们需要喂入极其不同格式的数据。根据近年来的前沿结构(如 Flamingo, LLaVA, GPT-4V),典型的多模态文本主要被塑造成三种范式:

8.2.1 图文对 (Image-Caption Pairs)¶

这是最古典、最“堆量”的范式。

- 形式:严格的一张图对应一段独立的强描绘文字 { "image": "dog.jpg", "text": "A golden retriever playing fetch in the park." }。

- 代表开源集:LAION-5B, COYO-700M。

- 适用场景:主要用于冷启动阶段的多模态对比学习(Contrastive Pre-training),比如训练 CLIP 的前置模型,或者给新接入的 Vision Encoder 建立基础的视觉感知基线。

- 致命弱点:无法教会模型推理,只能使其学会认物。

8.2.2 交错图文 (Interleaved Image-Text)¶

为了赋予模型在复杂上下文中的“多图关联推理”能力,数据引擎必须从网页端提取还原“原生交错版面”。

- 形式:类似于我们在维基百科或微信公众号中看到的结构:一段起因 + <img_1> + 发展过程 + <img_2> + 结局总结。图像 Token 被视为一种特殊的词汇,散落在长文本序列之间。

- 代表开源集:OBELICS, MMC4。

- 适用场景:这是当今生成式 VLM 预训练的最核心弹药。它教会模型如何根据“前文”和“图片 1”,去推断“后文”或“图片 2”应该是什么。

- 采集挑战与 DOM 解析工程:交错图文的工程难度庞大。传统的文本爬虫遇到 <img> 标签直接跳过,而为了组装交错格式,爬虫必须解析极为庞杂的 HTML DOM 树,并进行“基于渲染坐标的相对距离计算”。

因为在很多现代网页的复杂级联样式(CSS)中,代码文档树的顺序往往并不是用户眼里的视觉排版顺序。如果仅按照 HTML 标签顺序提取,很可能把页面底部的免责声明强行与顶部的配图绑定。

为此,顶尖团队通常会使用带渲染引擎的无头浏览器(Headless Browser,如 Playwright)运行 JavaScript 生成页面快照,利用类似于下面的规则提取元素:

# 简化的 DOM 交错节点提取伪代码

text_nodes, img_nodes = get_rendered_nodes(page)

interleaved_sequence = []

for node in all_nodes_sorted_by_y_axis():

if node.type == 'TEXT':

if len(node.content.split()) > 5: # 抛弃过短文本,如导航栏

interleaved_sequence.append(node.content)

elif node.type == 'IMAGE':

if node.width > 200 and node.height > 200:

# 将合法图片转化为一个占位符 Token,并将 url 存入侧边通道

interleaved_sequence.append(f"<img_{node.id}>")

save_to_image_db(node.url, node.id)

8.2.3 长文档理解与截图 Grounding (Document Grounded)¶

面对 B 端商业落地的真实需求(看财报、读发票),传统的自然图像训练完全失效,必须引入高分辨率文档数据。

- 形式:输入的是渲染后的高频高清晰度截屏文档图(如 ArXiv 论文或密集型的 Excel 截图),对应输出结构化的 JSON 取值序列或者边界框(Bounding Box)坐标 <box>。

- 适用场景:极其依赖极高分辨率的分块(Patching)和 OCR 的辅助。主要用于 SFT(监督微调阶段)教会模型实施精密的值提取与逻辑结构理解(如公式与图表的指代排版)。

- 坐标归一化工程:在 Grounding 任务中,模型需要输出物体的具体像素坐标。然而,训练图片的分辨率千差万别,为了让语言引擎能“读懂”坐标,通常需要将原始的绝对像素坐标 (X, Y) 映射到位 [0, 1000] 的离散 Token 桶中(即 [<loc_255>, <loc_899>])。这种离散化强行将连续空间的坐标变为了大语言模型熟悉的“词汇表”。

表8-1:图文样本类型、特征与适用任务表

| 样本类型 | 数据特征 | 核心获取手段 | 最高适用阶段 | 带来的关键能力 |

|---|---|---|---|---|

| 纯图文对 (Image-Caption) | T/I 一对一,高噪声 | 网页 <img alt>,公有云 OSS 爬取 |

对齐预训练 (Alignment) | 基础特征感知、跨模态检索检索 |

| 交错图文 (Interleaved) | T/I 多对多,长序列 | DOM 树渲染解析、PDF 线性化剥离 | 主力生成式预训练 | 多轮逻辑推理、Few-shot 上下文感知 |

| 长文档截图 (Doc/OCR) | 超高分辨率,文本密集 | PDF 渲染、无头浏览器自动化截图 | 深度 SFT / 强化学习 | 排版理解、表单/论文/发票抽取分析 |

| 高精描绘 (Grounded Caption) | 含边界框 <box> 的长文 |

标注员框选,或闭源千亿模型重写 | 高阶 SFT / RAG 对齐 | 图像细粒度空间感知与抗幻觉能力 |

8.3 清洗、过滤与语义对齐技术 (上篇:基础清洗)¶

从全网抓取来的 Raw Data 泥沙俱下,必须经历至少三轮不同级别的漏斗挤压。我们将这一阶段称为前置清洗期(涉及极多的纯工程 I/O 操作及硬件加速的分类器运用)。

8.3.1 格式硬解法则与 GPU 的“像素抢夺战”¶

文本清洗时,JSON.loads 或 open() 几乎是零开销的操作;但面对数十 TB 甚至 PB 级的图像压缩包,解码(Decoding)本身就会演化为整个训练集群最大的吞吐瓶颈(Bottleneck)。

在互联网上,图片可能是古老的 JPEG、体积庞大的 PNG,甚至带有破损文件头或嵌入 ICC 颜色配置错误的网络恶搞变种(WebP)。

如果使用标准 Python 生态下的 CPU Pillow 或 OpenCV-Python 库来执行 Resize 和 Normalize:

- 在 8 卡 A100 的节点上,哪怕给 PyTorch DataLoader 开满 num_workers=64。

- 密集的 CPU 图片缩放运算也会瞬间填满所有物理核心。

- 更致命的是,由于进程间通信(IPC)将庞大的非压缩 RGB 张量搬运到 GPU 显存中,PCIe 带宽也会被瞬间挤爆。从而导致 GPU 算力远未喂饱,处于高频的“饥饿等粮(GPU Starvation)”状态(MFU 跌破 20%)。

工程解法:基于 NVIDIA DALI 的端到端流水线 在大型企业的图文处理阵列中,通常会强制切入基于 NVIDIA DALI(Data Loading Library)的显存级加速流水线。 其核心思想是“尽早将比特推入 GPU,并在显存内解压缩”: 1. CPU 仅搬运二进制:CPU 读取未经解码的 JPEG 字节流(Byte Stream),并不执行解码。 2. NVJPEG 硬件解码:字节流通过 PCIe 极宽的车道送入 GPU 后,调用 GPU 集成的专属 JPEG 硬件解码器(NVJPEG)在显存内部瞬间完成解压。 3. 融合算子变换:随后的裁剪(Crop)、调整尺寸(Resize)与方差均值归一化(Normalize)等操作全部被编译为一个 CUDA Graph,直接在张量上执行。

通过这种“硬件接管一切”的手段,使得处理单张 512x512 图像的时间延迟能够从 CPU 端的 8ms 锐减至 0.4ms 以下。这是支撑万亿参数多模态模型能活下来的生命线(详见附录与遗留参考图 图6_2_使用DALI与不使用DALI的区别)。

8.3.2 分辨率与宽高比控制(Aspect Ratio Filtering)¶

在原始清洗期,最无情也是提效最快的手法是制定“一刀切”的尺寸抛弃规则:

- 拒绝像素孤岛:对于短边低于 224px 或总体积低于 20KB 的图片直接抛弃。因为它们通常是 UI 小图标(如点赞按钮、小箭头),缺乏任何深层语义供大模型学习。

- 猎除“极端面条图”:由于互联网长图(如电商宣传页的全量拼接长图)的宽高比可能极度畸形(例如宽 500、长 9000)。当把这样的图片强行 Resize 缩放到 \(336 \times 336\) 正方形以供常规 ViT 编码器吸收时,里面的内容将被挤压成一条竖线从而丢失一切轮廓特征。因此,通常要求宽高比强制限制在 \([0.33, 3.0]\) 的区间内,任何落出此区间的会被标记并进入针对性的“动态切片”旁路(会在 8.4 节详细介绍)。

8.3.3 NSFW、面部隐私与水印靶向拦截¶

图文工程相比纯文本工程受到极高伦理合规关注:你决不能让你的多模态模型一开口或者一描述就生成人名隐私或版权宣发图。 在这一阶段的流水线通常串联部署了三至四个小型的纯视觉或分类网络: 1. NSFW 分类器:对任何概率打分超过阈值(如0.4)的高挑感图像直接软删除。 2. 水印鉴别器 (Watermark Detector):由于大量网络图片来自图库(Getty Images、Shutterstock),一旦模型吸收了这些图,模型不仅会频繁在生成回答中“幻想”出那些水印字样,还会不可避免地遭到商用风险反噬。我们必须过滤掉所有带密集斜纹或高光中心水印的样本。 3. 模糊度判定阈值 (Blur/Aesthetic Score):利用类似 LAION 团队训练的 AES(Aesthetic Predictor)美学评分模型,抛弃那些重度失焦、光照极度昏暗或充斥单纯彩色噪点的垃圾片源。

完成了这三大基础清洗关卡,你的 100 亿庞大抓取库可能已经急剧锐减到了不到 40 亿规模。这些幸存的坚挺图像干净脱俗,但别高兴太早——此时它们依然没有与文字发生过有效的“核心交流”。在接下来的下篇,我们将祭出大杀器:CLIP Score。

8.4 清洗、过滤与语义对齐技术 (下篇:深度语义过滤)¶

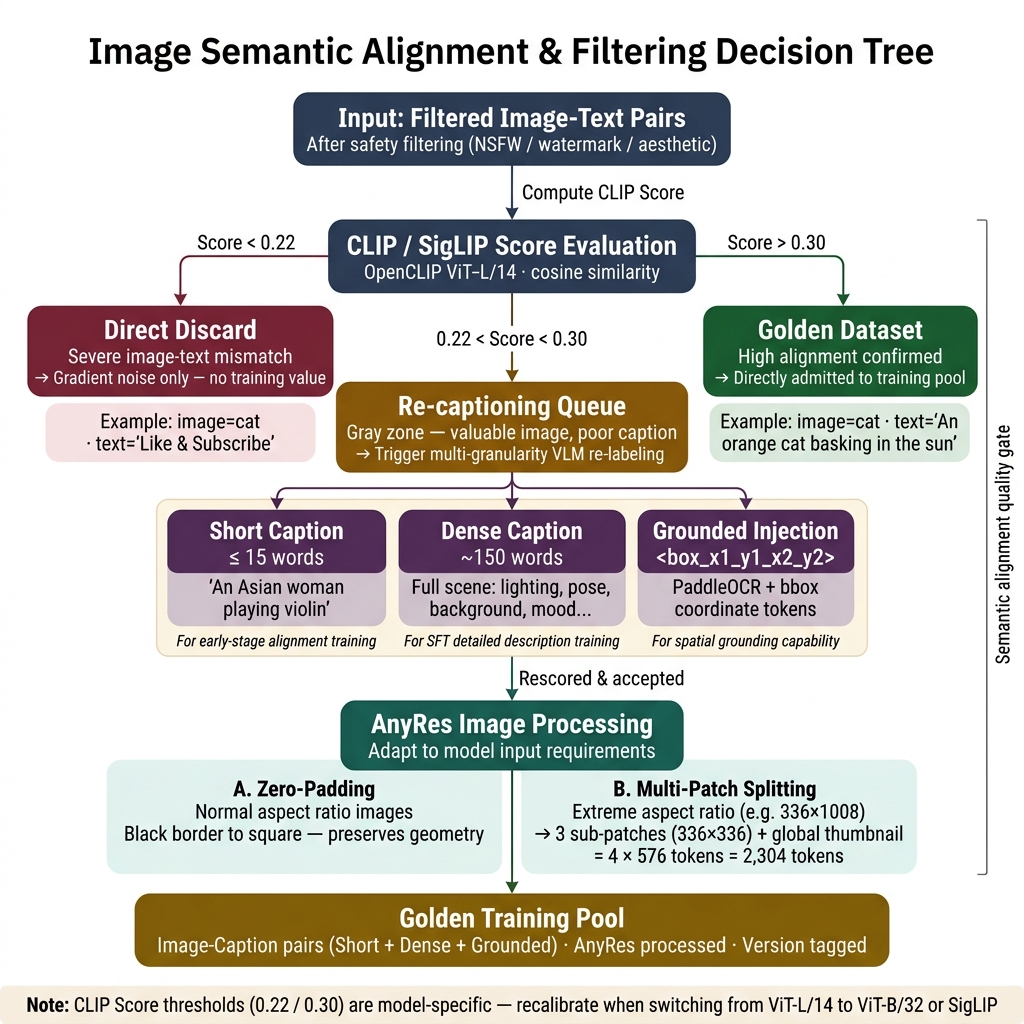

脱离了视觉层面的低级错误后,多模态数据工程迎来了最具挑战性的阶段:定量测量一张图和一句话之间的“匹配度”。

8.4.1 CLIP Score 及其进阶者 SigLIP 的量化哲学¶

在 OpenAI 放出 CLIP(Contrastive Language-Image Pre-training)模型之前,判断图文匹配几乎是一门玄学。CLIP 通过大规模对比学习,巧妙地将图像片段(Image Embedding)和文本片段(Text Embedding)拉入到了同一个高维特征向量空间。

1. 基础过滤动作与 InfoNCE Loss 的遗产:

我们通常使用预训练的稳定版 CLIP(例如开源版的 OpenCLIP ViT-L/14)分别对图和对应的 Caption 进行向量化前向推理,并计算两个向量的余弦相似度(Cosine Similarity,即 CLIP Score)。

- 高匹配(Score > 0.30):图文高度吻合,比如图片是一只猫,文字写的是"一只橘猫在晒太阳"。这类数据将被无条件列入 Golden 数据集。

- 低匹配(Score < 0.22):严重不匹配,例如图片是猫,文字是"欢迎关注我的公众号"。这类数据通常直接丢弃(Discarded),因为它们给模型提供的全部是反向的梯度噪声。

- 中等匹配(0.22 < Score < 0.30):处于灰色地带。此时我们不会轻易抛弃高昂搜集来的资源,而是触发下一节提到的重标注流程(Re-captioning)。

[注意]:以上阈值(0.22 / 0.30)基于

OpenCLIP ViT-L/14模型;若改用ViT-B/32或SigLIP,同一批数据的得分分布会有显著差异,阈值需在目标数据上重新校准,切勿直接复用。

2. 从 CLIP 到 SigLIP:摒弃全局 Softmax 的新方向 在大型企业数据管线中,传统的 CLIP 模型正逐渐被一种名叫 SigLIP(Sigmoid Loss for Language Image Pre-Training) 的新架构所取代。 在传统 CLIP 训练时,模型计算的是整个 Batch 内图像和文本的全局 Softmax 概率。这就带来一个致命工程问题:如果你的分布式 Batch Size 巨大(例如 \(32768\)),那么强迫模型区分如此多对(Pair)的微小差异,会导致模型对某些“难负样本(Hard Negatives)”过于敏感,进而在推理 CLIP Score 时产生震荡。 SigLIP 则将这个全局多分类问题,优雅地转化为了逐对(Pairwise)的二分类 Sigmoid 预测问题。这使得 SigLIP 对“部分匹配”或“复杂背景图文”拥有更高的宽容度和稳定的 Score 打分。工程团队可以设定更加精准一致的截断阈值,而不用担心因为领域漂移导致阈值突然失效。

# 基于 SigLIP/CLIP 的图文对齐度过滤伪代码(可扩展为工业级流处理)

import torch

from transformers import AutoProcessor, AutoModel

device = "cuda" if torch.cuda.is_available() else "cpu"

# 使用更稳定、无需巨型 Batch Size 的 SigLIP 权重

processor = AutoProcessor.from_pretrained("google/siglip-base-patch16-224")

model = AutoModel.from_pretrained("google/siglip-base-patch16-224").to(device)

def filter_by_semantic_score(image, text_caption, threshold=0.25):

inputs = processor(text=[text_caption], images=image, padding="max_length", return_tensors="pt").to(device)

with torch.no_grad():

outputs = model(**inputs)

# 提取融合后的特征并计算点积相似度

image_embeds = outputs.image_embeds / outputs.image_embeds.norm(p=2, dim=-1, keepdim=True)

text_embeds = outputs.text_embeds / outputs.text_embeds.norm(p=2, dim=-1, keepdim=True)

# 获取受模型温度系数缩放的 Logit,转化为客观置信度

logits_per_image = image_embeds @ text_embeds.T * model.logit_scale.exp()

similarity = logits_per_image.item()

return similarity >= threshold, similarity

8.4.2 挽救优质图像:多粒度合成重标注 (Synthetic Re-captioning)¶

当一张图像拥有极高的分辨率、绝佳的构图和罕见的实体,但其附带的原始网页文本却全都是废话(例如“IMG_20230401.jpg”)时,直接抛弃它是对数据资产的极大浪费。在算力充裕的今天,使用庞大强悍的专家级视觉大模型(如拥有巨量预训练积累的 LLaVA-1.5、Qwen-VL-Max 或 GPT-4V)来反客为主、重新生成描述,是目前头部 AI 企业构建超越开源版 LAION 数据质量的杀手锏。

在最新的大模型工程实践中,为了兼顾“冷启动对齐”与“后期长文本生成”的双重要求,数据团队会对这批图像实施流水线维度的“多粒度(Multi-granularity)重标注阵列”:

- 短描述(Short/Brief Caption)提取:

- 指令(Prompt)设为:“仅用一句话,指出画面正中央最主要的主体及其核心动作。不超过 15 个字。”

- 产出结果:“一名拉小提琴的亚裔女性。”

-

工程价值:极其纯净、没有修饰词的短句,非常适合在预训练最早期的第 1 个 Epoch 中,用于迅速拉平视觉 Encoder 和文本 LLM 之间极其基础的注意力绑定。如果一开始就喂入长篇大论,模型往往会因对齐焦点涣散而出现“幻视”。

-

长描述(Detailed/Dense Caption)渲染:

- 指令(Prompt)设为:“作为一名盲人视听解说员,请巨细靡遗地描写图片中的构图、光影、人物特征、服饰颜色、背景元素以及潜在的情绪氛围。长度在 150 字左右。”

- 产出结果:“在纽约时代广场的黄昏下,天空呈现出深邃的紫橘色晚霞。画面正中央,一名穿着破洞做旧牛仔裤和白色毛衣的亚裔女性正闭着眼拉奏一把红棕色的木质小提琴。画面的景深(Bokeh)较浅,她的背后是模糊的黄色出租车和闪烁的霓虹灯牌,整体氛围显得忧郁而专注。”

-

工程价值:这种高密度信息是训练模型获得极强逻辑感、细节抵抗力和防止“一问三不知”幻觉的核心燃料。只有使用这种数据进行 SFT,模型才会被赋予出色的“图片观察描述力”。

-

结构化边界框与 OCR 注入 (Grounded Injection):

- 并行流合并:仅仅用大模型去“看”还不够准确,尤其是画面里出现密集数字时。重标注引擎的旁路(Side-car Workflow)会同步唤醒 PaddleOCR。如果在长描述发现画面背景恰好有一块广告牌,合并脚本会将其坐标转化为特殊的 Token 拼接入文本:

...背景是一块写着 "<box_45_120_350_200> Broadway 5th Ave. </box>" 的广告牌。这真正实现了将纯视觉符号在底层转化为确切的字符串引擎。

图8-2:图像语义对齐与过滤流程图 —— 展示了具有工业水准的量化决策树:基于 CLIP 与启发式规则将劣质匹配筛出并送往大模型 Re-captioning 流水线,最后将图片 Zero-pad 或动态切分后存入黄金训练池。

8.5 采样配比、表示和训练适配策略¶

完成了千难万险的数据清洗,终于到了将它们送往 GPU 嘴边的最后一米。在送入前,“切片打包(Packing)”和“比例混合(Mixing)”极其考验架构师的手感。

8.5.1 图像在序列中的“霸权”与 AnyRes 动态切分¶

在常见的纯文本打包中,1000 个文字可能只需要 300 个 Token。但对于多模态,图像是一个绝对的序列霸主。以一张常规切分的 \(336 \times 336\) 图片经过 ViT-L/14 处理为例,它将硬生生地挤占 576 个 Token 的槽位。

早期 VLM(如 CLIP 及其时代的诸多模型)通常对输入图像采取固定尺寸缩放(Resize):无论是横版风景图还是纵向长文档,一律强制压缩至 \(224 \times 224\) 的正方形,导致内容比例严重失真。为解决这一问题,现代数据工厂在预处理阶段普遍引入了 AnyRes(动态高分辨率保持) 策略:

- 补零(Zero-padding)策略:对于不想失去原始横纵比的小图,在周围补全黑色边框凑成正方块,使得模型能学到相对几何形状。

- 多重补丁(Multi-Patch Splitting)策略:将一张 \(336 \times 1008\) 的竖版图片,切割成 3 张 \(336 \times 336\) 的正方形子图(Sub-patches),外加一张经过大幅度下采样(Down-sampled)的全局缩略图。这意味着这 1 张原图将被输入为 4 份 576 Token 的巨大矩阵块(合计消耗 2304 个 Token)。

若不对这种交错图文做严格拼接控制,GPU 显存中将被庞大的无声像素挤满,文本逻辑学得极其缓慢。为此我们需要使用基于长宽比分组(Aspect-Ratio Grouping)的 Sequence Packing 技术:像贪吃蛇一样,把多长条同类的图文对塞入同一个 4096 的 Sequence 窗口,并在图像和图像块之间插入特殊的界限标识符 <image> 与 </image>,利用 Attention Mask 阻断跨文档的计算污染,从而节约显存边界带来的极大浪费。

8.5.2 三足鼎立的配比调参 (Data Mixing)¶

正如人类的大脑需要不同知识成分的刺激,一个平衡的 MLLM 预训练面糊(Data Mix)需要精确分配抓取源的比重: 1. 通用自然图像(Web Images)占比约 50-60%:提供基础的世界物体常识(猫狗、汽车、风景色准、人物神态)。这部分通常由极其严酷 CLIP Score 筛选后的开源数据集(如 DataComp-1B 的核心过滤提纯集)承担。 2. 图表与代码图纸(Charts/Plots/Math)占比约 15-20%:提供顶尖的抽象数理推理能力。如果缺失此部分,大模型看折线图、股票 K 线图或是复杂的思维导图时,将会完全胡编乱造。 3. 高密度 OCR 文档截图(Documents)占比约 20-30%:大量的扫描版白皮书、PDF 单页、收据发票影印件。这对于未来模型去充当“合同审查专员”或者“财务发票小助手”至关重要,它训练了模型克服自然图像中极少出现的“超高细粒度文本焦点”(Fine-Grained Text Focus)能力。

表8-2:图像清洗策略与代价对照表

| 清洗阶段策略 | 算力代价 | 核心作用与收益 | 残留风险与副作用 |

|---|---|---|---|

| 基础分辨率切除 | 极低(I/O密集) | 剔除无意义色块,节省 30% 储存开支 | 误伤具备极高历史意义但只留下低像素版本的(如旧新闻片)纪实图 |

| DALI 硬件提速解码 | 中低(GPU密集) | 打破 DataLoader 瓶颈,解码提速百倍 | 业务侵入性高,遇到奇异损坏 JPEG 格式易引发 C++ 库级核爆崩溃 |

| NSFW / 水印检测 | 中等(CNN前向) | 严守商业落地合规红线,防范安全灾难 | 漏杀难以杜绝对抗性微小水印,极考验检测分类器的持续演进 |

| SigLIP/CLIP 对齐 | 高(双塔特征) | 直接消除图文语义错乱,是认知质量根基 | 高分段可能有“语义白开水化”,扼杀带有深刻隐喻、讽刺意味的独特配图 |

| VLM 重标注合成 | 极高(LLM生成) | 颠覆烂数据基盘的终极手法,带来源头细节 | 资金燃烧速度极快,且易混入前序旧模型的幻觉或重复的机械句式结构 |

8.6 真实踩坑案例与商业落地长效指南¶

在真实商业项目(例如集团 P03 多模态底座大模型研发)中,很多错误并不是算法推导出来的,而是在损失几千张 A100 的日租费后,用血泪总结出的真理。

8.6.1 被大图库“绑架”的反向学习¶

在研发早期阶段,某部门曾试图偷懒,直接下载清洗版的开源数据集 LAION-5B 某子集去进行对齐训练。在阶段性的交互盲审中,技术总监震惊地发现一个诡异现象:无论给模型看什么纯风景照片,模型大肆夸赞之余,必然在结尾极其高频地带出诸如:“下载高清免水印图片请到 Shutterstock / Getty Images 获取同款” 的垃圾口语。

教训复盘与拔除:这被称为“图库污染现象(Stock Photo Contamination)”。即使是经过 CLIP Score 卡了极高阈值的“优质集”,只要它在收罗初期没有使用强力的 OCR 或特征分类下狠手切除带防盗水印的高分商业图,大型图床就会用其浩如烟海的垃圾推销模板文本,缓慢渗透并侵蚀模型最终学到的词汇条件概率分布。这是绝不能偷懒省钱的学费,对于严肃的商业级大模型,必须针对特定的商业图床建立专门的负面哈希清单,对外部数据执行严密的“二次清洗净化池”。

8.6.2 为项目 P03 构建的多模态数据壁垒¶

回顾我们整个图像文本数据工程的战略框架,图文大模型竞争的核心门槛从来都不在于“使用怎样的魔改版 Vision Encoder”,也不在于训练脚本到底写得多花哨。真正的较量,往往发生在模型接收到第一个多模态 Tensor Token 的那几个月之前。

当我们把从海量互联网废墟中挖出的冗余 DOM 树残片截击存下;经过极其漫长而艰险的高速硬件解码、严格到近乎苛刻的宽高比裁剪、滴水不漏的安全风控扫描;再到昂贵算力开路的 SigLIP 量化评测与庞大机器算力驱动的全方位高分辨率幻觉重写(Re-captioning)之后——那些曾经劣质、对不齐的网图烂梗,才被提炼成了一粒粒拥有丰满中英双语、且经过 Grounded 位置锚定标注长图注的黄金多模态配对(Golden Pair)。

这些流淌着算法工程师汗水的“清洁数据水库”,不再是一块块冰冷发热的固态硬盘或者散乱无章的 JSON 文件。这套复杂的流水线上游能力,以及它所缔造出的数十亿精良的多模态交错对冲数据集,正是未来十年企业在多模态商战中最为牢固且不可复制的防御壁垒。

本章小结¶

本章作为拥抱多模态领域的揭幕战,我们详细铺陈了多模态数据区别于纯文本的“四重地狱挑战”,并逐级点出了图文工程的三大结构范式。为了平息图片压缩包对流水线的吞噬,我们探索了依靠底座硬件优化的 DALI 极速解码模式。

针对错综复杂的语义对齐,我们以图解的形式剖析了以“CLIP Score 过筛”结合“高维 VLM 重标注”的雷霆手腕,将垃圾数据点石成金(流程式详见图8-2)。最后,本章通过配比调参和惨痛的开源踩坑案例,为企业级视觉大语言模型指明了可落地的质量守恒方向。

虽然图文交织占据了现今多模态的半壁江山,但在复杂的 B 端工业应用场景(财报剖析、复杂发票查验、手书医疗单识别)中,单单依靠自然景物图依旧无法应对高密度的字符考验。下一章,我们将镜头对焦极其硬核的进阶领域:“第 9 章:重标注与文档理解(OCR)”,深度解密大模型如何通过特殊文本引擎练就一双堪比速读大师的火眼金睛。